성별과 감정 인식을 위한 암시적 사용자 신호 활용

초록

본 연구는 저비용 상용 EEG 헤드셋과 눈추적기를 이용해 성별 및 감정 상태를 암시적 행동 신호로부터 인식하는 가능성을 탐색한다. 28명의 참가자를 대상으로 얼굴 표정 인식 과제를 수행하게 하였으며, 여성은 특히 부정적 표정을 더 빠르고 정확하게 인식한다는 기존 결과를 재현하였다. EEG와 시선 데이터에서 감정·성별 특이적인 ERP 패턴과 시선 분포 차이가 관찰되었고, 이를 기반한 분류 실험에서는 약 70% 정확도로 성별을, 60% 이상 AUC로 감정의 양성·음성을 구분할 수 있었다.

상세 분석

이 논문은 인간‑컴퓨터 상호작용(HCI) 분야에서 사용자의 성별과 감정 상태를 비침해적으로 파악하기 위한 새로운 접근법을 제시한다. 기존 연구들은 주로 얼굴 이미지나 음성 신호와 같은 명시적 바이오메트릭을 이용했으며, 이는 개인 식별 가능성 때문에 프라이버시 우려가 있었다. 저자들은 이러한 문제를 회피하기 위해 EEG와 눈동자 움직임이라는 ‘암시적’ 신호를 선택했으며, 특히 Emotiv EPOC와 EyeTribe라는 상용 저가 장비를 사용함으로써 실험 환경의 친화성과 비용 효율성을 동시에 확보하였다.

실험 설계는 28명의 대학생(남녀 각각 14명)을 대상으로 RaFD 데이터베이스의 6가지 기본 감정(분노, 혐오, 공포, 행복, 슬픔, 놀람)을 25%~100% 강도로 변형한 이미지들을 제시하고, 각 이미지에 대해 4초 동안 관찰 후 30초 이내에 감정을 선택하도록 하였다. 이 과정에서 EEG와 시선 데이터가 동시에 기록되었다.

행동 측면에서는 반응 시간(RT)과 정확도(RR)를 분석했으며, 고강도(55%~100%) 표정이 저강도(25%~50%)보다 빠르고 정확하게 인식되는 것이 확인되었다. 특히 여성은 부정적 감정(분노, 혐오, 공포, 슬픔)에서 남성보다 평균 0.2초 정도 빠르게 반응하고, 정확도 역시 유의하게 높았다. 이러한 결과는 기존 심리학 연구와 일치한다.

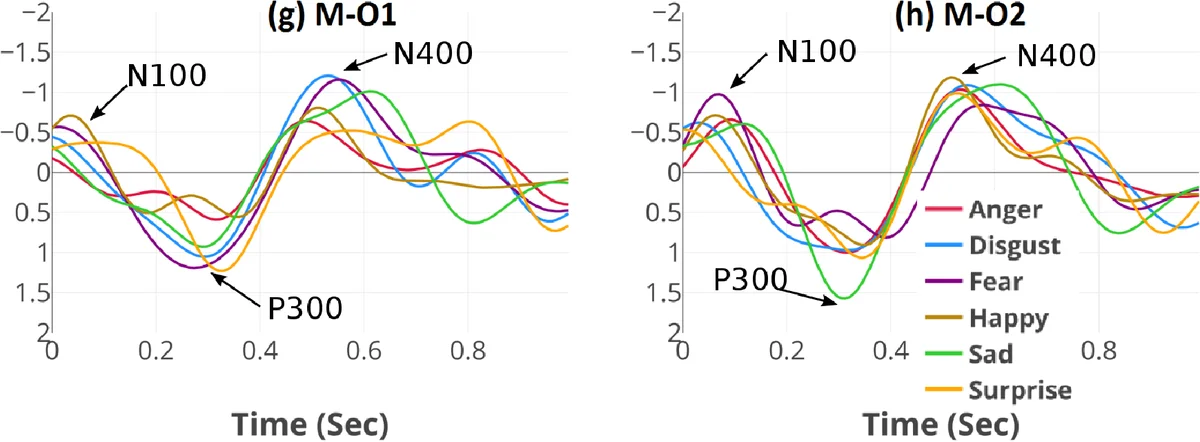

EEG 분석에서는 0.1–45 Hz 대역으로 필터링하고 ICA를 통해 눈깜빡임·근육 잡음을 제거한 뒤, 4초 구간을 128 Hz로 샘플링하여 14채널 전체를 피처로 사용하였다. 차원 축소는 PCA로 90% 분산을 유지하도록 적용했으며, 이후 SVM 및 랜덤 포레스트 등 여러 분류기를 실험하였다. ERP 결과는 여성의 경우 부정적 감정에 대해 N170·P300 파형이 더 뚜렷하게 나타났으며, 이는 감정 처리 과정에서의 신경 활성도 차이를 시사한다.

시선 데이터에서는 얼굴 영역(눈·코·입)별 고정점 분포를 히트맵으로 시각화했으며, 여성은 눈 영역에, 남성은 입 영역에 더 많은 고정점을 두는 경향이 있었다. 이러한 시선 패턴은 감정 인식 정확도와도 상관관계를 보였다.

분류 실험 결과, 감정별 EEG 피처를 이용한 성별 인식에서 평균 정확도는 약 70%에 달했으며, 특히 분노와 혐오 감정에서 가장 높은 구분 성능을 보였다. 감정의 양성·음성 구분(긍정 vs 부정)에서는 EEG와 시선 피처를 결합했을 때 AUC가 0.62 정도로, 기존 연구 수준과 비슷하거나 약간 높은 수준을 기록했다.

전체적으로 이 연구는 저비용 상용 장비로도 성별·감정 구분이 가능함을 입증했으며, 특히 부정적 감정에서 여성의 신경·시선 반응이 더 강하고 일관됨을 보여준다. 다만 EEG 신호의 잡음 수준과 눈추적기의 정확도 제한으로 인해 실시간 적용에는 추가적인 신호 처리 및 모델 최적화가 필요하다. 향후 연구에서는 더 다양한 인구통계학적 변수와 복합 감정(혼합 감정) 상황을 포함하고, 딥러닝 기반의 엔드‑투‑엔드 모델을 적용함으로써 인식 정확도와 실용성을 동시에 향상시킬 수 있을 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기