다국어 문자 윈도우 기반 언어 식별 혁신

초록

짧은 문자 윈도우와 양방향 GRU를 이용해 131개 언어를 문자 수준에서 식별하고, 단일·다중 언어 문서와 짧은 텍스트에서도 높은 정확도를 보이는 모델을 제안한다.

상세 분석

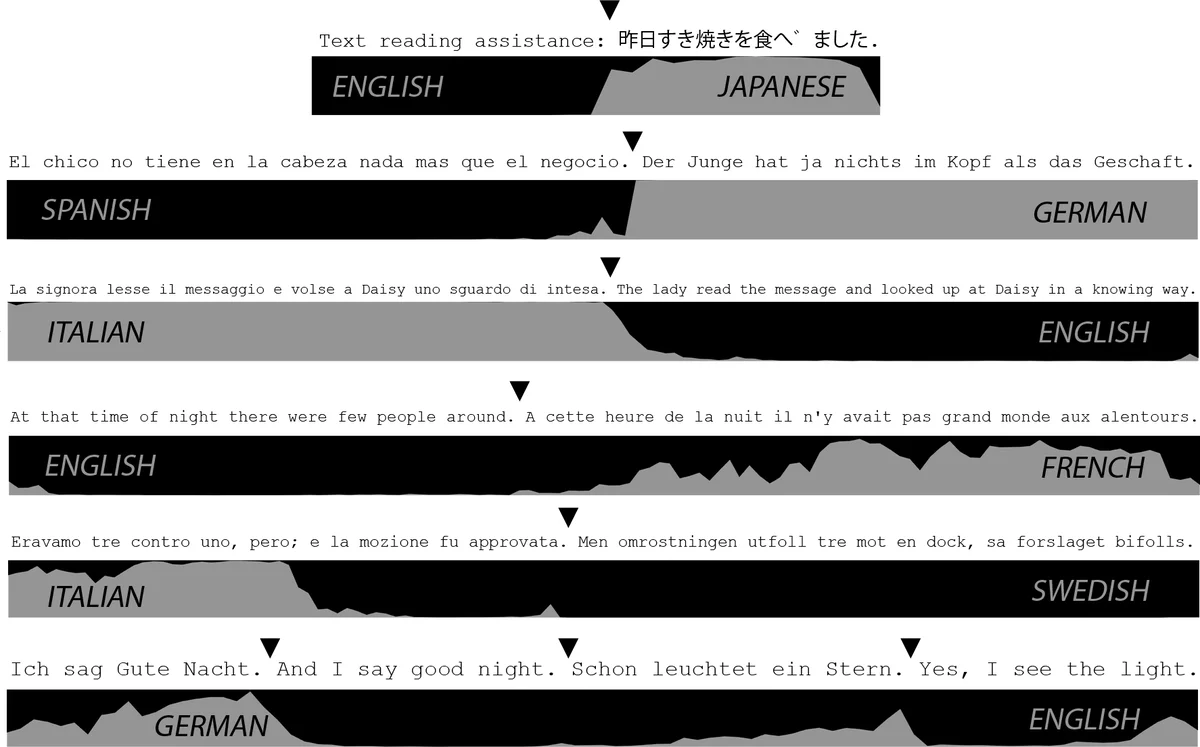

본 논문은 문자 수준에서 언어를 식별하는 새로운 접근법인 LanideNN을 제안한다. 핵심 아이디어는 고정 길이(200자) 문자 윈도우를 입력으로 받아, 양방향 Gated Recurrent Unit(GRU) 네트워크를 통해 각 문자마다 언어 라벨을 출력하도록 학습하는 것이다. 입력 문자들은 200차원의 임베딩 벡터로 변환되며, 이 임베딩은 학습 과정에서 동시에 최적화된다. 양방향 구조는 현재 문자뿐 아니라 앞뒤 컨텍스트를 모두 활용해 예측 정확도를 높인다. 모델은 각 방향에 500개의 GRU 셀을 사용해 총 1000개의 은닉 유닛을 구성하고, 최종 출력은 소프트맥스 층을 거쳐 언어별 확률 분포로 변환된다.

학습은 Adam 옵티마이저와 교차 엔트로피 손실 함수를 사용하며, 과적합 방지를 위해 임베딩 층에 0.5의 드롭아웃을 적용한다. 데이터는 Wikipedia 기반의 W2C 코퍼스(106언어), Tatoeba, Leipzig, EMILLE, Haitian Creole 등 다양한 출처를 통합해 131개 언어와 HTML 태그까지 포함하도록 구성하였다. 각 언어당 최대 문자 수를 제한해 전 세계 언어 사용 인구 비율을 반영하고, 훈련·검증·테스트 셋을 비중첩 방식으로 분리하였다.

평가에서는 Baldwin과 Lui가 제공한 3개의 표준 monolingual 테스트셋(EuroGov, TCL, Wikipedia)을 사용해 기존 도구(Langid.py, CLD2, TextCat 등)와 비교하였다. LanideNN은 EuroGov에서 97.7%, TCL에서 95.4%, Wikipedia에서 89.3%의 정확도를 기록했으며, 특히 짧은 문서(평균 142자)에서도 강인한 성능을 보였다. 다중언어 시나리오와 코드스위칭 상황에서도 문자 단위 라벨링이 가능해, 언어 경계 탐지에 유리함을 입증하였다.

주요 강점은 (1) 사전 전처리 없이 순수 Unicode 문자만으로 학습·예측이 가능하다는 점, (2) 짧은 텍스트와 도메인 변화에 대한 강인성, (3) 131개 언어를 한 모델에 통합한 범용성이다. 반면 제한점으로는 고정 윈도우와 비중첩 처리 방식으로 인해 긴 문서에서 언어 전환이 윈도우 경계에 맞춰 정확히 포착되지 않을 수 있다. 또한 훈련 데이터가 공개되지 않아 재현성이 떨어지고, 드물게 등장하는 언어는 학습 샘플이 제한적이어서 성능 저하가 예상된다. 향후 연구에서는 겹치는 윈도우를 도입해 연속성을 강화하고, Transformer 기반의 장거리 의존성 모델이나 사전학습된 다국어 언어 모델과 결합해 미지의 언어에 대한 일반화 능력을 향상시킬 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기