개인화된 콘텐츠 추천을 위한 통합 텍스트 임베딩 모델

초록

본 논문은 사용자-아이템 상호작용이 전혀 없는 신규 텍스트 아이템에 대해, 텍스트 임베딩과 사용자 임베딩을 공동 학습하여 개인화된 순위 예측을 수행하는 프레임워크를 제안한다. 감독 학습 기반 텍스트 임베딩(Term Embedding for Recommendation, TER)과 대규모 비지도 텍스트 코퍼스로 사전 학습된 임베딩을 결합한 TER+ 모델을 설계하고, 두 단계 학습 절차와 결합 모듈을 통해 콜드스타트 상황에서 추천 정확도를 크게 향상시켰음을 실험을 통해 입증한다.

상세 분석

이 연구는 기존 협업 필터링 기반 매트릭스 팩터라이제이션이 아이템의 잠재 요인을 학습하기 위해 풍부한 사용자-아이템 상호작용을 필요로 하는 한계를 지적한다. 특히 신규 아이템이 지속적으로 등장하는 뉴스·학술 논문 도메인에서는 이러한 상호작용 데이터가 부족하거나 전혀 존재하지 않아 ‘콜드 스타트’ 문제가 심각하다. 이를 해결하기 위해 저자들은 텍스트 자체가 제공하는 풍부한 의미 정보를 활용하는 두 가지 접근을 제안한다.

첫 번째는 ‘감독 학습 텍스트 임베딩(TER)’이다. 여기서는 각 사용자를 고정 차원의 벡터 u_i 로, 각 텍스트를 임베딩 함수 f(x) 로 매핑한다. f(x)는 평균 워드 임베딩(MoV)이나 컨볼루션 신경망(CNN) 등 차별화 가능한 구조를 채택할 수 있다. 사용자와 텍스트 임베딩 사이의 점곱 s_ij = u_i^T f(x_j) 를 점수로 사용하고, 베이지안 퍼스펙티브가 아닌 pairwise ranking loss ‑log σ(s_ip – s_in) 를 최소화함으로써 긍정 아이템을 부정 아이템보다 앞서게 학습한다. 이 방식은 텍스트와 사용자 간의 관계를 직접적으로 최적화하므로, 텍스트 내용이 추천에 미치는 영향을 정밀하게 반영한다.

두 번째는 ‘비지도 텍스트 임베딩 결합(TER+)’이다. 여기서는 대규모 라벨이 없는 코퍼스(예: DBLP 논문, Yahoo! 뉴스 전체)에서 Paragraph Vector(Doc2Vec)와 같은 비지도 학습 방법으로 사전 임베딩 행렬 M을 구축한다. 각 아이템은 두 개의 임베딩 h1 = f(x)와 h2 = M_j 로 표현되며, 이들을 concat 후 비선형 레이어를 거쳐 최종 텍스트 표현 h’ = g(h1, h2) 로 변환한다. 중요한 설계 요소는 h2에 dropout을 적용해 비지도 임베딩의 신뢰도를 조절할 수 있다는 점이다; dropout 비율을 0으로 하면 완전 활용, 1로 하면 완전 무시한다. 이렇게 함으로써 데이터 희소성 문제를 완화하고, 비지도 임베딩이 제공하는 일반 언어 지식을 감독 학습 목표에 자연스럽게 융합한다.

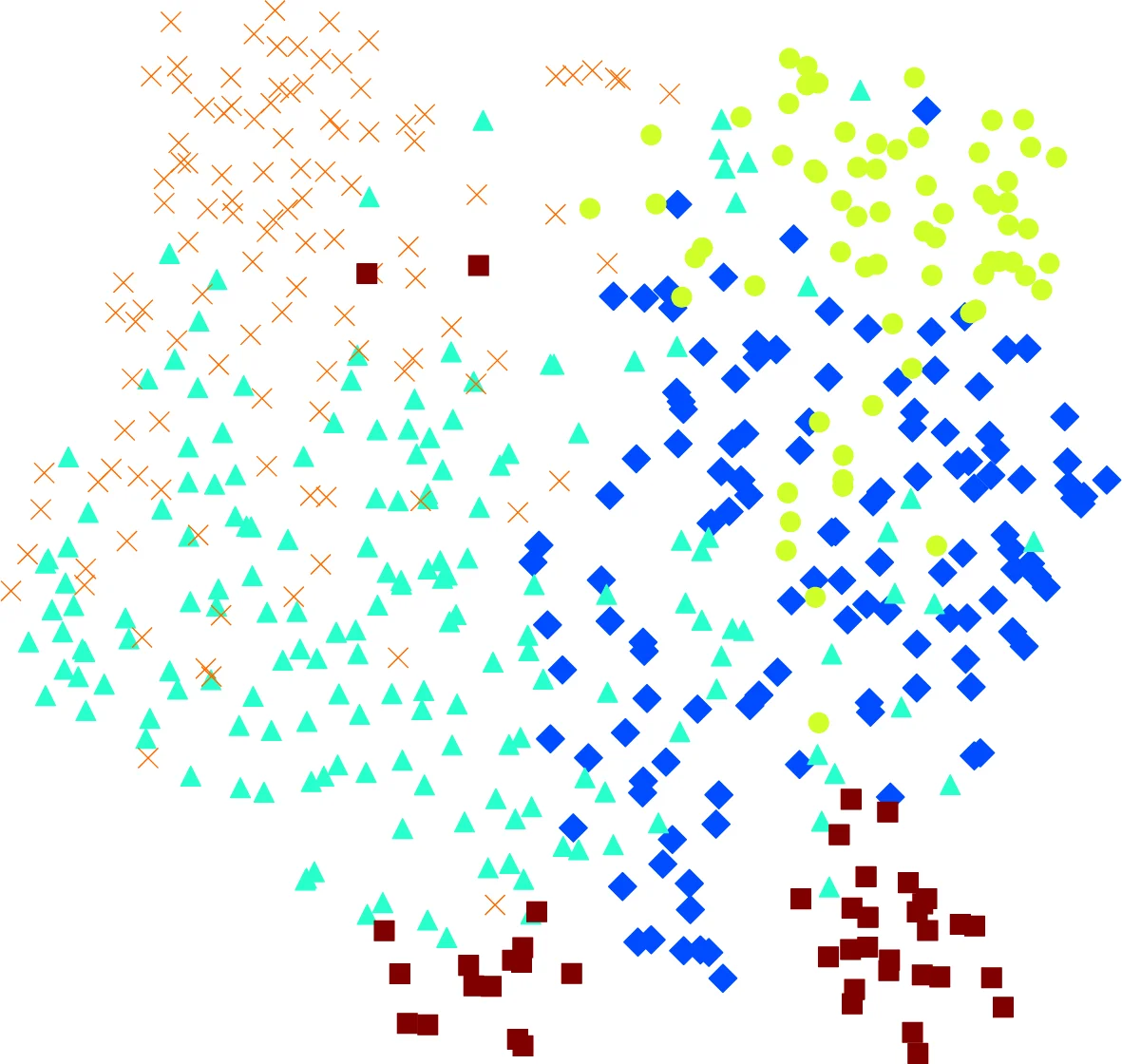

학습은 두 단계로 진행된다. 1) 비지도 임베딩 M을 대규모 텍스트만으로 사전 학습하고, 2) 사용자-아이템 상호작용 데이터를 이용해 TER+ 전체를 pairwise ranking loss로 미세조정한다. 실험에서는 CiteULike와 Yahoo! News 두 데이터셋을 사용해, 각각 ‘제목만’과 ‘제목+요약’ 두 버전으로 평가하였다. 결과는 TER+가 기존 TF‑IDF 기반 코사인 유사도, 다중 작업 로지스틱 회귀, CDL(협업 딥러닝) 등과 비교해 NDCG와 Recall에서 현저히 우수함을 보여준다. 특히 텍스트 길이가 짧은 경우에도 CNN 기반 f(x)와 비지도 임베딩 결합이 강력한 성능을 발휘한다.

핵심 기여는 (1) 텍스트와 사용자를 동일 잠재 공간에 매핑하는 일반화 가능한 프레임워크, (2) 비지도 텍스트 임베딩을 유연하게 결합하는 모듈 설계, (3) 콜드 스타트 상황에서도 실용적인 성능 향상을 입증한 광범위한 실험이다. 이 접근은 뉴스 피드, 학술 논문 추천 등 텍스트 중심의 실시간 서비스에 바로 적용 가능하며, 향후 멀티모달(이미지·비디오)와의 확장 가능성도 열어준다.

댓글 및 학술 토론

Loading comments...

의견 남기기