언제 멈출까 의미 이웃에게 물어보라

초록

본 논문은 기하학적 의미 기반 진화 알고리즘인 GSGP와 신경망용 Semantic Learning Machine(SLM)에서, 의미 변이 이웃 정보를 활용한 두 가지 새로운 정지 기준을 제안한다. 오류 편차 변화(EDV)와 학습 향상 효율성(TIE)을 이용해 과적합이 시작되는 시점을 자동으로 탐지하고, 고정 스텝과 최적 스텝 두 가지 스텝 전략과 결합해 실험하였다. 세 개의 고차원 약물 데이터셋에서 제안 기법은 일반화 성능을 유지하면서 학습 시간을 크게 단축하고, 모델 크기도 작게 유지함을 보였다.

상세 분석

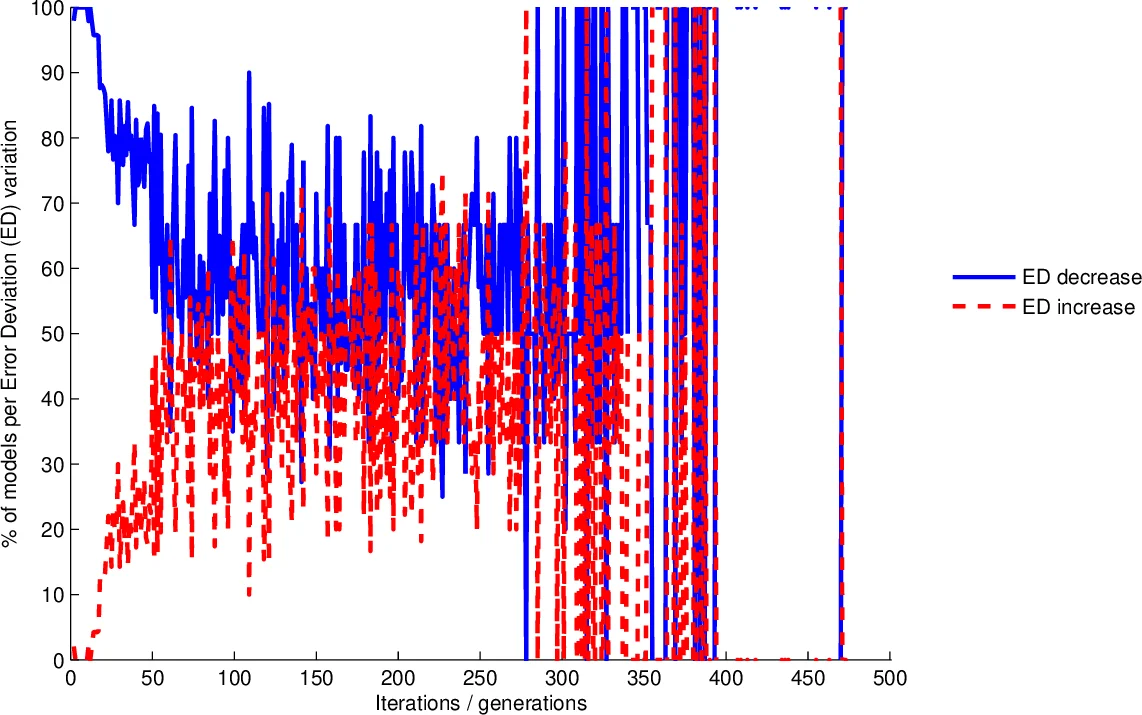

이 연구는 의미 기반 진화 방법이 제공하는 “의미 공간”을 정밀히 활용한다는 점에서 혁신적이다. GSGP와 SLM은 모두 의미 변이 연산자를 통해 현재 최적 모델의 의미(출력 벡터)를 주변 이웃으로 이동시키며, 이때 변이 크기를 제어하는 ‘스텝(step)’ 파라미터가 핵심 역할을 한다. 논문은 두 가지 정지 기준을 설계했다. 첫 번째인 오류 편차 변화(EDV)는 현재 최적 모델보다 성능이 좋은 이웃 중에서 오류 편차(절대 오차의 표준편차)가 감소하는 비율을 측정한다. 이 비율이 사전에 정의한 임계값 이하로 떨어지면, 학습이 특정 데이터 포인트에 과도하게 맞춰지고 있음을 의미해 정지를 결정한다. 두 번째인 학습 향상 효율성(TIE)은 의미 변이 연산자가 현재 세대에서 얼마나 자주 더 나은 이웃을 생성하는지를 백분율로 나타낸다. TIE가 임계값 이하로 감소하면, 새로운 개선이 점점 어려워지고 과적합 위험이 커짐을 암시한다.

두 정지 기준 모두 기존의 정지 판단(예: 고정 에포크 수, 검증 오차 감소)보다 더 미세한 신호를 포착한다. 특히 의미 변이 연산이 항상 전역 최적을 향해 나아가는 ‘단일봉우리’ 특성을 갖는 점을 활용해, 이웃 샘플링 자체가 별도의 비용 없이 정지 판단에 사용될 수 있다.

실험 설계는 세 개의 실제 약물 데이터셋(Bio, PPB, LD50)에서 30번의 독립 실행을 수행했으며, 훈련/검증 비율을 70/30으로 고정했다. 각 실행에서 샘플 크기 100의 이웃을 생성하고, 두 스텝 전략을 비교했다. Fixed Step(FS)은 사전에 지정된 변이/학습 스텝을 유지하고, Optimal Step(OS)은 매 변이마다 Moore‑Penrose 역을 이용해 현재 데이터에 최적화된 스텝을 계산한다. 결과는 다음과 같다. ① EDV와 TIE 모두 적절한 임계값을 설정하면, 과적합이 시작되는 시점을 정확히 포착해 평균 학습 시간을 70% 이상 단축한다. ② OS 전략은 FS에 비해 일반화 RMSE가 약 2~5% 개선되면서도 모델 크기(트리 깊이 또는 신경망 가중치 수)를 크게 늘리지 않는다. ③ 제안된 정지 기준을 적용한 SLM은 평균 3초 이내, GSGP는 10초 이내에 학습을 마쳐 실시간 적용 가능성을 보여준다.

이러한 결과는 의미 기반 진화가 제공하는 ‘의미 이웃’ 정보를 정지 판단에 활용함으로써, 전통적인 검증 기반 조기 종료보다 더 효율적이고 안정적인 학습 제어가 가능함을 입증한다. 또한, 최적 스텝 계산이 의미 변이와 결합될 때 모델 복잡도와 일반화 사이의 트레이드오프를 자연스럽게 조정할 수 있음을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기