깊고 넓은 신경망의 손실 지형: 거의 모든 지역 최소점이 전역 최적

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

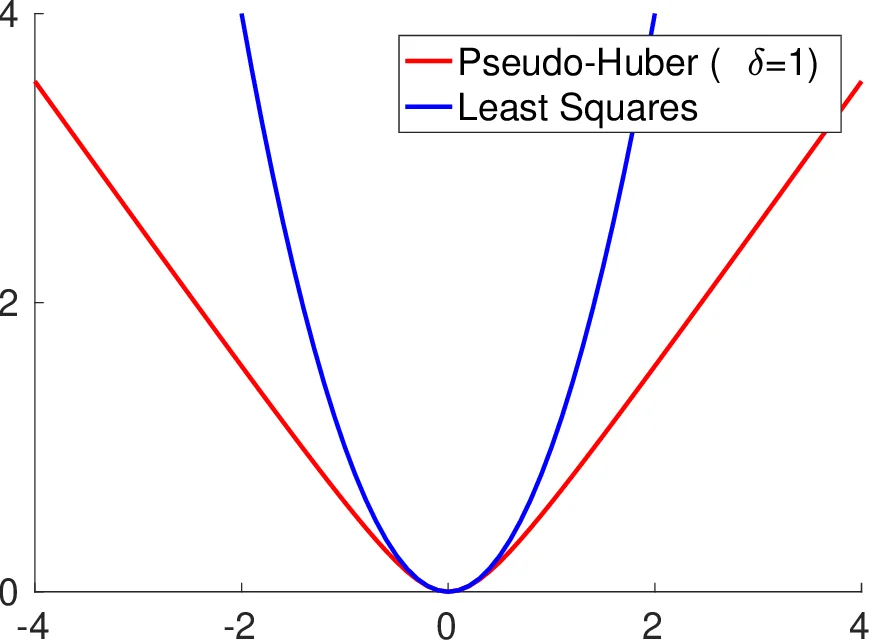

이 논문은 완전 연결 피드포워드 네트워크에서, 하나의 은닉층이 학습 샘플 수보다 넓고 그 이후 층이 피라미드 형태(폭이 감소)일 경우, 거의 모든 지역 최소점이 전역 최소점이 됨을 증명한다. 활성화 함수는 실분석(analytic)이고 손실은 제곱오차와 같은 연속 미분 가능 함수라면 결과가 적용된다.

상세 분석

본 연구는 “과잉 지정(over‑parameterized)” 신경망의 손실 곡면을 수학적으로 분석한다. 핵심 가정은 (1) 네트워크에 최소 하나의 은닉층이 존재하며, 그 층의 뉴런 수 n₁이 학습 샘플 수 N보다 크다(n₁ > N). (2) 그 이후의 층들은 폭이 점진적으로 감소하는 피라미드 구조를 이루어, 각 가중치 행렬 Wₖ (k ≥ 2)가 풀 컬럼 랭크를 갖는다. (3) 활성화 함수 σ는 실분석이며 단조 증가, 또한 σ′(·) > 0 를 만족한다. 손실 함수 l은 C² 연속이며, l′(a)=0이면 a가 전역 최소값(즉 a=0)임을 전제한다. 이러한 전제 하에 저자들은 다음과 같은 논리 전개를 수행한다.

첫째, 역전파 식을 정리한 Lemma 2.1을 이용해 각 층의 오류 행렬 Δₖ와 가중치 행렬 사이의 관계 Δₖ = (Δₖ₊₁ Wₖ₊₁ᵀ) ∘ σ′(Gₖ) 를 도출한다. 여기서 ∘는 원소곱(Hadamard)이며, Gₖ는 활성화 전 선형 변환 결과이다.

둘째, 데이터 행렬

댓글 및 학술 토론

Loading comments...

의견 남기기