왜 베이지안 샘플링이 낙관주의보다 강화학습에 더 효율적인가

본 논문은 베이지안 강화학습에서 후방 샘플링(PSRL)이 기존 낙관주의 기반 알고리즘(UCRL2 등)보다 왜 더 뛰어난 성능을 보이는지를 이론적으로 분석한다. 저자는 PSRL이 낙관주의 알고리즘의 베이즈 regret 상한을 2배 이내로 매칭한다는 정리를 제시하고, 기존 OFU 방식이 신뢰집합을 과도하게 보수적으로 구성해 √S·√H 차원의 비효율을 초래함을 지적한다. 이를 바탕으로 PSRL에 대해 새로운 베이즈 regret 상한 \(\tilde …

저자: Ian Osb, Benjamin Van Roy

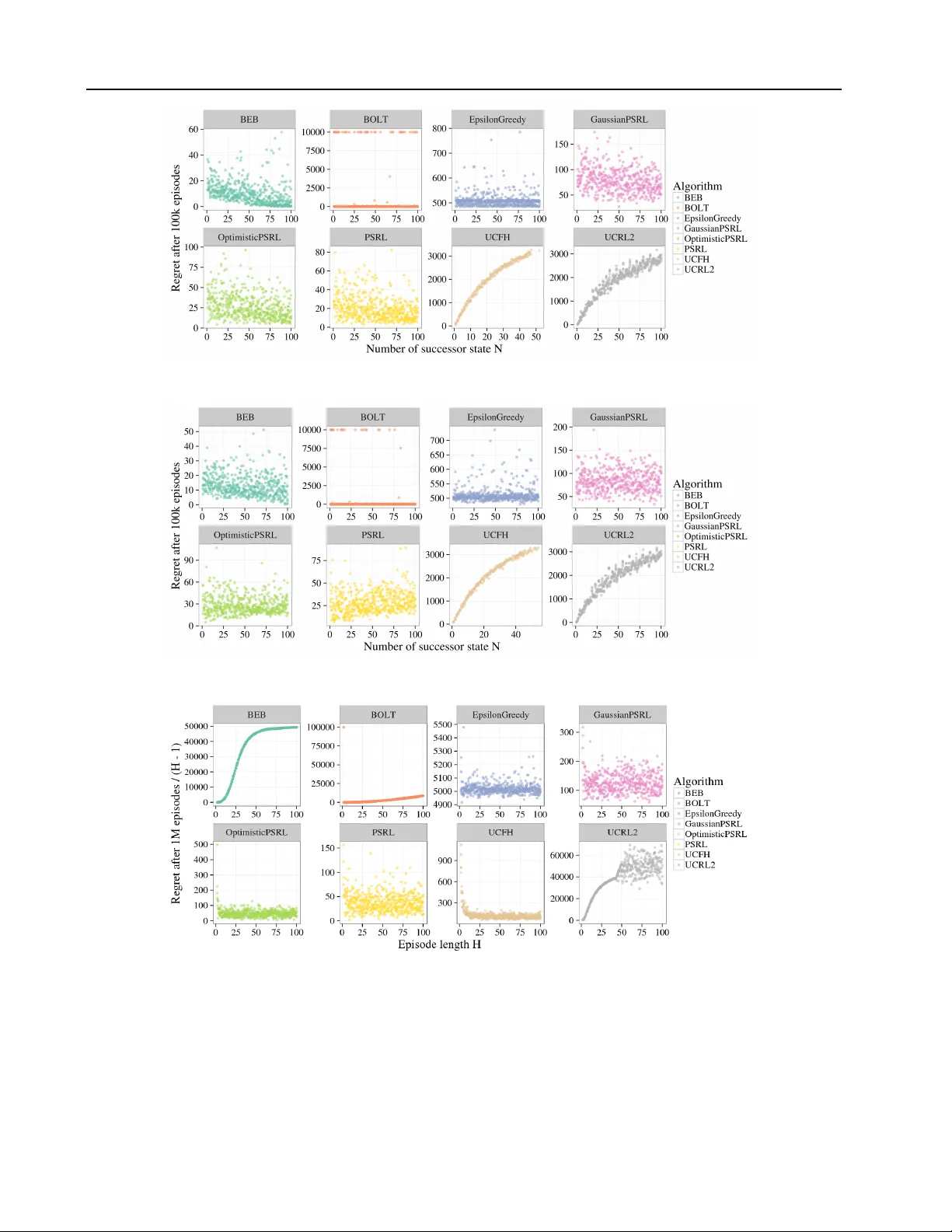

본 논문은 베이지안 강화학습에서 두 가지 주요 탐험 전략, 낙관주의 기반 OFU(Optimism in the Face of Uncertainty)와 베이지안 샘플링 기반 PSRL(Posterior Sampling for Reinforcement Learning)을 비교·분석한다. 서론에서는 강화학습 에이전트가 장기 보상을 최대화하기 위해 탐험과 활용을 어떻게 균형 잡아야 하는지를 논의하고, 동적 프로그래밍을 통한 베이즈 최적해는 계산적으로 비현실적임을 지적한다. 따라서 실용적인 알고리즘 설계가 필요하며, 기존 OFU 알고리즘이 통계적 효율성 면에서 좋은 성과를 보였지만 실제 실험에서는 PSRL이 현저히 우수함을 보여준다.

문제 정의에서는 유한-호라이즌 에피소드 MDP \(M^* = (S, A, R^*, P^*, H, \rho)\) 를 소개하고, 베이즈 관점에서 MDP 자체를 사전분포 \(\phi\) 로 모델링한다. 정책 \(\mu\)와 가치 함수 \(Q^{\mu}_{M,h}\), \(V^{\mu}_{M,h}\) 를 정의하고, regret와 Bayesian regret를 각각 (2)-(4) 식으로 정형화한다. 여기서 regret는 에피소드별 최적 정책과 현재 정책 간의 가치 차이이며, Bayesian regret는 사전분포에 대한 기대값이다.

3절에서는 OFU와 PSRL의 알고리즘 구조를 비교한다. OFU는 매 에피소드마다 현재 데이터에 기반한 신뢰집합 \(\mathcal{M}_k\) 를 구성하고, 그 안에서 가장 낙관적인 MDP와 정책을 선택한다. 반면 PSRL은 사후분포에서 하나의 MDP \(M_k\) 를 샘플링하고, 해당 MDP에 대해 최적 정책을 구한다. 두 알고리즘 모두 매 단계에서 정책을 고정하고 에피소드를 진행한다.

3.1절은 전통적인 OFU regret 분석 흐름을 요약한다. (1) 신뢰집합 설계, (2) regret를 최적성 오차와 집중 오차로 분해, (3) 최적성 오차는 신뢰집합에 포함될 확률이 1‑δ이므로 비양성, (4) 집중 오차를 전체 트래젝터리에 대해 합산해 고확률 상한을 얻는다.

3.2절에서는 “stochastic optimism” 개념을 도입한다. 정의에 따르면 임의 변수 X가 Y보다 stochastically optimistic 하면 모든 convex, increasing 함수 u에 대해 \(E

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기