OSG 기반 LIGO 데이터 접근을 위한 분산 캐시 인프라 구축

초록

본 논문은 2015‑2016년 LIGO 관측 데이터를 PyCBC 파이프라인으로 분석하기 위해 Open Science Grid(OSG) 상에 분산형 데이터 접근 체계를 구현한 과정을 다룬다. XRootD와 CVMFS를 결합한 캐시‑프록시 구조를 통해 원격 저장소에서 POSIX 인터페이스를 제공하고, 대규모 작업 부하에서도 효율적인 전송과 확장성을 확보하였다.

상세 분석

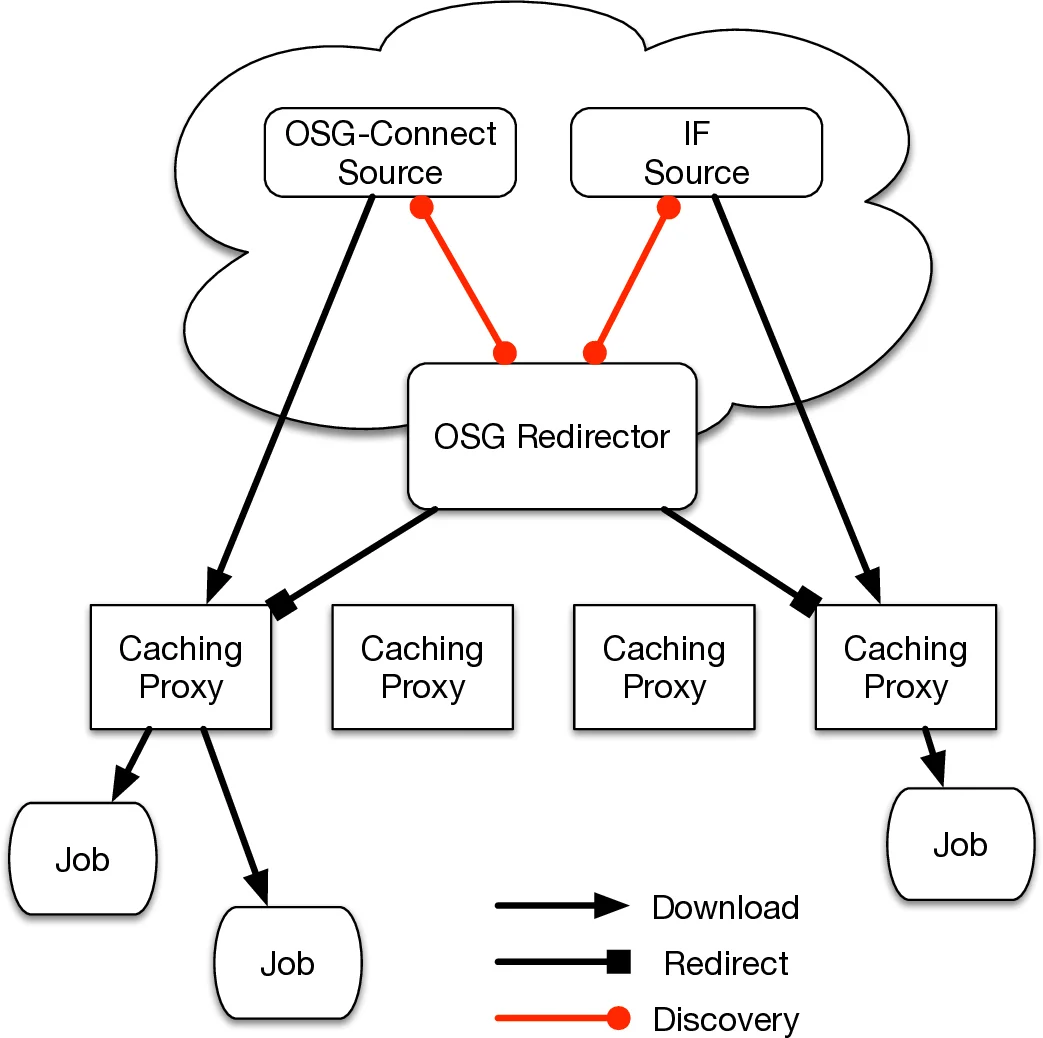

LIGO의 PyCBC 워크플로는 수십만 개의 HT‑Condor 배치 작업으로 구성되며, 각 작업은 400 MB 규모의 프레임 파일을 1 Mbps 정도의 지속적인 속도로 읽어야 한다. 기존에 Nebraska의 HDFS 기반 GridFTP 서버를 이용한 직접 전송 방식은 메모리 사용량이 연결당 128 MB에 달해 수천 개의 동시 연결이 발생하면 서버가 메모리 고갈에 빠지는 병목을 초래한다. 저자들은 이를 해결하기 위해 경량화된 멀티스레드 모델을 갖는 XRootD 서버로 전환하고, OSG 전역에 배치된 StashCache 프록시를 활용해 데이터 페더레이션을 구현하였다. 프록시들은 지역 캐시를 유지하면서 필요 시 OSG‑Redirector를 통해 중앙 저장소(주로 Nebraska HDFS)에서 데이터를 스트리밍한다. 이 구조는 데이터 재사용률이 높은 LIGO 워크플로에 적합한 “읽기‑전용” 캐시 정책을 제공하며, 캐시 미스가 발생할 경우 자동으로 원본에 요청해 최신 데이터를 확보한다. 또한 CVMFS를 확장해 비공개 대용량 데이터셋을 안전하게 배포함으로써 POSIX‑호환 파일 시스템 인터페이스를 제공한다. 이러한 설계는 다음과 같은 핵심 장점을 만든다. 첫째, 작업 시작 속도와 전송량을 독립적으로 조절할 수 있어 급격한 워크로드 증가에도 서비스 중단 없이 확장이 가능하다. 둘째, XRootD의 저메모리 footprint가 수천 개의 동시 연결을 처리하도록 하여 GridFTP 대비 메모리 압박을 크게 완화한다. 셋째, StashCache 프록시가 지리적으로 분산돼 있기 때문에 네트워크 지연과 대역폭 제한을 최소화하고, 데이터 접근 지연을 수 초 수준으로 낮춘다. 마지막으로, 비전통적인 HPC 자원(TACC Stampede, EGI 기반 VIRGO 사이트)과도 통합이 용이하도록, CVMFS가 없는 환경에서는 rsync 기반 동기화와 Globus Transfer를 활용해 일회성 데이터 복제를 수행한다. 전체 시스템은 파일 접근을 POSIX 형태로 추상화함으로써 사용자 입장에서 복잡한 데이터 관리 로직을 숨기고, 파이프라인 개발에만 집중할 수 있게 한다. 이러한 접근 방식은 LIGO와 같은 대규모 과학 협업에서 데이터 복제 비용을 크게 절감하고, 다양한 컴퓨팅 자원을 효율적으로 활용하는 모델로서 향후 다른 빅데이터 과학 프로젝트에도 적용 가능성을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기