2016년 미국 대선 트위터 루머 탐지와 행동 분석

초록

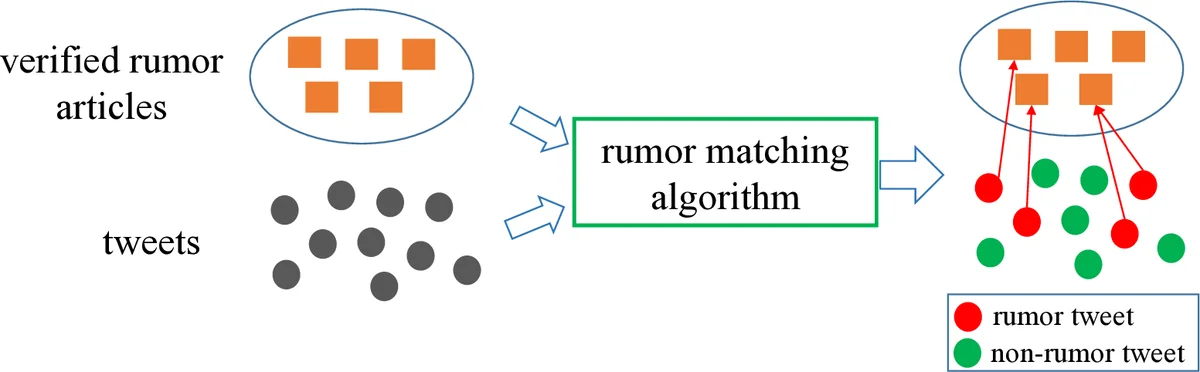

본 논문은 Snopes에서 검증된 루머 기사와 트위터 팔로워들의 트윗을 매칭하여 8백만 건 이상의 트윗 중 루머를 자동 탐지하고, 힐러리 클린턴·도널드 트럼프 지지자들의 루머 게시 비율, 주요 확산자, 루머 주제 및 시간적 패턴을 분석한다. 텍스트 매칭에는 BM25가 가장 높은 정밀도와 재현율을 보였으며, 트럼프 지지자들이 선거 기간에 루머를 더 많이 게시한다는 결과를 도출한다.

상세 분석

이 연구는 2016년 미국 대선 기간 동안 트위터에서 발생한 루머 현상을 정량적으로 파악하고자 하는 최초의 시도 중 하나이다. 기존의 지도학습 기반 루머 탐지 방법은 대량의 라벨링 비용과 ‘블랙박스’ 특성으로 인해 정치적 실시간 분석에 한계가 있었으며, 저자들은 이를 극복하기 위해 Snopes.com에서 검증된 1,723개의 루머 기사 집합을 ‘골드 스탠다드’로 삼아 텍스트 매칭 기반 탐지 프레임워크를 설계하였다. 매칭 알고리즘 후보로는 TF‑IDF, BM25, Word2Vec, Doc2Vec, 그리고 기존 연구에서 제안된 키워드 기반 Lexicon Matching을 비교하였다. 5,000개의 수동 라벨링 트윗을 이용한 정밀·재현율 곡선 분석 결과, BM25가 F1 점수 0.82로 가장 우수했으며, 특히 비루머 트윗을 효과적으로 배제해 높은 정밀도(94.7%)를 달성하였다. 또한, 루머 식별 정확도(특정 루머 기사와 매칭)에서도 BM25가 79.9%로 최고 성능을 보였다.

데이터 수집 단계에서는 각 후보의 팔로워 10,000명씩을 무작위 추출해 최대 3,000개의 최신 트윗을 수집, 결과적으로 클린턴 지지자 7,283명·트럼프 지지자 7,339명으로부터 각각 약 4.45백만·4.28백만 트윗을 확보하였다. 라벨링을 위해 100개의 루머 기사에서 키워드 기반 검색으로 후보 트윗을 추출하고, 수작업으로 2,500개의 루머 트윗과 2,500개의 비루머 트윗을 구성하였다. 이 데이터는 루머 분류와 동시에 ‘어떤 루머인지’ 식별하는 두 가지 과업에 활용되었다.

분석 결과, 전체 기간 동안 클린턴 지지자들의 루머 트윗 비율이 1.20%로 트럼프 지지자(1.16%)보다 약간 높았으나, 선거 기간(4월~선거일)에서는 트럼프 지지자들의 비율이 1.35%로 급증해 클린턴 지지자(1.26%)를 앞섰다. 이는 선거가 가까워질수록 트럼프 측 지지자들의 루머 생산성이 상승했음을 시사한다. 사용자 수준 분석에서는 상위 10%의 활발한 사용자가 전체 루머 트윗의 50%를, 상위 20%가 70%를 차지하는 ‘소수 정예’ 현상이 발견되었다. 이들 사용자는 전체 트윗 대비 루머 비율도 높아, 단순히 활동량이 많은 것이 아니라 루머 전파에 특화된 행동 양식을 보였다. 한 사례 분석에서는 특정 트럼프 지지자가 전체 트윗 중 9.6%를 루머로 분류했으며, 주요 루머 주제가 클린턴·버니·샌더스와 관련된 것을 확인했다.

기술적 관점에서 본 연구의 강점은 라벨링 비용을 최소화하면서도 해석 가능한 매칭 결과를 제공한다는 점이다. BM25 기반 매칭은 단어 빈도와 문서 길이를 정규화해 짧은 트윗에서도 의미 있는 매칭을 가능하게 하며, 매칭 점수 임계값을 조정함으로써 정밀도와 재현율 사이의 트레이드오프를 유연하게 관리한다. 그러나 한계도 존재한다. 첫째, 루머 기사와 트윗 간 어휘 차이가 클 경우 매칭 실패 가능성이 있다. 둘째, BM25는 문맥적 의미를 충분히 포착하지 못해, 은유적·풍자적 표현이 포함된 루머를 놓칠 수 있다. 셋째, 데이터는 미국 주요 후보 두 명에 국한돼 있어 다당제 국가나 다른 정치 문화에 바로 적용하기 어렵다. 향후 연구에서는 최신 Transformer 기반 문장 임베딩을 도입해 의미 기반 매칭을 강화하고, 다국어 루머 데이터베이스와 연계해 국제적 정치 루머 탐지 프레임워크를 구축하는 방향이 제시된다.

댓글 및 학술 토론

Loading comments...

의견 남기기