이미지 단락 생성을 위한 계층적 접근

초록

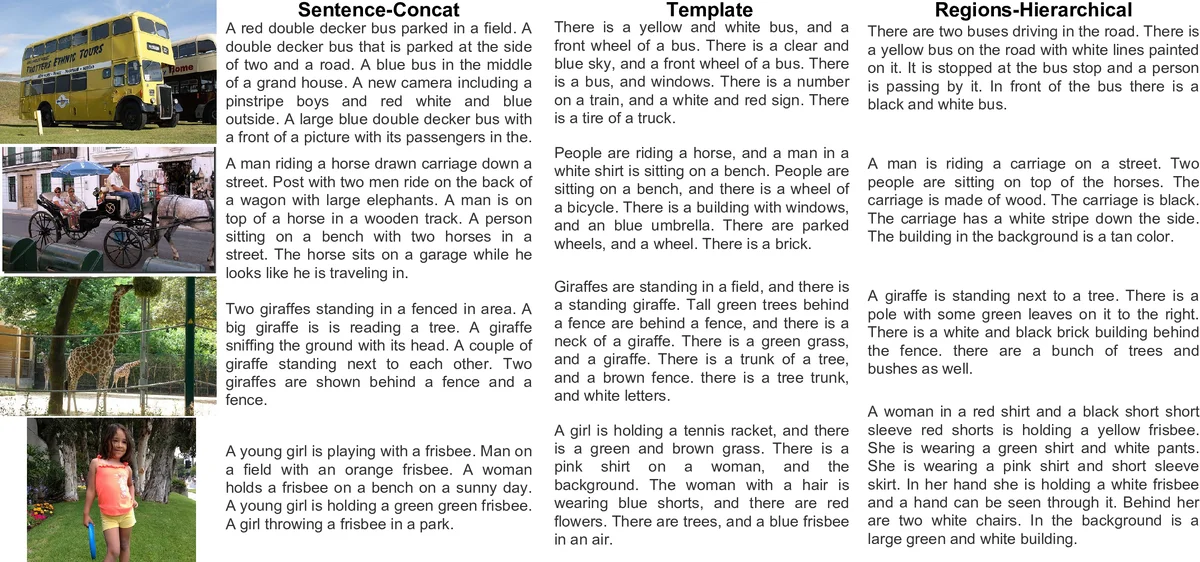

본 논문은 이미지 전체를 설명하는 긴 문단을 자동으로 생성하기 위해, 이미지에서 의미 있는 영역을 탐지하고 이를 계층적 RNN(문장‑레벨 RNN과 단어‑레벨 RNN)으로 연결하는 모델을 제안한다. 새롭게 구축한 이미지‑문단 데이터셋을 통해 기존 단일문 캡션 및 밀집 캡션 대비 높은 다양성과 상세성을 입증한다.

상세 분석

이 연구는 이미지 캡셔닝의 한계를 인식하고, “문단”이라는 새로운 출력 형태를 정의함으로써 두 가지 기존 접근법(단일 문장 캡션, 밀집 캡션)의 장점을 결합한다. 핵심 아이디어는 이미지와 텍스트 모두가 자연스럽게 계층적 구조를 가진다는 점이다. 이미지 측면에서는 객체와 배경, 관계를 포괄하는 의미 영역을 탐지하기 위해 기존의 Dense Captioning에 기반한 Region Proposal Network(RPN)를 활용한다. 50개의 후보 영역을 추출하고, 각 영역을 4096‑차원 CNN 피처로 변환한 뒤, 학습 가능한 투사 행렬 W_pool 과 바이어스 b_pool 을 통해 max‑pooling을 수행한다. 이 과정은 “집합 함수”를 근사함으로써 영역들의 정보를 손실 없이 압축하는 역할을 한다.

텍스트 측면에서는 두 단계의 LSTM을 도입한다. 첫 번째인 Sentence RNN은 풀링된 이미지 피처 v_p 를 입력으로 받아, 현재까지 생성된 문장의 은닉 상태를 기반으로 “문장 종료 확률” p_i 를 출력한다. 이 확률 분포는 베르누이 샘플링을 통해 문단의 길이 S (평균 5.7문) 를 동적으로 결정한다. 동시에 각 타임스텝마다 P‑차원 topic vector t_s 를 생성하여, 다음 단계인 Word RNN에 전달한다. Word RNN은 전통적인 LSTM 구조를 유지하면서, t_s 를 초기 은닉 상태 혹은 추가 입력으로 사용해 해당 문장의 단어 시퀀스를 생성한다. 이렇게 계층적 구조를 도입함으로써, 모델은 전체 문단을 한 번에 긴 시퀀스로 처리하는 경우보다 훨씬 짧은 시간 스케일(문장 수준 ≈ 5~6 스텝, 단어 수준 ≈ 12 스텝) 에 집중할 수 있어, 장기 의존성 학습이 용이해진다.

또한, 저자들은 “지식 전이”를 실현한다. Dense Captioning을 위해 사전 학습된 Region Detector와 그에 연관된 언어 모델 파라미터를 그대로 활용함으로써, 제한된 문단 데이터셋에서도 효과적인 초기화가 가능했다. 실험 결과, 전이 없이 학습한 모델에 비해 BLEU‑4, METEOR, CIDEr 점수가 유의미하게 상승했으며, 특히 문단 내 문장 간의 일관성과 코어퍼런스 처리 능력이 향상되었다.

데이터 측면에서는 MS COCO와 Visual Genome을 기반으로 19,551장의 이미지에 대해 1문단(평균 67.5 토큰) 을 수집하였다. 언어 통계 분석에서, 문단은 단일 캡션 대비 평균 6배 이상의 길이, 3배 이상의 어휘 다양성, 그리고 명사 대비 동사·대명사의 비중이 높아 “관계·행동”을 더 많이 기술한다는 점을 확인했다. 이러한 정량적 분석은 문단 생성이 단순히 길이를 늘리는 것이 아니라, 의미적 깊이와 구조적 복잡성을 동시에 증가시킨다는 것을 뒷받침한다.

전체적으로 이 논문은 이미지‑텍스트 매핑을 “계층적”이라는 관점에서 재구성함으로써, 기존 캡션 모델이 갖는 정보 손실과 일관성 부족 문제를 해결한다. 영역 기반 이미지 표현, max‑pooling 집합 함수 근사, 동적 문장 수 결정, 그리고 문장‑단어 수준의 이중 LSTM 구조는 서로 보완적으로 작용해, 인간이 쓰는 서술적 문단에 근접한 자동 생성 시스템을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기