고밀도 연관 기억과 딥러닝 활성화 함수의 새로운 연결

이 논문은 고차원 상호작용을 갖는 고밀도 연관 기억 모델을 제안하고, 이를 한 층 피드포워드 신경망의 비선형 활성화 함수와의 이중성으로 연결한다. 다항식 및 정규화된 다항식 형태의 에너지 함수를 통해 저장 용량을 뉴런 수의 초과까지 확장하고, n 차수에 따라 특징 매칭 모드와 프로토타입 모드 사이를 연속적으로 전환한다. 실험은 XOR 논리 게이트와 MNIST 손글씨 인식에서 n=3(정규화된 2차 다항식) 활성화가 기존 ReLU(n=2)보다 우수…

저자: Dmitry Krotov, John J Hopfield

본 논문은 뉴런 수보다 훨씬 많은 패턴을 저장하고 정확히 복원할 수 있는 고밀도 연관 기억(Dense Associative Memory, DAM) 모델을 제시한다. 기존 Hopfield 네트워크는 2차 상호작용 E=−½∑_ij σ_i T_ij σ_j 에 기반해 K≈0.14 N 정도의 용량 제한을 갖는다. 이를 극복하기 위해 저자들은 에너지 함수를 E=−∑_μ F(∑_i ξ_i^μ σ_i) 형태로 일반화하고, F(x)=xⁿ 또는 F(x)=max(0,x)ⁿ 과 같은 고차 다항식(또는 정규화된 다항식) 함수를 도입한다. n이 커질수록 개별 기억이 에너지에 미치는 영향이 급격히 커져, 동일한 구성 공간에 더 많은 기억을 겹치지 않게 배치할 수 있다. 수학적 분석을 통해 평균 에너지 갭 ΔE≈2ⁿ Nⁿ⁻¹ 와 분산 Σ²≈Ω_n K Nⁿ⁻¹ 을 구하고, 가우시안 근사 하에 오류 확률을 추정한다. 이를 기반으로 오류율을 0.5 % 이하로 제한하면 저장 용량이 K_max=α_n Nⁿ⁻¹ 이라는 비선형 스케일링을 보이며, n=2에서는 기존의 0.14 N 에 불과하지만 n≥4에서는 N을 크게 초과한다.

이러한 연관 기억 모델은 한 층 피드포워드 신경망과 이중성을 가진다. 가시 뉴런(입력) → 기억(은닉) → 출력(분류) 구조에서 은닉층의 활성화 함수는 g(x)=F′(x) 에 해당한다. n=2는 ReLU와 동일하고, n=3은 ‘정규화된 2차 다항식’(rectified parabola)으로 해석된다. 따라서 n을 조절함으로써 네트워크는 특징 매칭 모드(작은 n, 다수 기억이 기여)와 프로토타입 모드(큰 n, 최적 기억 하나가 지배) 사이를 연속적으로 전환한다.

논문은 두 가지 실험을 통해 이론을 검증한다. 첫 번째는 XOR 논리 게이트이다. 네 개의 입력‑출력 삼중항을 기억으로 저장하고, 입력 두 개만 고정한 채 출력 뉴런을 에너지 최소화에 따라 업데이트한다. n=1,2에서는 에너지 의존성이 사라져 XOR을 풀 수 없지만, n≥3에서는 z=sign(−x y) 라는 비선형 결정을 자연스럽게 얻어 XOR을 정확히 구현한다. 이는 고차 활성화가 선형 퍼셉트론이 불가능한 비선형 함수를 구현할 수 있음을 보여준다.

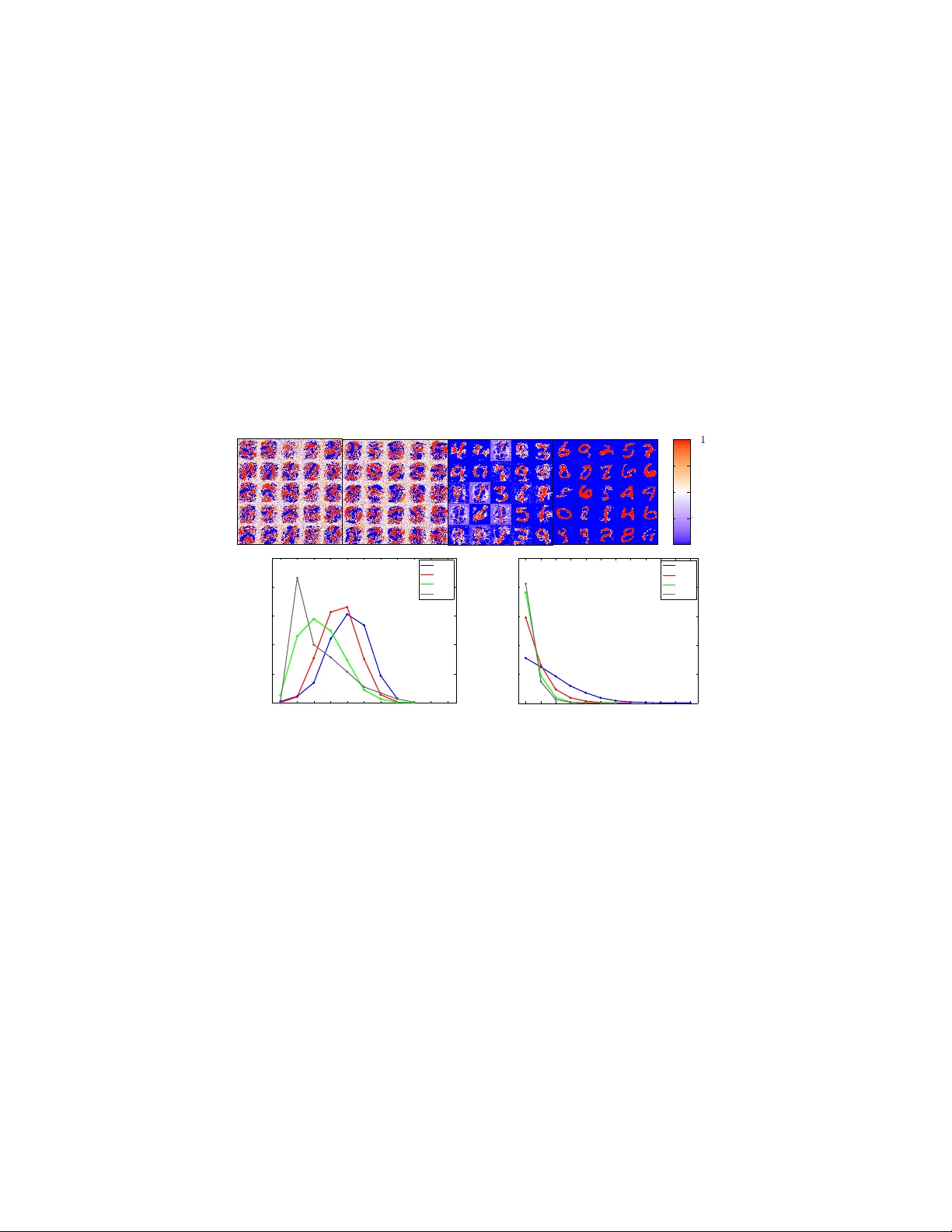

두 번째 실험은 MNIST 손글씨 숫자 인식이다. 가시 뉴런은 28×28=784개의 픽셀, 출력 뉴런은 10개의 클래스이다. K=2000개의 기억을 학습시키고, 가시 뉴런을 고정한 채 출력 뉴런을 한 번만 업데이트한다. 학습은 기억을 파라미터화한 뒤, 목표 출력과 실제 출력 사이의 손실을 최소화하도록 백프로파게이션을 수행한다. 실험 결과, n=3(정규화된 2차 다항식) 활성화가 n=2(ReLU)보다 평균 테스트 오류가 낮았다. 특히, 다양한 하이퍼파라미터 조합을 탐색한 후에도 n=3 모델이 전반적으로 더 빠르게 2 % 이하 오류에 도달했다. 이는 고차 활성화가 더 풍부한 표현력을 제공하고, 과적합을 억제하면서 일반화 성능을 향상시킬 수 있음을 시사한다.

결론적으로, 고차 에너지 함수를 통한 고밀도 연관 기억은 기존 신경망의 활성화 함수 설계에 물리적 직관을 제공한다. n을 매개변수화함으로써 특징 기반 매칭과 프로토타입 기반 인식 사이의 트레이드오프를 조절할 수 있으며, 아직 딥러닝에서 널리 사용되지 않은 고차 정규화 다항식 활성화 함수의 잠재적 가치를 입증한다. 향후 연구는 다층 구조로 확장하거나, 다른 도메인(예: 자연어 처리)에서의 적용 가능성을 탐색하는 방향으로 진행될 수 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기