부트스트랩 모델 집계로 분산 학습 효율 극대화

본 논문은 분산·프라이버시 보존 환경에서 로컬 모델들을 결합할 때 발생하는 부트스트랩 노이즈를 두 가지 분산 감소 기법으로 보정한다. 가중 M‑추정량과 선형 제어변량을 이용해 KL‑averaging의 통계 효율을 유지하면서 샘플 요구량을 크게 줄인다. 이론적 MSE 분석과 실험을 통해 제안 방법들의 우수성을 입증한다.

저자: Jun Han, Qiang Liu

본 논문은 데이터가 여러 로컬 서버에 분산 저장되거나 프라이버시 제약으로 인해 직접 접근이 불가능한 상황에서, 각 서버에서 학습된 확률 모델을 하나의 전역 모델로 결합하는 방법을 연구한다. 전통적인 접근법은 로컬 MLE 파라미터를 단순 평균(linear averaging)하는 것이지만, 이는 비볼록 로그우도, 라벨 스위칭과 같은 비식별 파라미터, 파라미터 차원 불일치 등 실무에서 자주 발생하는 문제에 취약하다. 이러한 한계를 극복하기 위해 KL‑averaging이 제안되었으며, 이는 각 로컬 모델과 전역 모델 사이의 KL 발산을 최소화하는 모델을 찾는 방식이다. 그러나 KL‑averaging을 정확히 계산하려면 각 로컬 모델에 대한 적분이 필요해 대부분의 경우 계산적으로 불가능하다.

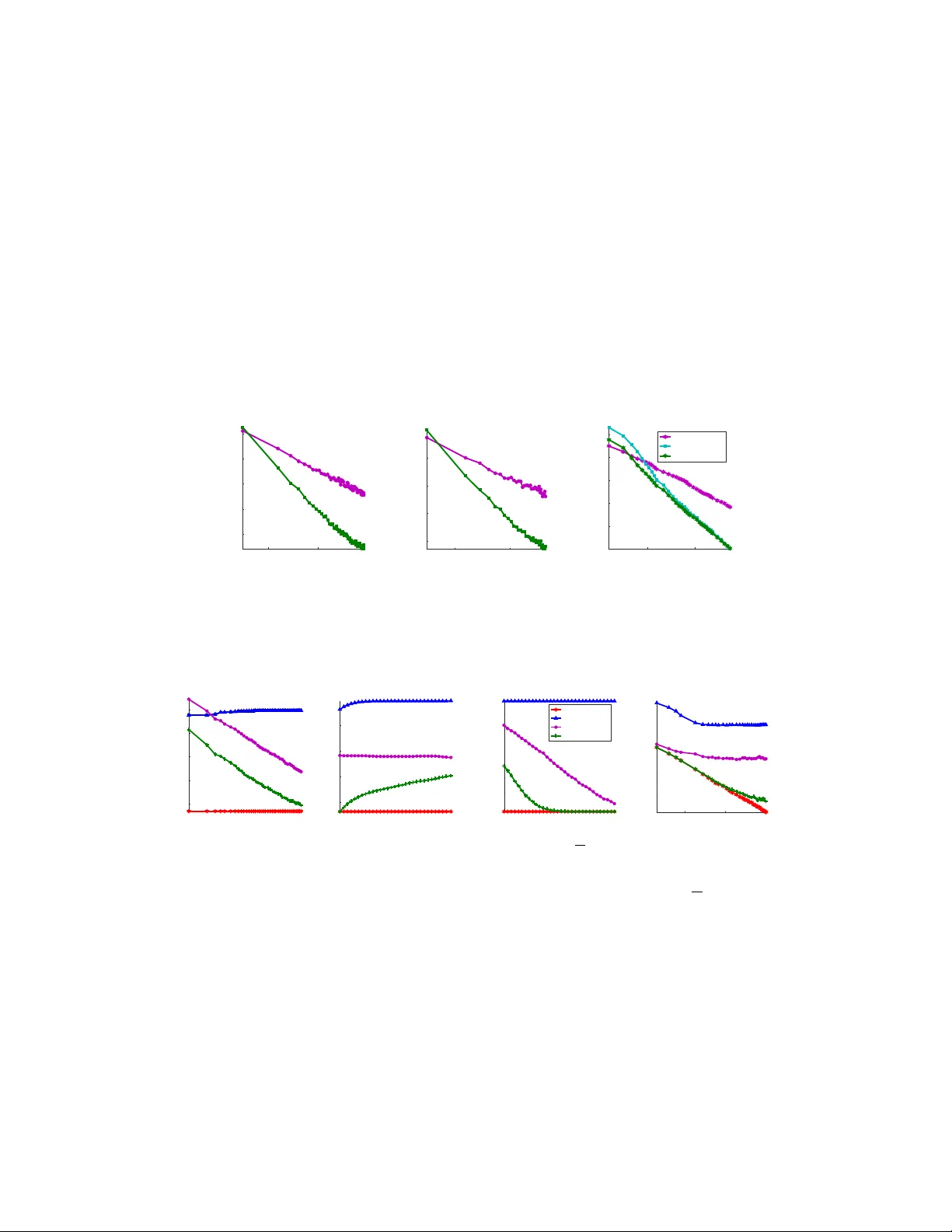

실제 구현에서는 각 로컬 모델 p(x|θ̂ₖ)로부터 부트스트랩 샘플을 n개씩 생성하고, 이를 이용해 KL‑naive 추정량 ˆθ_KL를 구한다. 이때 부트스트랩 노이즈가 크게 작용해, MSE가 O(N⁻¹ + (d n)⁻¹) 수준에 머물러 전역 MLE와 동등한 정확도를 얻으려면 n≈N/d가 필요하다. 이는 통신·저장 비용을 크게 증가시키는 비현실적인 요구이다.

논문은 이 문제를 해결하기 위해 두 가지 분산 감소 기법을 제시한다.

1. **선형 제어변량(KL‑Control) 방법**

- 각 로컬 부트스트랩 데이터 집합 eXₖ에 대해 재추정 파라미터 êθₖ를 구한다.

- 제어변량으로 (êθₖ − θ̂ₖ)를 사용하고, 최적 보정 행렬 Bₖ = −(∑ₖ I(θ̂ₖ))⁻¹ I(θ̂ₖ)를 도입한다.

- 최종 추정량은 ˆθ_KL−C = ˆθ_KL + ∑ₖ Bₖ(êθₖ − θ̂ₖ) 로 정의된다.

- 이 추정량은 일관성을 유지하면서 MSE가 O(N⁻¹ + (d n²)⁻¹) 로 감소한다. n이 (N/d)¹ᐟ² 정도만 커도 전역 MSE가 O(N⁻¹) 수준에 도달한다. 다만, 파라미터 선형 결합을 필요로 하므로 차원 불일치나 비식별 파라미터에 대한 제한이 남는다.

2. **가중 M‑추정(KL‑Weighted) 방법**

- 부트스트랩 샘플 eₖⱼ에 대해 실제 로컬 모델과 재추정 모델의 확률비 wₖⱼ = p(eₖⱼ|θ̂ₖ)/p(eₖⱼ|êθₖ)를 가중치로 사용한다.

- 가중 로그우도 η̂_w(θ)=∑ₖ (1/n)∑ⱼ wₖⱼ log p(eₖⱼ|θ) 를 최대화하여 ˆθ_KL−W를 얻는다.

- 이 가중 추정량은 η̂_w가 η에 대한 더 정확한 무편향 추정량임을 보이며, 분산이 η̂보다 작다.

- 이론적으로도 MSE가 O(N⁻¹ + (d n²)⁻¹) 로 감소하고, n이 (N/d)¹ᐟ² 이상이면 전역 추정 정확도가 O(N⁻¹) 로 수렴한다. 파라미터 형태에 독립적이므로 이산·범주형 파라미터, 차원 가변 모델에도 적용 가능하다.

두 방법 모두 Assumption 1(로그우도와 그 1·2차 도함수 연속성, Fisher 정보 행렬 양정성) 하에 일관성을 보장하고, asymptotic variance를 명시적으로 감소시킨다.

실험에서는 가우시안 혼합 모델, 베이지안 네트워크, 심층 신경망 등 다양한 비선형·비식별 모델에 대해 제안 기법을 적용하였다. 결과는 KL‑naive와 선형 평균에 비해 동일하거나 적은 부트스트랩 샘플 수로도 높은 정확도를 달성함을 보여준다. 특히, KL‑Weighted 방법은 파라미터 차원과 형태에 구애받지 않아 실무 적용 가능성이 가장 높다.

결론적으로, 본 연구는 부트스트랩 기반 분산 모델 집계에서 발생하는 노이즈를 제어변량과 가중 M‑추정이라는 두 축으로 효과적으로 억제함으로써, 통신·저장 비용을 최소화하면서도 통계 효율성을 유지하는 새로운 프레임워크를 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기