시각 객체 탐색을 위한 다중모달 대화 게임 GuessWhat

초록

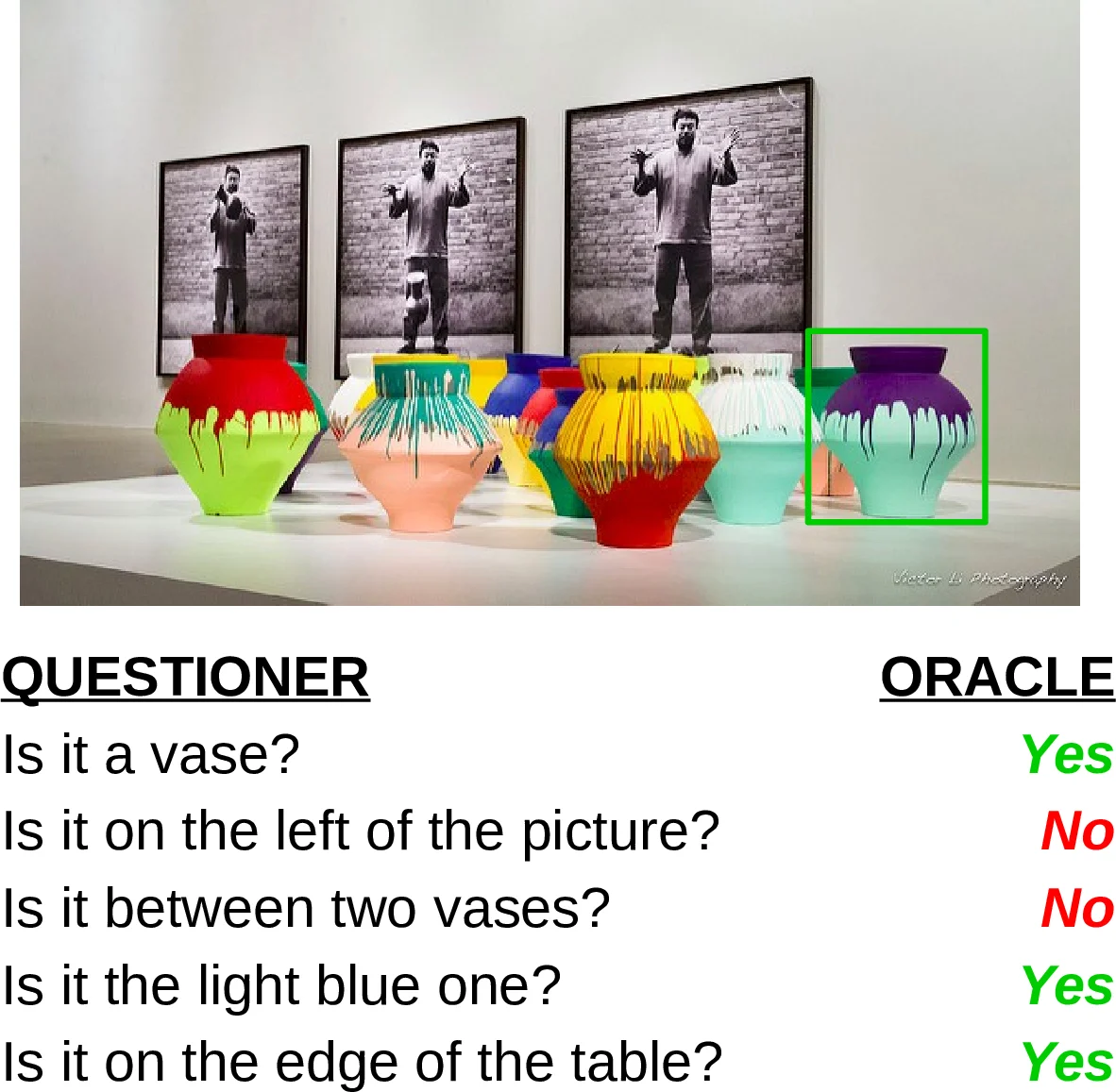

GuessWhat?!는 두 사람이 협력해 풍부한 이미지 속에서 숨겨진 객체를 찾는 게임이다. 질문자는 예/아니오 형태의 질문을 연속으로 던지고, 오라클은 해당 질문에 Yes·No·N/A 로 답한다. 저자들은 MS COCO 이미지에서 150 000여 게임(총 800 000개 질문‑답 쌍)을 수집해 데이터셋을 구축하고, 질문자와 오라클 역할을 각각 학습시키는 딥러닝 베이스라인을 제시한다.

상세 분석

본 논문은 시각 인식과 자연어 대화를 통합한 새로운 벤치마크를 제시한다는 점에서 의미가 크다. 먼저 데이터 수집 단계에서 저자들은 이미지 내 객체 수를 3~20개로 제한하고, 면적이 작은 객체는 제외함으로써 인간이 실제로 식별 가능한 장면만을 남겼다. 이는 VQA나 이미지 캡셔닝과 달리 “객체를 찾는” 과제가 요구하는 정밀한 공간·속성 정보를 보존한다는 장점이 있다. AMT를 활용한 두 단계(질문자·오라클) 게임 방식은 참여자 간 협업을 유도하고, 질문자에게는 성공률에 따라 보너스를 제공함으로써 데이터 품질을 높였다.

데이터 분석 결과, 전체 질문‑답 쌍 중 Yes와 No 비율이 각각 45.6 %와 52.2 %로 거의 균형을 이루며, N/A는 2.2 %에 불과해 이진 질문이 충분히 의미 있는 정보를 제공함을 확인할 수 있다. 평균 질문 수는 5.2개이며, 질문 수와 이미지 내 객체 수 사이의 관계는 로그와 선형 사이의 성장 형태를 보인다. 이는 인간 질문자가 완전한 이진 탐색보다는 상황에 따라 공간·속성·범주 등을 혼합한 전략을 사용한다는 것을 시사한다.

모델링 측면에서 저자들은 두 가지 핵심 태스크를 정의한다. ① 오라클 모델은 이미지와 대상 객체의 바운딩 박스를 입력받아 질문에 Yes·No·N/A 로 답하도록 설계했으며, CNN 기반 이미지 인코더와 질문 LSTM을 결합한 구조를 사용했다. ② 질문자 모델은 현재까지의 질문‑답 이력을 바탕으로 다음 질문을 생성하거나, 최종 객체를 추론한다. 질문 생성에는 Seq2Seq 구조와 강화학습 기반 정책 학습을 적용했으며, 객체 추론 단계에서는 후보 객체 집합을 점진적으로 축소하는 binary search‑like 전략을 모방하도록 설계했다.

베이스라인 실험 결과, 오라클 모델은 70 % 이상의 정확도를 달성했지만, 질문자 모델은 아직 인간 수준에 미치지 못한다. 특히 질문 생성 단계에서 의미론적 일관성 유지와 정보량 최적화가 어려워, 질문 수가 늘어날수록 성능이 급격히 감소한다는 한계가 드러났다. 이는 다중모달 대화에서 “어떤 질문이 가장 정보를 많이 줄 것인가”라는 메타‑전략을 학습하는 것이 현재 모델에선 미흡함을 보여준다.

이 논문은 데이터셋 자체가 큰 가치를 지니며, 향후 시각‑언어 상호작용, 강화학습 기반 대화 정책, 그리고 인간‑컴퓨터 인터페이스 연구에 풍부한 실험 기반을 제공한다. 특히 질문자와 오라클을 별도 모델로 분리함으로써 각각의 역할에 특화된 학습이 가능하고, 두 모델을 공동 최적화하는 멀티‑에이전트 학습 프레임워크를 탐구할 여지를 남긴다.

댓글 및 학술 토론

Loading comments...

의견 남기기