진화적 딥러닝 다윈식 신경망 합성

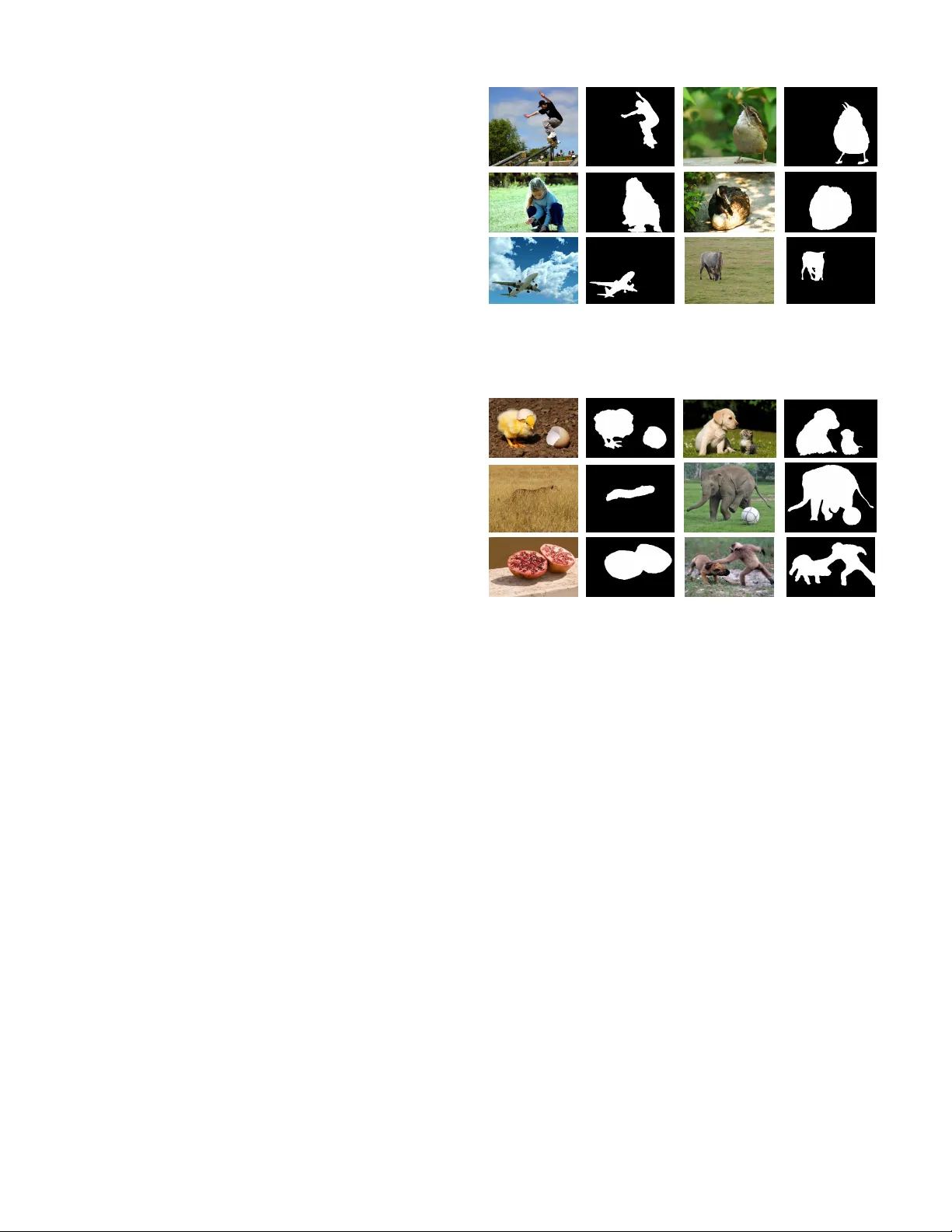

본 논문은 기존 딥 뉴럴 네트워크의 구조를 ‘DNA’라 간주하고, 이를 확률적 모델로 인코딩한 뒤 환경 제약과 무작위 변이를 결합해 여러 세대를 거치며 점진적으로 파라미터 수를 감소시킨 고효율 네트워크를 자동 생성한다. 실험은 시각적 살루시(visual saliency) 과제에 적용했으며, 4세대에 이르러 원본 VGG‑16 기반 모델 대비 약 48배 적은 시냅스 수를 유지하면서도 경쟁력 있는 Fβ 점수와 MAE를 달성하였다.

저자: Mohammad Javad Shafiee, Akshaya Mishra, Alex

본 논문은 “딥러닝 네트워크가 자연 진화처럼 세대를 거듭하며 스스로 효율적인 구조로 변형될 수 있는가?”라는 질문을 출발점으로, 기존 딥러닝 모델을 생물학적 DNA와 유사한 확률적 ‘시냅스 DNA’로 인코딩하고, 환경 제약과 무작위 변이를 결합한 진화적 합성 과정을 제안한다. 저자들은 먼저 네트워크 구조를 가능한 뉴런 집합 N 과 시냅스 집합 S 로 정의하고, 한 세대 g의 구조 H_g 를 이전 세대 H_{g‑1} 로부터 조건부 확률 P(H_g|H_{g‑1}) 로 표현한다. 여기서 핵심은 시냅스 강도 w_{g‑1,k} 를 이용해 시냅스 존재 확률을 지수분포 형태로 모델링한 P(S_g|W_{g‑1}) (식 1)이다. 이 확률 모델은 강한 연결을 ‘우수 형질’로 간주해 후손에게 높은 유전 확률을 부여한다는 의미이며, 기존 프루닝 기법과 달리 확률적 유전 과정을 통해 구조적 다양성을 보존한다.

자연 선택과 무작위 변이는 환경 제약 함수 F(E) 와 무작위 샘플링 U(0,1) 으로 구현된다. 환경 제약은 특히 시냅스 총량을 C (예: 0.4) 로 제한함으로써 에너지 효율성을 강제한다. 식 3에서 P(H_g)=C·P(S_g|W_{g‑1}) 로 정의된 합성 확률은 ‘DNA’와 환경 압력이 곱해진 형태이며, 이는 진화론적 적합도(fitness)를 수학적으로 표현한 것이다. 실제 네트워크 합성 단계에서는 각 후보 시냅스 s_{g,k} 가 P(s_{g,k}) ≥ U(0,1) 을 만족하면 네트워크에 포함시키고, 이렇게 생성된 구조를 초기화 후 전통적인 역전파 학습으로 완전한 모델로 만든다. 따라서 ‘태아 단계’에서부터 ‘성인 단계’까지 전 과정을 자동화한다.

실험은 시각적 살루시(visual saliency) 과제에 두 개의 대규모 데이터셋(MSRA‑B, HKU‑IS)을 사용해 수행되었다. 첫 세대는 VGG‑16 기반의 복합 인코더‑디코더 구조를 그대로 채택했으며, 이후 2~4세대에서는 각 세대마다 시냅스 수를 40% 이하로 제한하는 환경 제약을 적용하였다. 결과는 다음과 같다.

- 1세대: 시냅스 63,767,232개, Fβ 0.875, MAE 0.0743

- 2세대: 시냅스 15,471,797개 (4.12배 감소), Fβ 0.876, MAE 0.0739

- 3세대: 시냅스 3,603,007개 (17.69배 감소), Fβ 0.861, MAE 0.0813

- 4세대: 시냅스 1,333,010개 (47.83배 감소), Fβ 0.850, MAE 0.0863

MSRA‑B 데이터셋에서는 2·3세대가 기존 최첨단 방법(Li et al.)을 능가하거나 동등한 Fβ 점수를 기록했으며, 시냅스 수는 약 18배 감소했다. HKU‑IS에서도 2세대가 0.826의 Fβ 점수로 기존 0.8을 상회했으며, 시냅스는 약 4배 감소했다. 전반적으로 네트워크 용량이 크게 줄어들었음에도 불구하고 성능 저하가 미미한 점은 진화적 합성 과정이 핵심 기능을 보존하면서 불필요한 파라미터를 효과적으로 제거한다는 것을 보여준다.

논문의 주요 기여는 다음과 같다. 1) 기존 딥러닝 압축 방법과 달리 확률적 ‘DNA’ 모델을 도입해 세대 간 유전·변이를 수학적으로 정의하였다. 2) 환경 제약을 확률적 곱셈 형태로 모델링함으로써 에너지·자원 제한 상황을 정량적으로 반영하였다. 3) 매우 깊고 복잡한 VGG‑16 기반 네트워크에 대해 4세대까지 확장 가능한 진화적 합성 프레임워크를 실증하였다.

하지만 몇 가지 한계도 존재한다. 현재 모델은 시냅스 강도만을 기반으로 확률을 정의하고, 레이어 구조 자체의 변이(예: 레이어 추가·제거, 커널 크기 변화)는 다루지 않는다. 환경 제약도 시냅스 비율 C 로만 단순화했기 때문에 실제 하드웨어 전력, 메모리 대역폭, 지연시간 등 복합적인 제약을 반영하기엔 부족하다. 또한 무작위 변이가 완전히 통제되지 않아 최적 구조에 도달하는 데 필요한 세대 수가 데이터와 환경 설정에 따라 크게 달라질 수 있다. 향후 연구에서는 다중 목표 최적화, 비선형 환경 함수, 그리고 진화 과정 중에 학습률·정규화 파라미터를 자동 조정하는 메타‑학습 기법을 결합하면 더욱 실용적인 진화형 딥러닝 프레임워크가 될 것으로 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기