픽셀부터 말까지 LSTM 기반 종단 시각 음성 인식

초록

본 논문은 입술 영상의 원시 픽셀과 차분 이미지 두 가지 입력 스트림을 이용해, 각각의 스트림에 LSTM을 적용하고 이를 양방향 LSTM(BLSTM)으로 융합하는 종단형 시각 음성 인식 모델을 제안한다. RBM 기반의 사전 학습을 통해 저차원 bottleneck 특징을 추출하고, 전체 네트워크를 end‑to‑end 방식으로 학습함으로써 OuluVS2와 CUAVE 데이터베이스에서 기존 방법 대비 9.7%·1.5%의 절대 정확도 향상을 달성하였다.

상세 분석

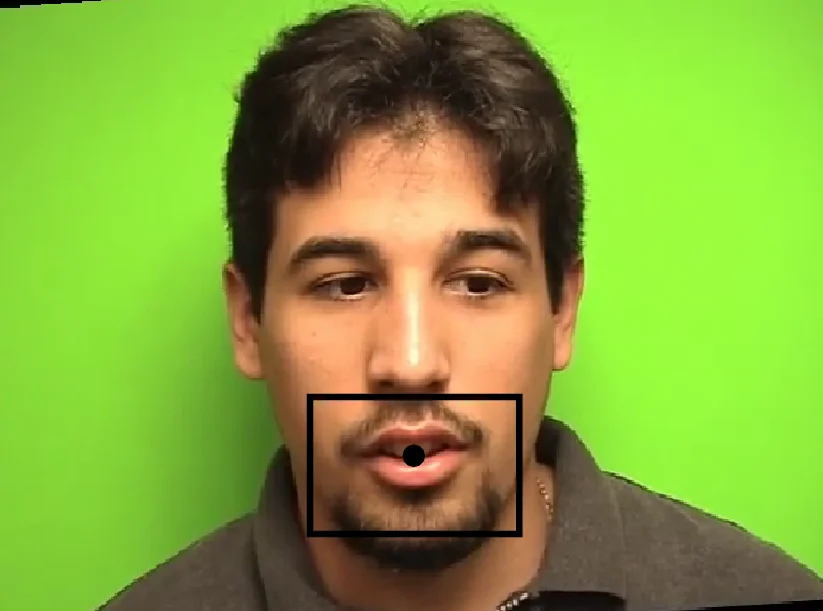

이 연구는 전통적인 시각 음성 인식 파이프라인(특징 추출 → 분류)을 하나의 신경망으로 통합한 최초의 시도 중 하나로 평가된다. 두 개의 독립 스트림은 각각 원시 입술 ROI와 연속 프레임 간 차분(diff) 이미지를 입력으로 사용한다. 차분 이미지는 순간적인 입술 움직임을 강조해 시간적 변화를 보다 직접적으로 포착한다는 점에서 의미가 있다. 각 스트림은 3개의 sigmoid 은닉층(2000, 1000, 500 유닛)과 선형 bottleneck 층으로 구성된 깊은 자동인코더 구조를 갖으며, 이는 제한 볼츠만 머신(RBM)으로 층별 사전 학습된다. 첫 번째 층은 Gaussian‑Bernoulli RBM을 사용해 실수형 픽셀 입력을 처리하고, 이후 두 층은 Bernoulli‑Bernoulli RBM, 마지막은 Bernoulli‑Gaussian RBM으로 전이한다. 이렇게 사전 학습된 인코더는 Δ와 ΔΔ(1차·2차 미분) 특징을 동시에 학습하도록 설계돼, 시간적 미분 정보를 bottleneck에 직접 결합한다.

인코더 위에 배치된 LSTM(256 유닛)은 각 스트림의 시퀀스 데이터를 시간적으로 모델링한다. 두 스트림의 LSTM 출력은 연결(concatenation)된 뒤, 양방향 LSTM(BLSTM, 256 유닛)으로 융합되어 최종 프레임‑레벨 라벨을 예측한다. 출력층은 소프트맥스이며, 전체 네트워크는 AdaDelta 옵티마이저와 미니배치(20 utterance)로 end‑to‑end 학습된다. 과적합 방지를 위해 5 epoch의 조기 종료와 LSTM에 대한 그래디언트 클리핑을 적용하였다.

실험은 OuluVS2(10문장, 52명)와 CUAVE(숫자 0‑9, 36명) 두 데이터셋에서 수행되었다. OuluVS2에서는 40명(900 utterance) 훈련·검증, 12명(360 utterance) 테스트, CUAVE는 18명 훈련·검증, 18명 테스트 프로토콜을 사용했다. 결과는 단일 스트림 모델만으로도 기존 DCT+HMM 기반 베이스라인(74.8%)을 상회했으며, 두 스트림을 결합한 모델은 84.5%의 정확도로 9.7%p의 절대 향상을 보였다. CUAVE에서도 원시 이미지 스트림만 71.4%, 차분 이미지 스트림만 65.9%를 기록했으며, 두 스트림 결합 시 78.6%에 도달해 기존 Deep Autoencoder+SVM(68.7%)·Deep Boltzmann+SVM(69.0%) 등을 크게 앞섰다. 혼동 행렬 분석에서는 “Hello‑Thank you”, “See you‑Have a good time” 등 의미적으로 유사한 구문 간 혼동이 주로 발생했으며, 숫자 데이터에서는 0‑2, 6‑9 쌍이 자주 혼동되었다.

흥미롭게도, 저자들은 CNN 기반 인코더와 데이터 증강을 시도했지만, 훈련 데이터가 제한적이어서 성능이 저하된다고 보고했다. 이는 작은 규모 데이터셋에서 전통적인 RBM‑ 기반 사전 학습이 여전히 유효함을 시사한다. 전체적으로 이 논문은 시각 음성 인식에서 특징 추출과 시계열 분류를 완전 통합함으로써, 복잡한 전처리 없이도 경쟁력 있는 성능을 달성할 수 있음을 입증한다.

댓글 및 학술 토론

Loading comments...

의견 남기기