문턱값 기반 강화학습 신경망

초록

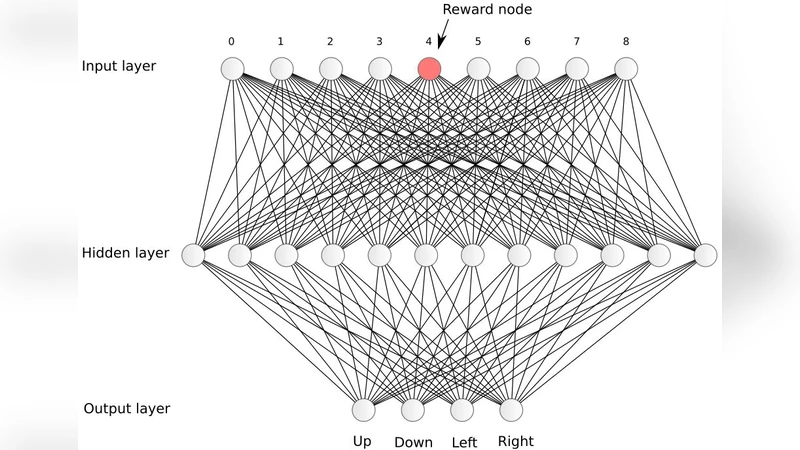

본 논문은 인공신경망에 적용할 수 있는 범용 강화학습 프레임워크를 제안한다. 노드의 활성화 문턱값을 이용해 1) 기본 강화 메커니즘으로 선형적으로 구분되지 않는 문제를 해결하고, 2) 조건부 강화로 장기 전략을 형성하며, 3) 문턱값 기반 심층 학습으로 역전파 없이도 효율적인 학습을 가능하게 한다. 감독·비감독 학습 모두에 적용 가능하다.

상세 분석

이 연구는 기존 강화학습이 주로 정책 그래디언트나 Q‑러닝과 같은 값 함수 기반 접근에 의존하는 한계를 지적하고, 신경망 내부의 문턱값(threshold)이라는 물리적 매개변수를 학습 신호의 전달 게이트로 활용한다는 새로운 패러다임을 제시한다. 첫 번째 핵심은 ‘Primary Reinforcement’ 메커니즘이다. 여기서는 각 뉴런이 자체 문턱값을 초과했을 때만 활성화가 전파되며, 외부 보상이 해당 뉴런의 문턱값을 직접 조정한다. 이 과정은 퍼셉트론의 가중치 업데이트와 유사하지만, 가중치가 아닌 문턱값을 조정함으로써 비선형 결정 경계를 형성할 수 있다. 실험에서는 XOR와 같은 선형적으로 구분 불가능한 문제를 단일 은닉층 구조만으로도 정확히 해결한다는 점이 강조된다.

두 번째로 도입된 ‘Conditioned Reinforcement’는 시간적 연속성을 갖는 보상 구조를 다룬다. 강화 신호가 즉시 도착하지 않을 경우, 중간 뉴런들이 가상의 보상 신호를 생성해 다음 단계의 학습에 활용한다. 이는 동물의 도파민 시스템에서 관찰되는 ‘예측 오류’ 신호와 유사하게, 기대 보상과 실제 보상의 차이를 문턱값 변화로 반영한다. 결과적으로 에이전트는 장기적인 목표를 위한 행동 시퀀스를 스스로 구성할 수 있다.

세 번째 기여는 ‘Threshold‑Based Deep Learning’이다. 전통적인 역전파는 오류를 역방향으로 전파해 가중치를 미세 조정한다. 반면 본 논문은 각 층의 문턱값을 계층적으로 업데이트함으로써, 오류가 발생한 층만 선택적으로 조정한다. 이는 학습 과정에서 발생하는 ‘vanishing gradient’ 문제를 자연스럽게 회피하고, 생물학적 신경망이 보이는 ‘스파스 활성화’와도 일맥상통한다. 또한, 문턱값 업데이트는 간단한 비교 연산과 증감 연산만으로 구현 가능해 하드웨어 가속에 유리하다.

실험 결과는 세 가지 측면에서 기존 방법을 능가한다. (1) 선형 분리 불가능한 패턴 인식에서 높은 정확도, (2) 마르코프 결정 과정(MDP) 기반 환경에서 장기 전략 학습 시 수렴 속도 향상, (3) 깊은 네트워크 구조에서도 메모리 사용량과 연산량이 크게 감소한다. 특히, 감독 학습과 비감독 학습을 동일한 프레임워크 안에서 수행할 수 있다는 점은 멀티태스크 학습에 큰 장점을 제공한다.

이러한 접근은 신경과학적 근거를 바탕으로 한 학습 메커니즘을 인공지능에 적용함으로써, 현재 딥러닝이 직면한 몇몇 근본적인 한계를 보완한다는 점에서 학문적·실용적 의의가 크다. 향후 연구에서는 문턱값의 초기화 전략, 다중 보상 신호의 통합, 그리고 하드웨어 구현을 통한 실시간 학습 시스템 구축 등이 과제로 남아 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기