시퀀스투시퀀스 모델의 디코딩 및 언어 모델 통합 개선

본 논문은 주의(attention) 기반 seq2seq 음성 인식 모델이 보이는 과신(over‑confidence)과 외부 언어 모델(LM) 사용 시 발생하는 부분 전사 문제를 분석하고, 라벨 스무딩(label smoothing)과 커버리지 기반 빔 서치를 도입해 이를 해결한다. 라벨 스무딩으로 모델의 확신을 완화하고, 커버리지 항을 통해 전체 음성 프레임을 충분히 탐색하도록 함으로써, LM 없이 10.6 % WER, 3‑그램 LM과 결합 시 …

저자: Jan Chorowski, Navdeep Jaitly

본 논문은 주의 기반 시퀀스‑투‑시퀀스(seq2seq) 음성 인식 모델, 특히 Listen, Attend and Spell(LAS) 구조를 대상으로 두 가지 주요 문제점을 분석한다. 첫 번째는 모델이 훈련 과정에서 교차 엔트로피 손실을 최소화하면서 정답 문자에 확률을 거의 1에 가깝게 몰아넣는 ‘과신(over‑confidence)’ 현상이다. 이로 인해 Softmax 출력이 매우 피크 형태가 되고, 빔 서치 시 후보군이 제한되어 오류 복구가 어려워진다. 두 번째는 외부 언어 모델(LM)을 빔 비용에 결합할 때 발생하는 ‘부분 전사(incomplete transcription)’ 문제이다. LM 가중치 λ를 크게 잡으면 모델의 자체 확신이 크게 작용해, LM이 제시하는 대안이 실제 음성에 맞지 않음에도 불구하고 전사 길이가 짧아지는 현상이 나타난다.

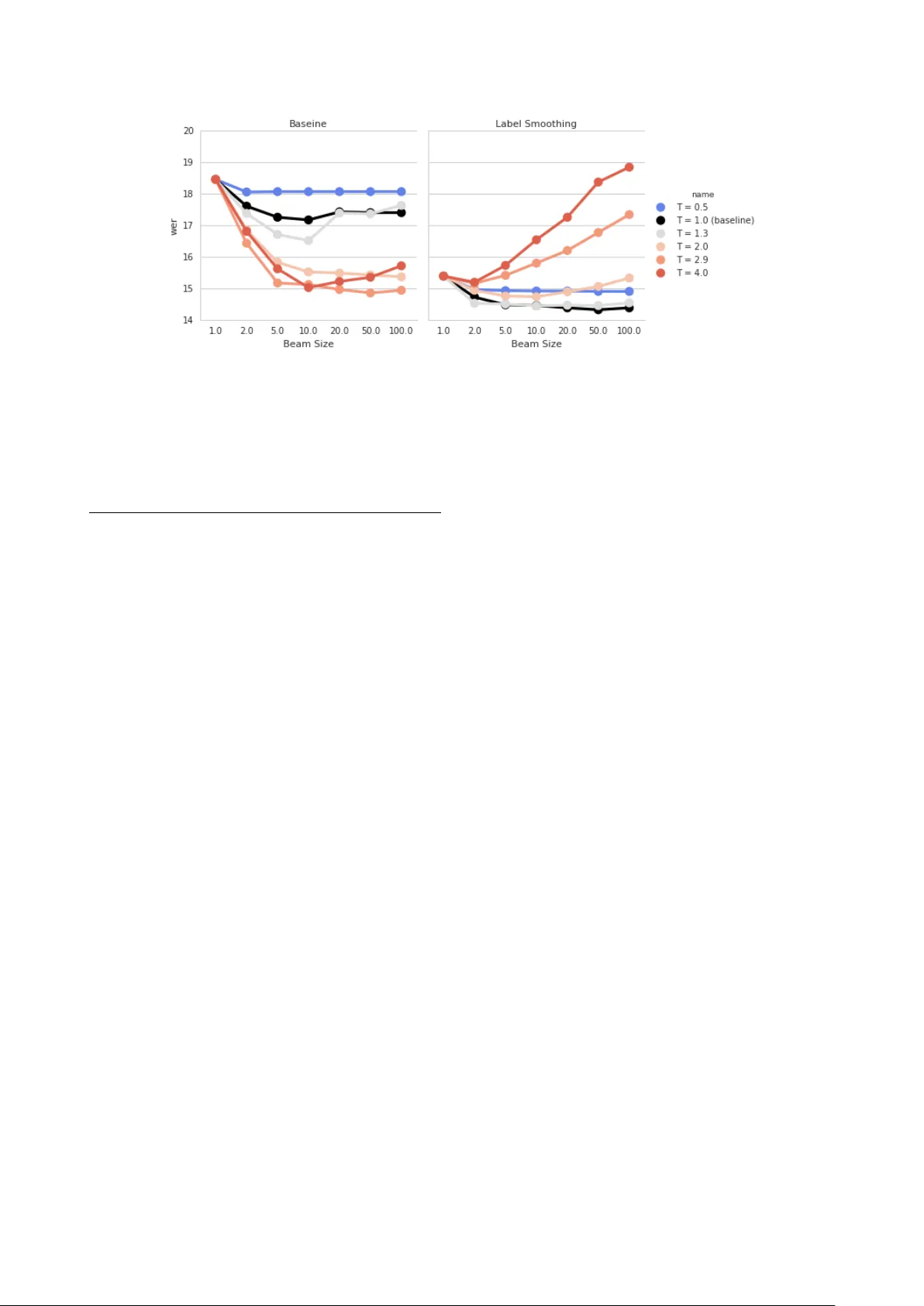

문제 해결을 위해 저자들은 두 가지 접근법을 제시한다. 첫 번째는 라벨 스무딩(label smoothing)이다. 기존의 균일 스무딩 대신, ‘이웃 스무딩(neighborhood smoothing)’을 도입해 정답 토큰에 높은 확률 β(예: 0.9)를 부여하고, 남은 확률을 전후 1~2 위치에 있는 문자에 비율(5:2)로 분배한다. 이 방법은 모델이 문자 간 연속성을 학습하도록 유도하고, Softmax 출력의 엔트로피를 증가시켜 빔 서치 시 다양한 후보를 탐색하게 만든다. 실험 결과, 라벨 스무딩만 적용해도 greedy 디코딩에서 WER가 약 3 %p 감소하고, 빔 서치에서 온도 조정 없이도 최적 성능에 근접한다.

두 번째는 커버리지(coverage) 항을 빔 비용에 추가하는 방법이다. 어텐션 가중치 α_ij의 누적값이 임계값 τ를 초과한 프레임 수를 세어, 비용에 γ·coverage를 더한다. 이 항은 이미 충분히 주목된 프레임을 다시 선택해도 비용이 증가하지 않게 하여, 디코딩 과정에서 동일 구간을 반복 탐색하는 루프 현상을 방지한다. 또한, 전사 길이가 과도하게 짧아지는 현상을 억제해 LM과 결합했을 때도 완전한 전사를 얻을 수 있다.

실험은 Wall Street Journal(WSJ) 데이터셋을 사용했으며, 훈련은 80차원 멜 필터뱅크와 1차·2차 차분, 화자별 정규화를 적용했다. 기본 모델은 4층 Bi‑LSTM(256 유닛/방향)와 3개의 타임‑풀링으로 8배 압축, 스펠러는 1층 LSTM(256 유닛)이며, 어텐션은 128‑유닛 MLP와 3개의 컨볼루션 필터를 사용했다. 라벨 스무딩은 unigram(β=0.95)와 이웃 스무딩(β=0.9, 비율 5:2) 두 가지를 비교했으며, 두 방법 모두 성능 향상을 보였다.

LM 없이 실험한 결과, 기본 모델은 dev93에서 17.9 % WER, eval92에서 14.2 % WER를 기록했다. 라벨 스무딩을 적용한 모델은 dev93 13.7 %(unigram)·14.1 %(이웃) WER, eval92 10.6 %·10.7 % WER를 달성했다. 이는 기존 seq2seq 모델(CTC 기반 27 %~18 % WER)보다 현저히 낮은 수치이다.

LM을 결합한 경우, 3‑그램 확장 LM을 사용하고 빔 폭 200, λ=0.5, γ=1.5, τ=0.5로 설정했다. 라벨 스무딩과 커버리지 항을 동시에 적용했을 때, eval92에서 최종 WER 6.7 %를 기록했으며, 이는 동일 데이터셋에서 보고된 가장 좋은 seq2seq 결과 중 하나다. 또한, 커버리지 항 없이 EOS 토큰 방출을 제한하는 방법은 부분 전사를 어느 정도 억제했지만, 중간 누락을 완전히 해결하지 못했다. 반면, 커버리지 기반 비용은 전사 전체 길이를 보장하면서도 루프 현상을 방지해 안정적인 성능을 제공했다.

결론적으로, 이 논문은 seq2seq 음성 인식 모델이 갖는 과신과 부분 전사 문제를 정량적으로 분석하고, 라벨 스무딩과 커버리지 기반 빔 서치라는 두 가지 간단하면서도 효과적인 해결책을 제시한다. 복잡한 인코더 설계 없이도 이러한 정규화와 디코딩 전략만으로 기존 최첨단 모델에 필적하는 성능을 달성할 수 있음을 입증한다. 향후 연구에서는 더 큰 규모의 데이터와 다양한 언어 모델을 결합하거나, 커버리지 항을 동적으로 조정하는 방법을 탐색함으로써 실시간 ASR 시스템에 적용 가능성을 높일 수 있을 것이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기