분산 딥러닝에서 모델 정확도와 실행 시간의 균형: Rudra 프레임워크 종합 분석

초록

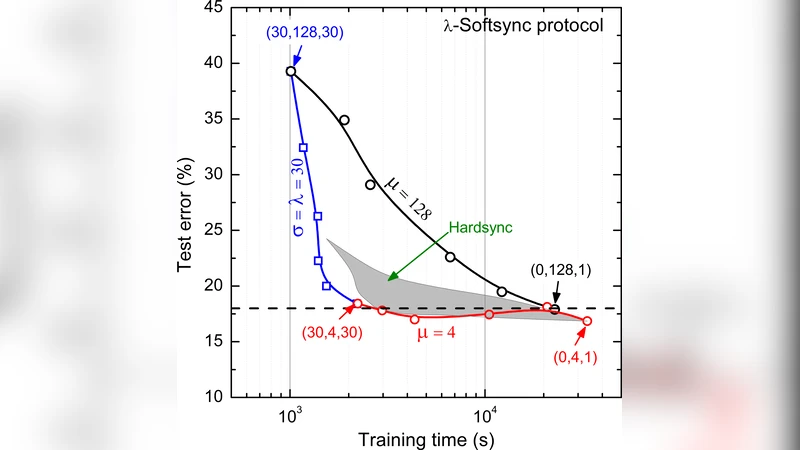

본 논문은 파라미터 서버 기반 분산 학습 시스템인 Rudra를 제안하고, 비동기 SGD의 다양한 동기화 방식·그래디언트 오래됨(staleness)·미니배치·학습률·학습자 수가 모델 정확도와 실행 시간에 미치는 영향을 체계적으로 실험한다. 새롭게 고안한 학습률 조절 전략과 n‑softsync 동기화 프로토콜을 통해 오래된 그래디언트의 부정적 영향을 완화하고, 학습자 수가 늘어날수록 미니배치를 축소해야 정확도를 유지할 수 있음을 발견한다. CIFAR‑10·ImageNet 실험을 통해 제안 기법의 유효성을 검증한다.

상세 분석

Rudra는 전통적인 파라미터 서버 구조에 하드싱크, 비동기, n‑softsync 세 가지 동기화 프로토콜을 구현한다. 하드싱크는 스텝마다 모든 학습자가 하나의 미니배치를 처리하고 평균 그래디언트를 적용하므로 스테일리시가 0이지만 통신 오버헤드가 크게 증가한다. 비동기 프로토콜은 학습자들이 자유롭게 pull‑push를 수행해 스테일리시가 수백까지 커질 수 있어 수렴 속도는 빠르지만 정확도가 저하될 위험이 있다. n‑softsync은 파라미터 서버가 일정 수(c = b·λ/n)의 그래디언트를 모은 뒤 업데이트함으로써 평균 스테일리시를 2·n 이하로 제한한다. 논문은 스테일리시가 클수록 학습률을 역비례적으로 감소시키는 “staleness‑aware learning rate”를 제안하고, 이를 n‑softsync에 적용했을 때 정확도가 크게 회복되는 것을 실증한다. 또한 학습자 수 λ가 증가하면 전체 배치 크기(λ·µ)가 고정된 상태에서 각 학습자의 미니배치 µ를 감소시켜야 모델의 일반화 성능이 유지된다는 중요한 관찰을 제시한다. 이는 데이터 병렬화가 무한히 확장되지 않으며, 일정 수준 이상의 병렬화는 오히려 학습 효율을 떨어뜨린다는 실용적인 한계를 제공한다. 시스템 구현 측면에서는 Rudra‑adv와 Rudra‑adv*를 도입해 파라미터 서버를 트리 구조로 계층화하고, 학습자 간에 가중치를 브로드캐스트함으로써 네트워크 대역폭 사용률을 99 %까지 끌어올렸다. 이러한 설계는 대규모 모델(300 MB)과 작은 µ에서도 통신 병목을 최소화한다. 실험 결과는 CIFAR‑10에서 µ = 4, λ = 60일 때 92 % 이상의 정확도를, ImageNet에서는 µ = 8, λ = 48일 때 Top‑1 71 % 수준을 달성하며, 기존 Downpour SGD 대비 2배 이상 빠른 학습 시간을 기록한다.

댓글 및 학술 토론

Loading comments...

의견 남기기