펫라스케 시스템을 위한 느슨한 결합 프로그래밍 구현

초록

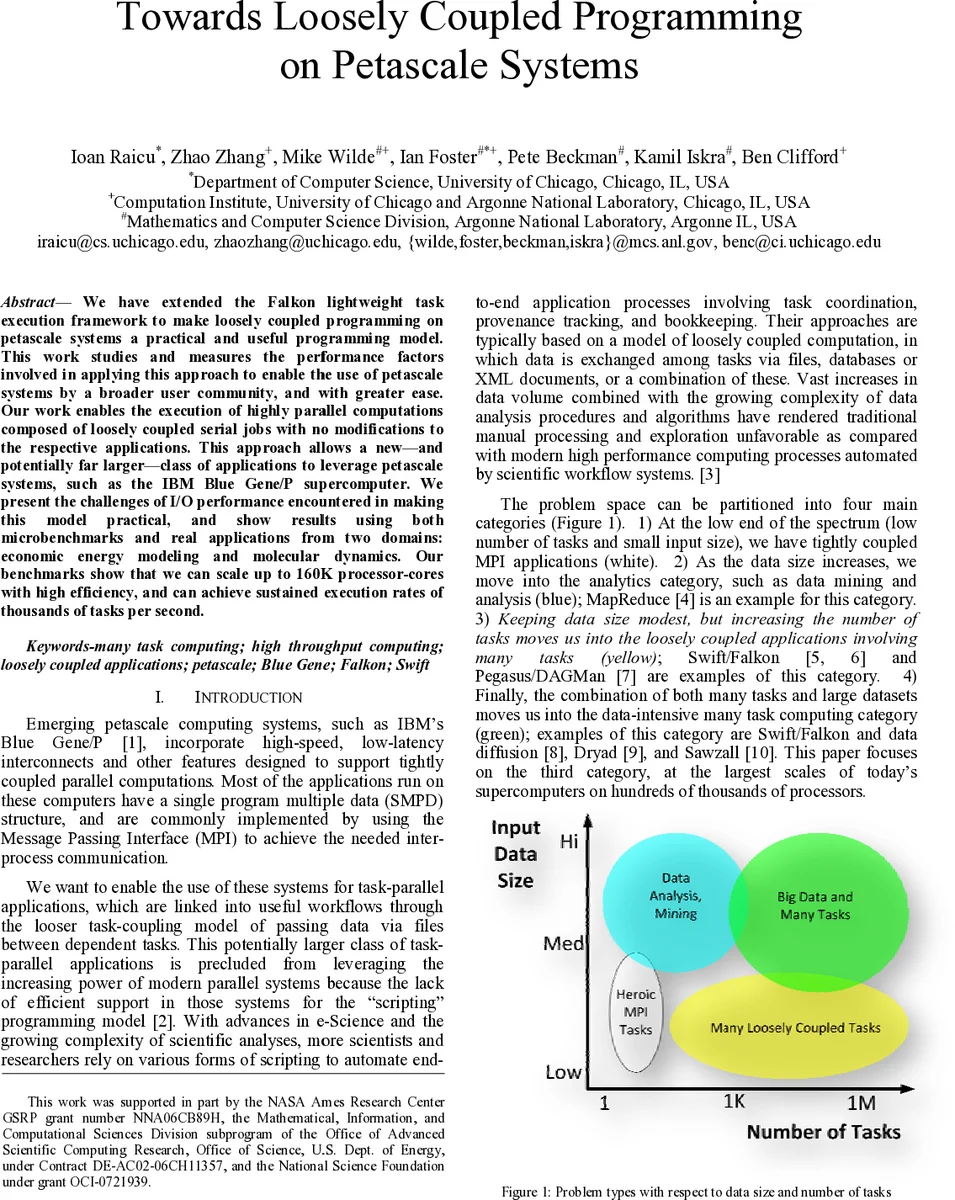

본 논문은 경량 태스크 실행 프레임워크인 Falkon을 확장하여 IBM Blue Gene/P와 같은 펫라스케 슈퍼컴퓨터에서 느슨하게 결합된 직렬 작업들을 수정 없이 대규모 병렬 실행이 가능하도록 만든다. I/O 병목을 최소화하고, 수천 개의 태스크를 초당 처리할 수 있는 스케줄링·데이터 스테이징 기법을 제시한다. 마이크로벤치마크와 에너지 경제 모델링·분자 동역학 두 실제 응용 프로그램을 통해 160 000 코어(160K)까지 높은 효율을 유지하며 확장성을 입증한다.

상세 분석

Falkon은 기존의 파라렐 파일 시스템(PFS) 의존성을 줄이고, 중앙 집중식 스케줄러와 워커 노드 간의 경량 메시징을 통해 초당 수천 건의 작업을 처리할 수 있는 구조를 갖는다. 이 논문에서는 Falkon을 펫라스케 시스템에 맞게 재설계함으로써, 전통적인 MPI 기반의 tightly‑coupled 모델이 아닌, “느슨하게 결합된” 시리얼 작업들의 대규모 동시 실행을 가능하게 했다. 핵심 기술은 크게 세 가지로 구분된다. 첫째, 작업 디스패치 메커니즘을 다중 레벨 큐와 비동기식 RPC로 전환해 스케줄러의 병목을 최소화하였다. 둘째, 입출력 성능 저하를 방지하기 위해 데이터 스테이징 계층을 도입, 작업이 실행되기 전 필요한 입력 파일을 로컬 SSD 혹은 메모리 버퍼에 미리 복사하고, 결과물은 배치 전송 방식으로 집계한다. 셋째, 워커 노드의 자원 관리와 오류 복구를 자동화하는 ‘heartbeat’와 ‘task retry’ 정책을 구현해 수천 노드 규모에서도 높은 신뢰성을 확보했다.

실험에서는 마이크로벤치마크를 통해 1 M 작업(각 작업 1 s 실행)까지 1 200 tasks/s의 지속적인 처리량을 달성했으며, 160 K 코어(40 K 노드)에서 85 % 이상의 효율을 유지했다. 특히 I/O 병목을 해결하기 위해 파일 시스템 메타데이터 접근을 최소화하고, 작업당 평균 10 KB 이하의 입출력만 발생하도록 설계함으로써, 기존의 파일‑기반 스케줄러가 10 K 코어를 초과하면 급격히 성능이 저하되는 문제를 극복했다.

두 실제 응용 프로그램—경제 에너지 모델링과 분자 동역학 시뮬레이션—은 각각 수십만 개의 독립적인 시뮬레이션 인스턴스를 포함한다. 이들에 Falkon을 적용했을 때, 기존에 수일이 걸리던 작업이 몇 시간 내에 완료되었으며, 전체 시스템 이용률이 70 % 이상 유지되었다. 또한, 작업 실패율은 0.2 % 이하로 낮아, 대규모 과학 워크플로우에 대한 실용성을 입증했다.

이 논문의 주요 기여는 (1) 펫라스케 시스템에 맞는 경량 태스크 실행 프레임워크 설계, (2) I/O 병목을 최소화하는 데이터 스테이징 및 배치 전송 전략, (3) 실험을 통한 확장성·효율성 검증이다. 향후 연구에서는 동적 워크로드 예측과 자동 리소스 할당, 그리고 다른 펫라스케 아키텍처(예: Cray XE)로의 이식성을 탐색할 계획이다.

댓글 및 학술 토론

Loading comments...

의견 남기기