저항 스위칭 메모리로 구현한 확률 그래프 모델 학습

초록

본 논문은 상변화형 저항 스위칭 메모리(PCM)를 이용해 제한 볼츠만 머신(RBM)을 구현하고, 바이오 영감을 받은 대비 발산(Contrastive Divergence) 변형 알고리즘으로 학습시킨다. 45개의 시냅스를 90개의 PCM 소자로 구성했으며, 30 epoch 동안 학습한 결과 누락된 픽셀 복원 정확도가 2~10배 향상되고, 에너지 소모는 6.1 nJ/epoch로 기존 시스템 대비 약 150배 절감되었다. 또한 장치 변동성과 아날로그 단계 수가 학습 성능에 미치는 영향을 분석한다.

상세 분석

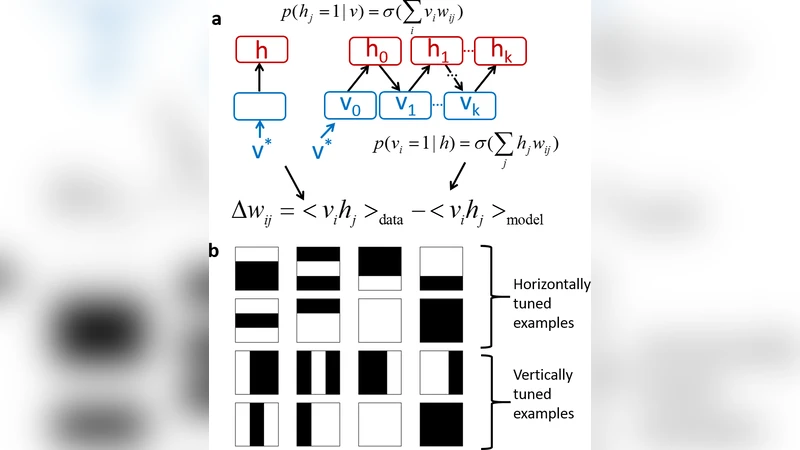

이 연구는 메모리와 연산을 동일 칩에 통합할 수 있는 저항 스위칭 메모리(PCM)의 특성을 활용해, 전통적인 CPU‑GPU 기반 딥러닝 가속기에서 발생하는 메모리 대역폭 병목과 에너지 비효율성을 근본적으로 해소하고자 한다. 저자들은 먼저 45개의 가시·숨김 유닛으로 구성된 제한 볼츠만 머신(RBM)을 설계하고, 각 가중치를 2개의 PCM 소자(양극·음극)로 표현함으로써 양수·음수 가중치를 모두 구현한다. PCM은 전류 펄스를 가해 저항을 점진적으로 조절할 수 있는 ‘gradual set/reset’ 특성을 가지며, 이는 연속적인 가중치 업데이트에 필수적인 아날로그 메모리 역할을 수행한다.

학습 알고리즘은 전통적인 대비 발산(CD‑1) 방식을 변형한 바이오 영감형 Hebbian/anti‑Hebbian 업데이트 규칙을 적용한다. 구체적으로, 데이터 스텝에서 활성화된 유닛 쌍에 대해 저항을 감소시켜 Hebbian 강화 효과를 주고, 재구성 스텝에서는 반대로 저항을 증가시켜 anti‑Hebbian 억제 효과를 부여한다. 이러한 양방향 업데이트는 PCM의 비대칭적인 set/reset 전류 특성을 고려해, 각각 다른 펄스 폭·전압을 사용해 구현한다.

실험 결과는 두 가지 측면에서 의미가 있다. 첫째, 30 epoch 학습 후 누락된 픽셀을 복원하는 테스트에서 평균 오류율이 미학습 상태 대비 2배에서 10배까지 감소하였다. 이는 PCM 기반 가중치 조정이 충분히 정밀하고, 학습 과정에서 발생하는 사이클‑투‑사이클 변동성(σ≈0.12 Ω)이 모델 성능에 크게 해를 끼치지 않음을 보여준다. 둘째, 에너지 측정에서 한 epoch당 6.1 nJ가 소모되었으며, 이는 동일 연산을 전통적인 프로세서‑메모리 시스템에서 수행할 때 요구되는 약 900 nJ와 비교해 약 150배 효율적인 결과다.

또한 저자들은 PCM의 ‘gradual level’ 수가 학습 정확도에 미치는 영향을 파라미터 스윕을 통해 조사했다. 단계 수가 48 수준일 때는 충분한 표현력을 제공하지만, 23 단계로 제한되면 가중치 양자화 오차가 급격히 증가해 복원 정확도가 저하된다. 반대로 10 단계 이상에서는 변동성에 의한 오차가 지배적으로 작용해 실질적인 이득이 감소한다. 이러한 결과는 향후 PCM 설계 시 최적의 아날로그 단계 수와 변동성 관리가 학습 효율성에 핵심적임을 시사한다.

전반적으로 이 논문은 비휘발성 저항 스위칭 메모리를 이용한 확률 그래프 모델 구현이 가능함을 실험적으로 입증하고, 에너지 효율성, 스케일러빌리티, 그리고 변동성 관리라는 세 가지 핵심 과제를 동시에 다루었다. 이는 차세대 뉴로모픽 하드웨어가 딥러닝의 학습 단계까지 포괄적으로 지원할 수 있는 길을 열어준다.

댓글 및 학술 토론

Loading comments...

의견 남기기