Intelligent Voice 2016 스피커 인식 시스템

본 논문은 NIST 2016 SRE에 제출된 Intelligent Voice(IV) 시스템을 소개한다. 제한된 학습 데이터와 메타데이터가 없는 새로운 언어에 강인하도록 설계되었으며, i‑vector/PLDA 기반의 프론트‑엔드와 백엔드 파이프라인을 상세히 기술한다. 주요 기법으로는 DNN‑HMM 기반 음성 활동 검출, MFCC·PLP 혼합 특징, NDA·LN‑LDA 차원 축소, 짧은 구간 변동 보정, 도메인 적응 PLDA, s‑norm 점수 정…

저자: Abbas Khosravani, Cornelius Glackin, Nazim Dugan

본 논문은 2016년 NIST Speaker Recognition Evaluation(SRE)에서 제시된 새로운 언어와 짧은 발화 길이 문제에 대응하기 위해 Intelligent Voice(IV) 팀이 개발한 스피커 인식 시스템을 상세히 기술한다. 시스템은 고정된 학습 조건(fixed training condition) 하에서만 사용할 수 있는 제한된 데이터(주로 LDC가 제공한 전화 회화 데이터와 Switchboard 코퍼스)를 활용했으며, 무라벨 개발 셋(필리핀어, 중국어, 타갈로그, 광동어 등)도 일부 학습 단계에 포함시켰다.

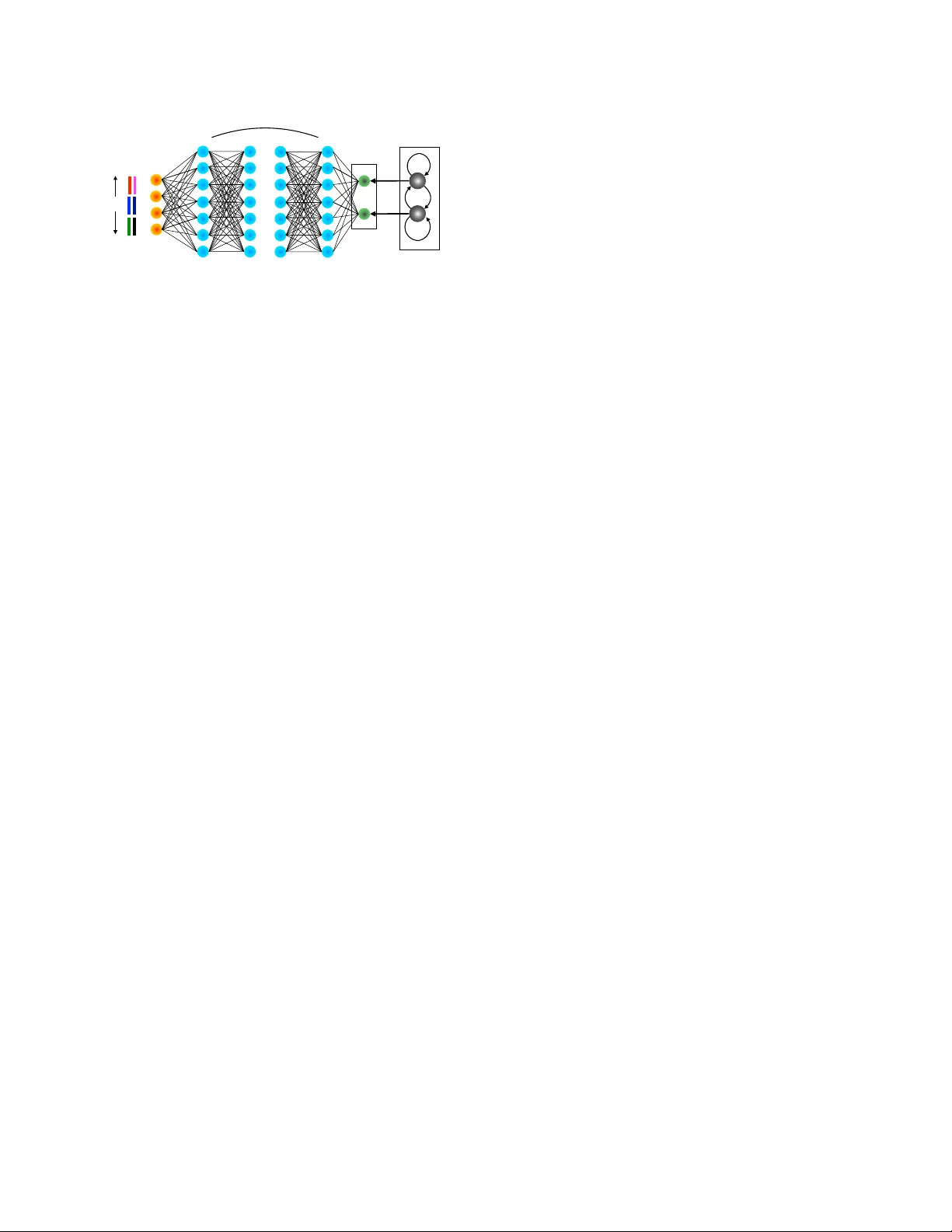

프론트‑엔드에서는 먼저 DNN‑HMM 기반 음성 활동 검출(SAD)을 수행한다. 입력은 40차원 필터뱅크에 양쪽 7프레임을 추가한 54차원이며, 6개의 은닉층(각 512 유닛)과 소프트맥스 출력으로 speech/non‑speech 확률을 산출한다. 100시간 규모의 Switchboard 데이터를 이용해 학습했으며, 검증 결과 5.9%의 프레임 오류율을 달성해 기존 에너지 기반 SAD(≈20%)보다 월등히 우수했다.

음향 특징은 두 가지를 병행한다. 첫 번째는 39차원 PLP, 두 번째는 60차원 MFCC(1차·2차 미분 포함)이며, 모두 8 kHz 샘플링, 25 ms(PLP)·20 ms(MFCC) 프레임, 10 ms 오버랩으로 추출한다. 각 발화는 3 초 윈도우 기반의 cepstral mean and variance normalization(CMVN)으로 정규화하고, 앞서 만든 DNN‑HMM SAD를 통해 비음성 프레임을 제거한다.

추출된 특징은 각각 2048‑가우시안 UBM과 600‑차원 i‑vector 추출기에 투입된다. 여기서 중요한 점은 Baum‑Welch 통계량에 0.33의 스케일 팩터를 적용해 통계량 간 상관성을 감소시킨다. 이렇게 얻은 MFCC‑i‑vector와 PLP‑i‑vector는 별도로 처리된다.

백엔드에서는 먼저 Nearest‑Neighbor Discriminant Analysis(NDA)를 적용한다. 10‑nearest neighbor 기반의 비모수적 within‑/between‑class scatter를 계산해 600→400 차원으로 압축한다. 이후 짧은 구간 변동 보정을 위해 무라벨 개발 셋에서 무작위 10 초 구간을 추출해 두 개의 i‑vector를 동일 클래스에 할당하고, 400×390 LDA와 WCCN을 적용해 길이 변동을 억제한다.

언어 정규화 단계에서는 Language‑Normalized LDA(LN‑LDA)를 도입한다. 언어별 within‑speaker scatter를 총 scatter에서 빼는 방식으로 언어 편향을 감소시키며, 390→300 차원 투영을 수행한다.

다음으로 PLDA 모델을 두 개 학습한다. 첫 번째는 외부(out‑domain) 데이터(표 1에 명시된 LDC·Switchboard)를 이용한 PLDA(V_out, Σ_out), 두 번째는 무라벨 개발 셋을 각 스피커가 하나라고 가정해 학습한 내부(in‑domain) PLDA(V_in, Σ_in)이다. 두 모델의 파라미터를 α=0.1 비율로 보간해 V_adapt와 Σ_adapt를 만든다.

점수 계산은 PLDA 로그우도비 공식에 따라 수행되며, 이후 symmetric s‑norm을 적용해 각 i‑vector를 무라벨 셋에 대한 impostor 점수로 정규화한다. 또한 테스트 구간 길이에 따른 C_min‑det 임계값 변동을 보정하기 위해 QMF(t)=‑0.2√t를 적용한다. 마지막으로 BOSARIS Toolkit을 이용해 로그우도비를 캘리브레이션하고, 목표 사전확률 P_tar=0.0001(주요 제출) 및 0.001(보조 제출)을 사용한다.

실험은 NIST SRE 2016 개발 셋을 대상으로 수행되었다. MFCC 단독 시스템은 EER 16.49%, C_min‑det 0.6633, C_det 0.6754를 기록했으며, PLP는 약간 낮은 성능을 보였다. 두 특징을 단순 합산(fusion)하면 EER 16.04%, C_min‑det 0.6012, C_det 0.6107으로 약 10%의 상대적 개선을 달성했다. 다양한 시나리오(A~E)를 통해 각 구성 요소의 영향을 분석했는데, NDA 대신 LDA를 사용하면 성능이 다소 저하되고, 짧은 구간 보정 기법을 제외하면 C_min‑det이 0.61→0.62 수준으로 감소한다. 언어 정규화를 제거하면 PLP 기반 성능이 크게 떨어지지만, MFCC와 fusion에서는 NDA가 더 유리하게 작용한다.

전체적으로 이 시스템은 제한된 학습 데이터와 다언어·짧은 구간 환경에서도 i‑vector/PLDA 기반 구조에 최신 딥러닝 SAD, 비선형 차원 축소, 도메인 적응, 점수 정규화, 품질 보정 등을 효과적으로 결합해 경쟁력 있는 성능을 보여준다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기