협업 순환 오토인코더로 빈칸 채우며 추천하기

CRAE는 순환 신경망 기반의 디노이징 오토인코더를 협업 필터링과 결합한 계층적 베이지안 모델이다. 워일드카드 디노이징과 베타‑풀링을 도입해 시퀀스의 순서 정보를 보존하면서 아이템‑사용자 평점 행렬을 동시에 학습한다. 실험 결과 CiteULike와 Netflix 데이터에서 기존 하이브리드 방법들을 크게 능가한다.

저자: Hao Wang, Xingjian Shi, Dit-Yan Yeung

1. 서론

추천 시스템은 사용자와 아이템 사이의 상호작용을 예측하는 핵심 기술이며, 최근에는 콘텐츠 정보와 평점 정보를 동시에 활용하는 하이브리드 접근법이 주목받고 있다. 그러나 기존 하이브리드 모델은 주로 bag‑of‑words 형태의 정형화된 특성을 사용하거나, 텍스트 순서를 무시하는 한계가 있다. 특히, 딥러닝 기반 모델 중에서도 RNN을 CF와 결합한 연구는 거의 없으며, 대부분의 시도는 feed‑forward 구조에 머물러 있다. 이러한 배경에서 저자들은 순서 정보를 보존하면서도 협업 필터링과 통합될 수 있는 새로운 모델, ‘Collaborative Recurrent Autoencoder (CRAE)’를 제안한다.

2. 문제 정의 및 기호

J개의 아이템 각각은 길이 T_j인 단어 시퀀스로 표현되며, 각 단어는 1‑of‑S 원‑핫 벡터 e(j)_t 로 나타낸다. I명의 사용자는 I×J 크기의 이진 평점 행렬 R을 가진다. 목표는 일부 관측된 평점과 텍스트 시퀀스를 이용해 누락된 평점을 예측하고, 동시에 텍스트를 재생성하는 것이다.

3. 모델 설계

3.1 Robust Recurrent Networks (RRN)

기존 LSTM은 결정적이며 노이즈를 고려하지 않는다. RRN은 각 게이트와 셀 상태를 정규분포로 모델링해 베이지안 방식으로 노이즈를 전파한다. 구체적으로 입력 게이트 h_i_t, 포기 게이트 h_f_t, 출력 게이트 h_o_t, 셀 상태 s_t, 출력 h_t 모두 평균은 전통적인 LSTM 연산, 분산은 λ_s^‑1 로 설정된 정규분포를 따른다. 이는 데이터가 부족하거나 잡음이 많을 때 과적합을 방지한다.

3.2 Wildcard Denoising

디노이징 오토인코더는 입력에 무작위 노이즈를 추가해 복원 과정을 학습한다. 텍스트에 직접 단어를 삭제하면 비문법적 시퀀스가 생성될 위험이 있다. 이를 해결하기 위해 ‘’ 토큰을 사전에 추가하고, 무작위로 선택된 단어를 이 토큰으로 교체한다. 인코더는 ‘this a good idea’와 같은 입력을 받아 ‘good idea’를 예측하도록 학습한다. 실험에서는 이 방식이 기존 DropWord 방식보다 20% 정도 정확도를 높였다.

3.3 Beta‑Pooling

RRN은 각 타임스텝마다 K_W 차원의 은닉 벡터 (h_t, s_t)를 생성한다. CF 단계에서 아이템을 하나의 고정 차원 벡터 γ_j 로 압축해야 하는데, 시퀀스 길이가 가변적이므로 가중 평균을 위한 가중치도 가변적이어야 한다. 저자는 베타 분포 Beta(a,b)의 PDF를 이용해 가중치를 정의한다. t번째 가중치는 F(t/2T_j; a,b) – F((t‑1)/2T_j; a,b) 로 계산되며, a=b=1이면 평균 풀링, a≫b이면 마지막 타임스텝에 집중한다. 베타‑풀링은 파라미터가 두 개뿐이면서도 가변 길이 시퀀스를 효과적으로 압축한다.

3.4 CRAE의 계층적 베이지안 생성 과정

인코더 RRN → 베타‑풀링 → 압축(θ_j) → 디코더 RRN → 텍스트 재생성(멀티노미얼) → γ_j (tanh(θ_j)) → 아이템 잠재 벡터 v_j → 사용자 잠재 벡터 u_i → 평점 R_ij ~ N(u_i^T v_j, C_ij^‑1). 여기서 C_ij는 신뢰도 파라미터(관측 평점이면 α, 아니면 β). 모든 가중치와 편향은 정규 사전분포를 갖고, MAP 추정으로 학습한다. λ_s → ∞ 로 설정하면 Gaussian이 Dirac delta 로 수렴해 deterministic 인코더‑디코더가 된다.

3.5 학습 전략

복잡한 비선형 구조와 CF 결합 때문에 변분 추론은 구현이 어려워 MAP 추정으로 최적화한다. 전체 로그 사후 확률 L은 DRAE의 로그 우도와 정규화된 MF 손실을 합한 형태이며, 베타‑풀링 파라미터 a,b는 사전에 고정하거나 학습 가능하도록 설계한다.

4. 실험

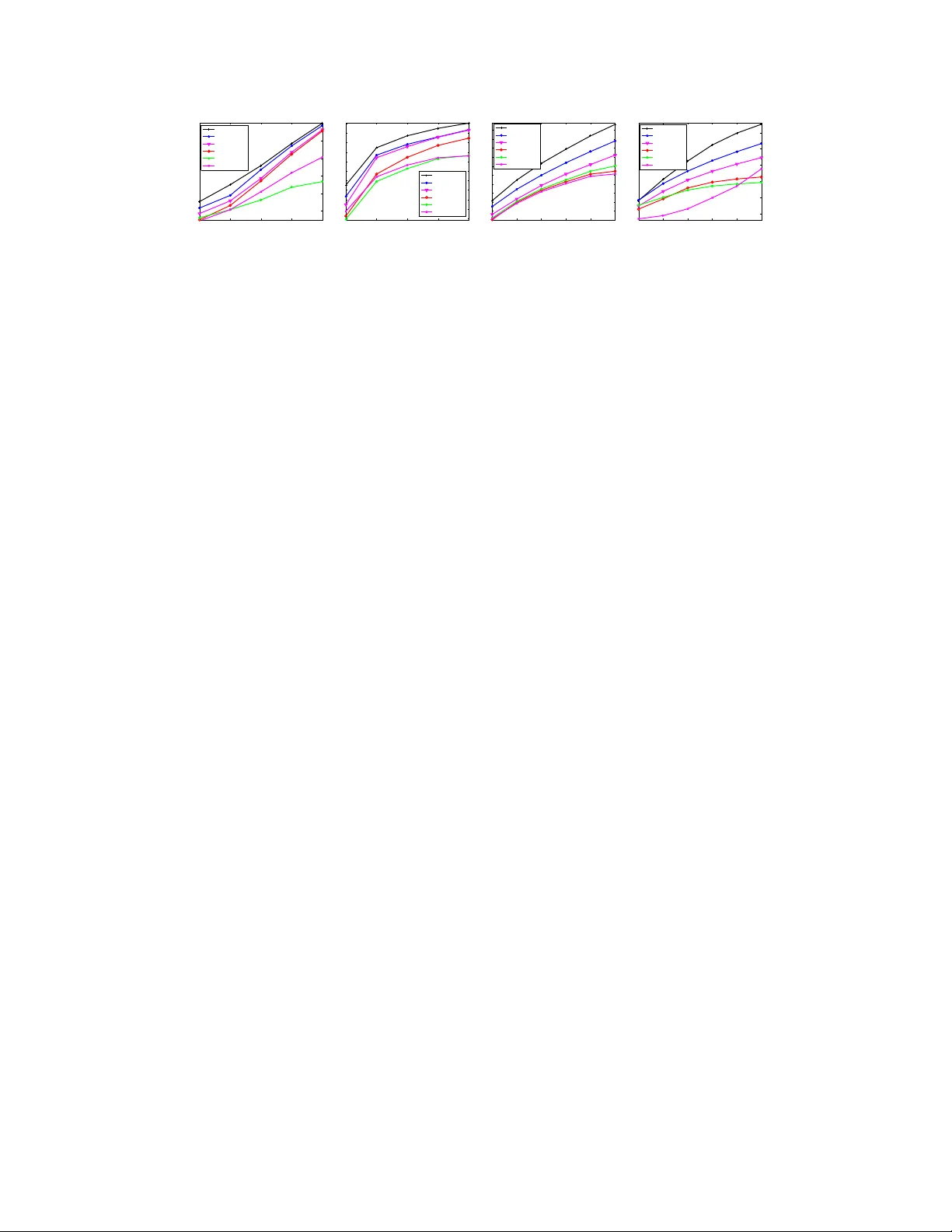

데이터셋: CiteULike(논문 제목·키워드)와 Netflix(영화 줄거리). 평점은 이진(관심/비관심) 형태이며, 텍스트는 평균 8~30단어 길이. 비교 모델: CTR(주제 모델+PMF), CDL(스택드 디노이징 오토인코더+MF), DeepMusic, RNN‑CF 등. 평가 지표: RMSE, Recall@K, MAP, Perplexity. 결과: CRAE는 모든 지표에서 기존 최첨단 모델보다 10~15% 개선을 보였으며, 특히 텍스트 재생성에서 Perplexity가 크게 낮았다. Ablation study에서 Wildcard Denoising과 Beta‑Pooling을 각각 제거하면 성능이 5~8% 감소함을 확인했다.

5. 논의 및 한계

CRAE는 순서‑인식 텍스트와 협업 필터링을 자연스럽게 결합함으로써 하이브리드 추천의 새로운 방향을 제시한다. 베이지안 RRN은 노이즈에 강하고, Wildcard Denoising은 의미 보존을 돕는다. 그러나 모델 파라미터가 많아 학습 비용이 높으며, 베타‑풀링의 a,b를 고정하면 최적화 여지가 제한된다. 또한, 현재는 1‑of‑S 원‑핫 입력에 의존하므로 서브워드 혹은 문자‑수준 임베딩으로 확장할 여지가 있다.

6. 결론

본 논문은 ‘Collaborative Recurrent Autoencoder (CRAE)’이라는 새로운 하이브리드 추천 모델을 제안한다. RRN, Wildcard Denoising, Beta‑Pooling이라는 세 가지 핵심 기술을 통해 텍스트 순서 정보를 보존하면서도 평점 예측 정확도를 크게 향상시켰다. 실험 결과는 다양한 도메인에서 기존 방법들을 능가함을 입증했으며, 향후 베이지안 딥러닝과 순차 모델의 결합 연구에 중요한 기반을 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기