전체 용량 유니터리 순환 신경망

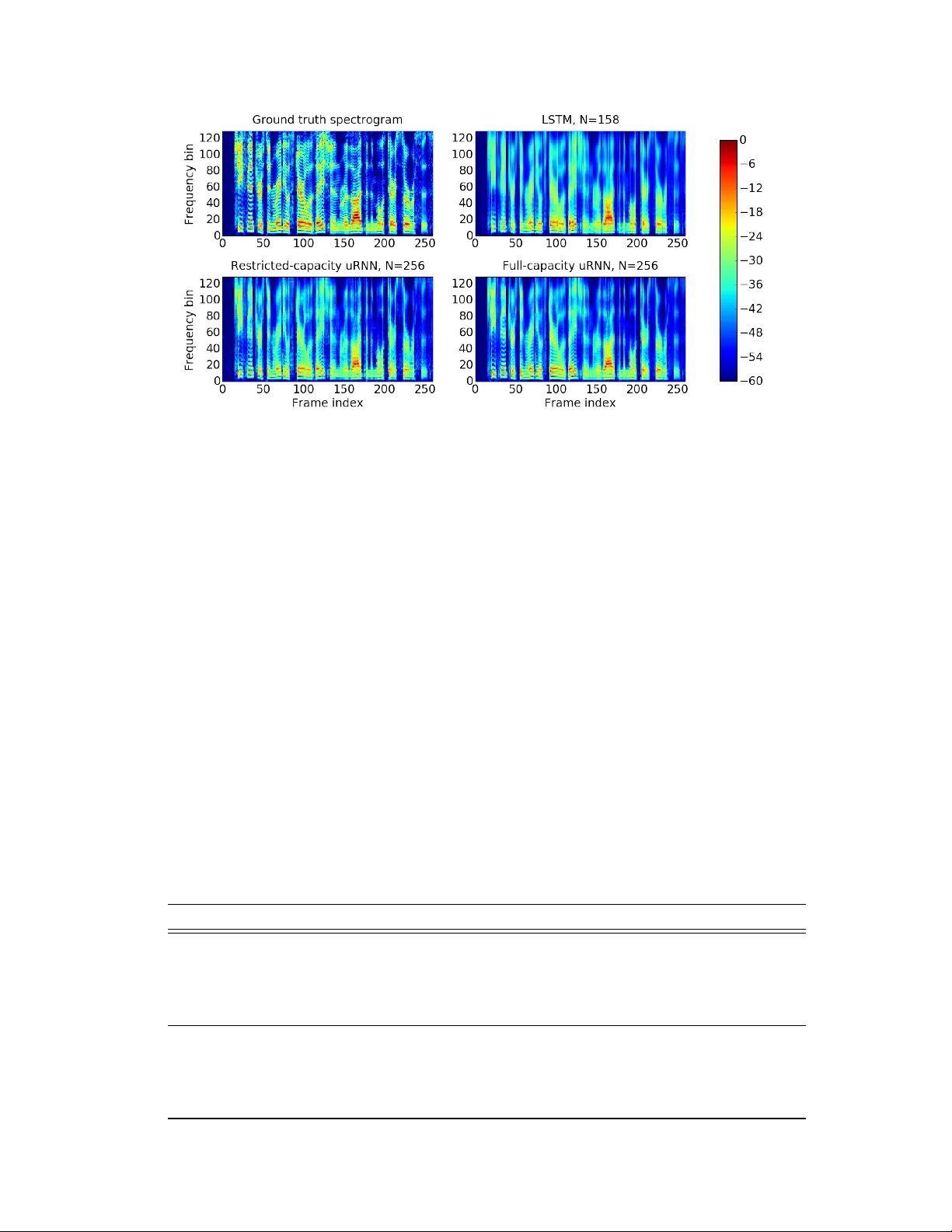

본 논문은 기존 uRNN이 사용한 제한된 파라미터화가 차원 N > 7에서 모든 유니터리 행렬을 표현하지 못함을 이론적으로 증명하고, 스테이플러 다양체 위에서 직접 최적화하는 전면적인(full‑capacity) 방법을 제안한다. 제안 기법은 기울기 클리핑이나 학습률 조정 없이도 안정적인 학습을 가능하게 하며, 합성 시스템 식별·기억 복사 문제와 실제 음성·이미지 데이터에서 LSTM 및 기존 제한‑capacity uRNN보다 우수한 성능을 보인다.

저자: Scott Wisdom, Thomas Powers, John R. Hershey

본 논문은 유니터리 순환 신경망(uRNN)의 표현 용량과 학습 방법에 관한 두 가지 주요 문제를 다룬다. 첫 번째 문제는 기존 uRNN이 사용한 제한된 파라미터화가 모든 유니터리 행렬을 표현할 수 없는지, 그리고 그 한계가 실제 학습 성능에 어떤 영향을 미치는가이다. 이를 위해 저자들은 유니터리 군 U(N) 이 N² 차원의 매니폴드임을 이용해, 파라미터 수 P 가 N²보다 작을 경우 매끄러운 매핑 g:ℝ^P→U(N) 이 전사적이지 않다는 사르드 정리(Sard’s theorem)를 적용한다. 구체적으로, Arjovsky 등

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기