확률 프로그램을 위한 딥 암오티제이션 추론

이 논문은 확률 프로그래밍 언어(PPL)에서 반복적인 추론 작업을 가속화하기 위해, 원본 프로그램과 동일한 제어 흐름을 유지하면서 신경망 기반 파라미터화된 가이드 프로그램을 학습하는 시스템을 제안한다. 가이드 프로그램은 사후분포를 근사하도록 최적화되며, mapData 구조를 통해 전역 파라미터와 로컬 데이터 포인트를 분리해 미니배치 학습과 모델 파라미터 학습을 동시에 지원한다. 구현은 WebPPL에 기반하고, 베이지안 네트워크, 토픽 모델, 딥…

저자: Daniel Ritchie, Paul Horsfall, Noah D. Goodman

본 논문은 확률 프로그래밍 언어(PPL)가 제공하는 강력한 모델링 능력에도 불구하고, 사후분포 추론이 본질적으로 계산적으로 비싸다는 문제를 해결하고자 한다. 저자들은 “암오티제이션(amortized inference)”이라는 아이디어를 차용해, 과거에 수행한 추론 결과를 활용해 새로운 관측에 대한 추론을 빠르게 수행하도록 설계된 가이드 프로그램(guide program) 시스템을 제안한다.

1. **배경 및 동기**

- PPL은 임의의 튜링 완전 언어 위에 샘플링·조건부 연산자를 추가해 확률 모델을 기술한다. 모델 p(x, y)에서 x는 잠재 변수, y는 관측 데이터이며, 사후 p(x|y)를 직접 계산하는 것은 일반적으로 불가능하다. 기존 PPL은 MCMC, SMC 등 샘플링 기반 근사 방법에 의존하지만, 매 추론마다 전체 적분을 새로 풀어야 하므로 비용이 크다.

- 많은 추론 문제는 구조적으로 유사성을 갖는다. 예를 들어, 동일한 전역 파라미터를 공유하는 여러 데이터 포인트에 대해 각각 로컬 사후를 구해야 하는 경우, 이전 추론 경험을 재활용하면 효율이 크게 향상될 수 있다. 이는 인간의 시각 인식이 과거 경험을 활용하는 방식과도 유사하다.

2. **가이드 프로그램 설계**

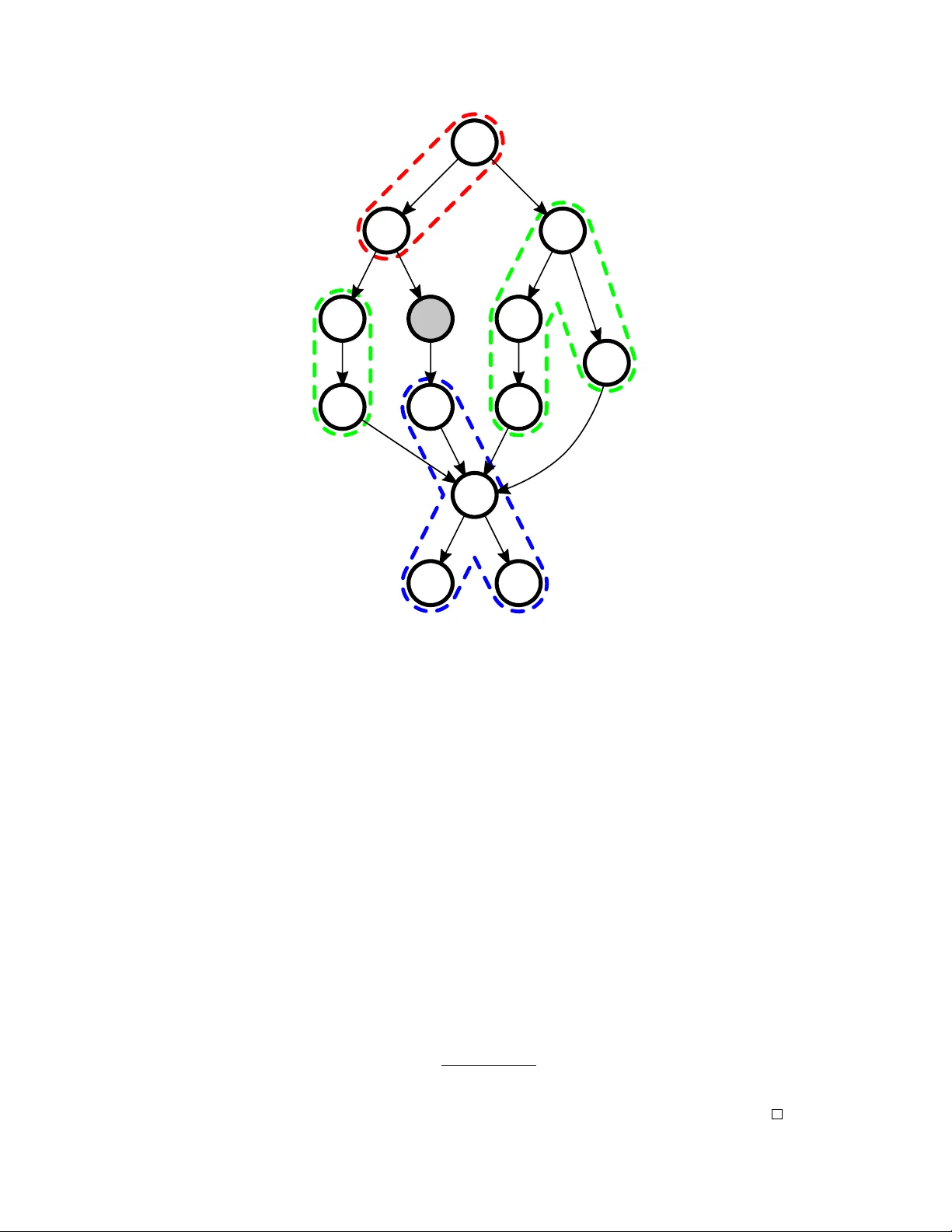

- 원본 프로그램 p와 동일한 제어 흐름(샘플링 순서와 조건문 등)을 유지하면서, 각 샘플링 지점에 대해 별도의 가이드 분포 q를 지정한다. 가이드 분포는 파라미터화될 수 있으며, 파라미터는 직접 선언하거나 신경망을 통해 동적으로 생성한다.

- 파라미터 선언은 `param({name:'θ', dims:

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기