비동기 증분 집계 그래디언트 알고리즘의 파라미터 서버 구현 및 선형 수렴 분석

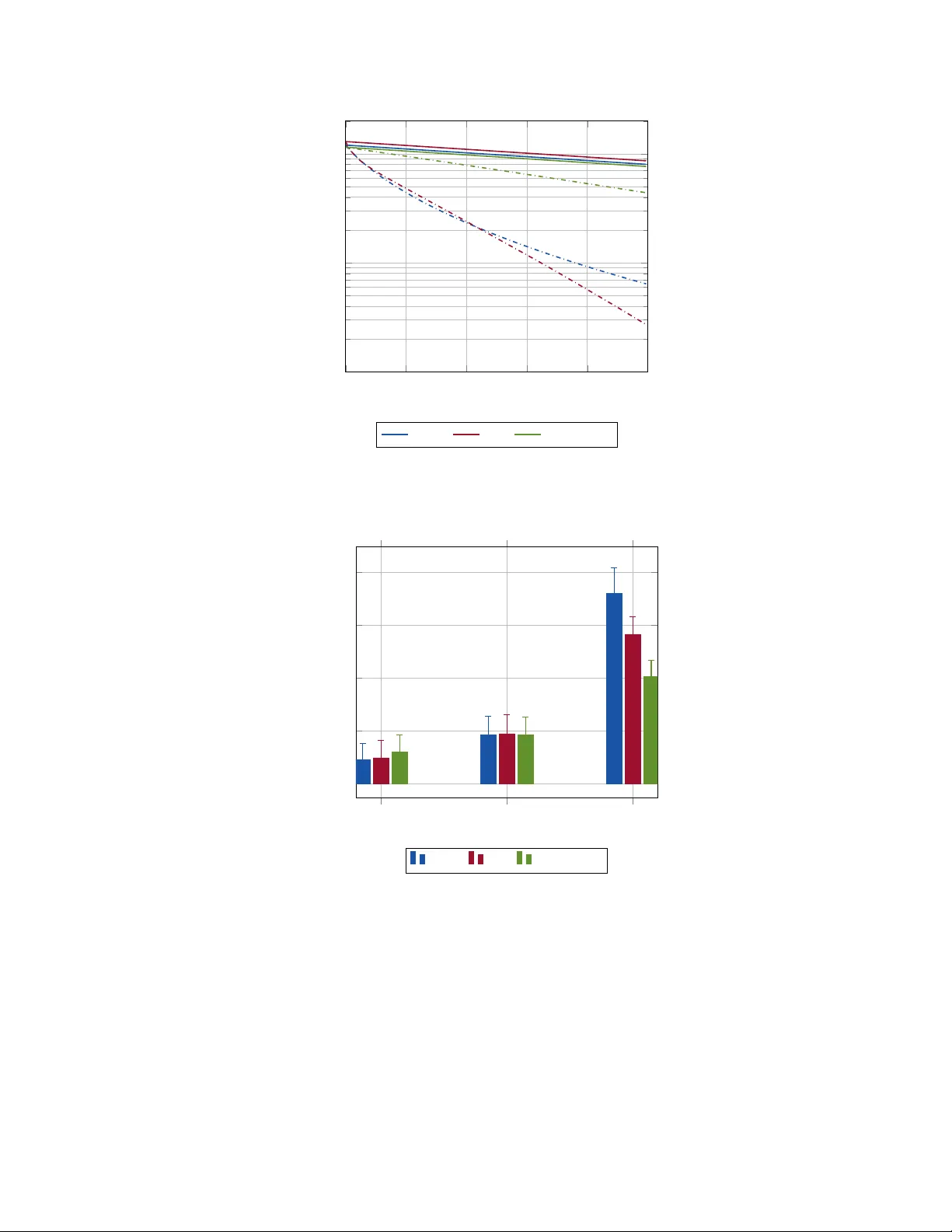

본 논문은 파라미터 서버 환경에서 일반적인 볼록 정규화항과 제약조건을 동시에 다룰 수 있는 비동기 증분 집계 그래디언트(Asynchronous Incremental Aggregated Gradient, AIAG) 알고리즘을 제안한다. 손실 함수가 강하게 볼록한 경우, 지연 정도(τ̄)에 의존하는 단계 크기 조건을 명시하고, 선형 수렴률을 증명한다. 또한 유클리드 거리 대신 일반적인 Bregman 거리로 확장한 결과와 실험을 통해 이론적 경계가 …

저자: Arda Aytekin, Hamid Reza Feyzmahdavian, Mikael Johansson

본 논문은 대규모 머신러닝 및 데이터 과학 작업에서 널리 사용되는 파라미터 서버(Parameter Server) 아키텍처를 대상으로, 비동기식으로 동작하면서도 일반적인 볼록 정규화항과 제약조건을 동시에 처리할 수 있는 증분 집계 그래디언트(Incremental Aggregated Gradient, IAG) 알고리즘을 확장한 비동기 증분 집계 그래디언트(AIAG) 방법을 제안한다.

1. **문제 정의 및 배경**

최적화 문제는 \( \min_{x\in\mathbb{R}^d}\; \sum_{n=1}^N f_n(x)+h(x) \) 형태로 설정된다. 여기서 \(f_n\) 은 각 데이터 샘플에 대응하는 손실 함수이며, \(h\) 는 ℓ₁ 정규화, 제약 집합 지시함수 등 비스무스(비연속) 정규화항을 포함한다. 기존 연구에서는 비동기 프로시저가 주로 부드러운 손실과 부드러운 정규화에 한정되었으며, 강볼록성 가정 하에서도 단계 크기 감소 없이 수렴을 보장하기 어려웠다.

2. **알고리즘 설계**

- **워커 측**: 각 워커 \(w\)는 현재 파라미터 \(x_k\)를 받아 자신의 데이터 서브셋 \(N_w\)에 대해 \( \nabla f_n(x_k) \) 를 계산하고, 지연 \( \tau_w^k\) 후에 마스터에게 전송한다.

- **마스터 측**: 마스터는 모든 워커로부터 도착한 최신(또는 지연된) 그래디언트를 집계하여 \( g_k = \sum_{n=1}^N \nabla f_n(x_{k-\tau_n^k}) \) 를 만든다. 이후 \( x_{k+1}= \operatorname{prox}_{\alpha h}(x_k-\alpha g_k) \) 를 수행하고, 새로운 파라미터를 워커에게 브로드캐스트한다.

알고리즘은 기존 IAG와 달리 \(h\) 에 대한 proximal 연산을 포함함으로써 비스무스 정규화와 제약을 자연스럽게 처리한다.

3. **이론적 분석**

- **가정**: (A1) 전체 손실 \(F(x)=\sum_n f_n(x)\) 가 \( \mu\)-강볼록, (A2) 각 \(f_n\) 가 \(L_n\)-Lipschitz 연속 미분, (A3) \(h\) 가 전역 서브그라디언트를 갖는 볼록 함수, (A4) 지연 \( \tau_n^k\) 가 상수 \( \bar\tau\) 이하.

- **주요 정리**: Lemma 1을 이용해 \(V_k=\|x_k-x^\star\|^2\) 와 \(w_k=\|x_{k+1}-x_k\|^2\) 사이의 재귀 부등식을 도출하고, 단계 크기 \( \alpha\) 가

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기