딥러닝 표현력의 비밀: 텐서 분석을 통한 깊이와 효율성

이 논문은 합성 데이터(이미지·텍스트 등)에 적합한 가설 공간이 깊은 계층 구조를 갖는 네트워크에서 더 효율적으로 표현될 수 있음을, 컨볼루션 연산의 핵심인 지역성·가중치 공유·풀링을 포함한 **컨볼루션 산술 회로** 모델을 제시하고, 이를 **계층적 텐서 분해(Hierarchical Tucker)**와 동등시켜 이론적으로 증명한다. 깊은 네트워크는 다항 크기로 구현 가능하지만, 같은 함수를 얕은 네트워크(CP 분해)로 구현하려면 지수적 규모가…

저자: Nadav Cohen, Or Sharir, Amnon Shashua

**1. 연구 배경 및 동기**

딥러닝에서 ‘깊이(depth)’가 표현력을 크게 향상시킨다는 경험적 증거는 풍부하지만, 이를 뒷받침하는 이론은 주로 비현실적인 모델(완전 연결 신경망, Boolean 회로 등)에 국한돼 있었다. 특히, 현재 가장 성공적인 구조인 **컨볼루션 신경망(ConvNet)** 은 **지역성(locality)**, **가중치 공유(weight sharing)**, **풀링(pooling)** 라는 세 가지 핵심 설계 원칙을 갖고 있는데, 기존 이론은 이들을 전혀 고려하지 않았다. 따라서 이 논문은 이러한 실제 ConvNet 특성을 반영한 새로운 이론적 프레임워크를 구축한다.

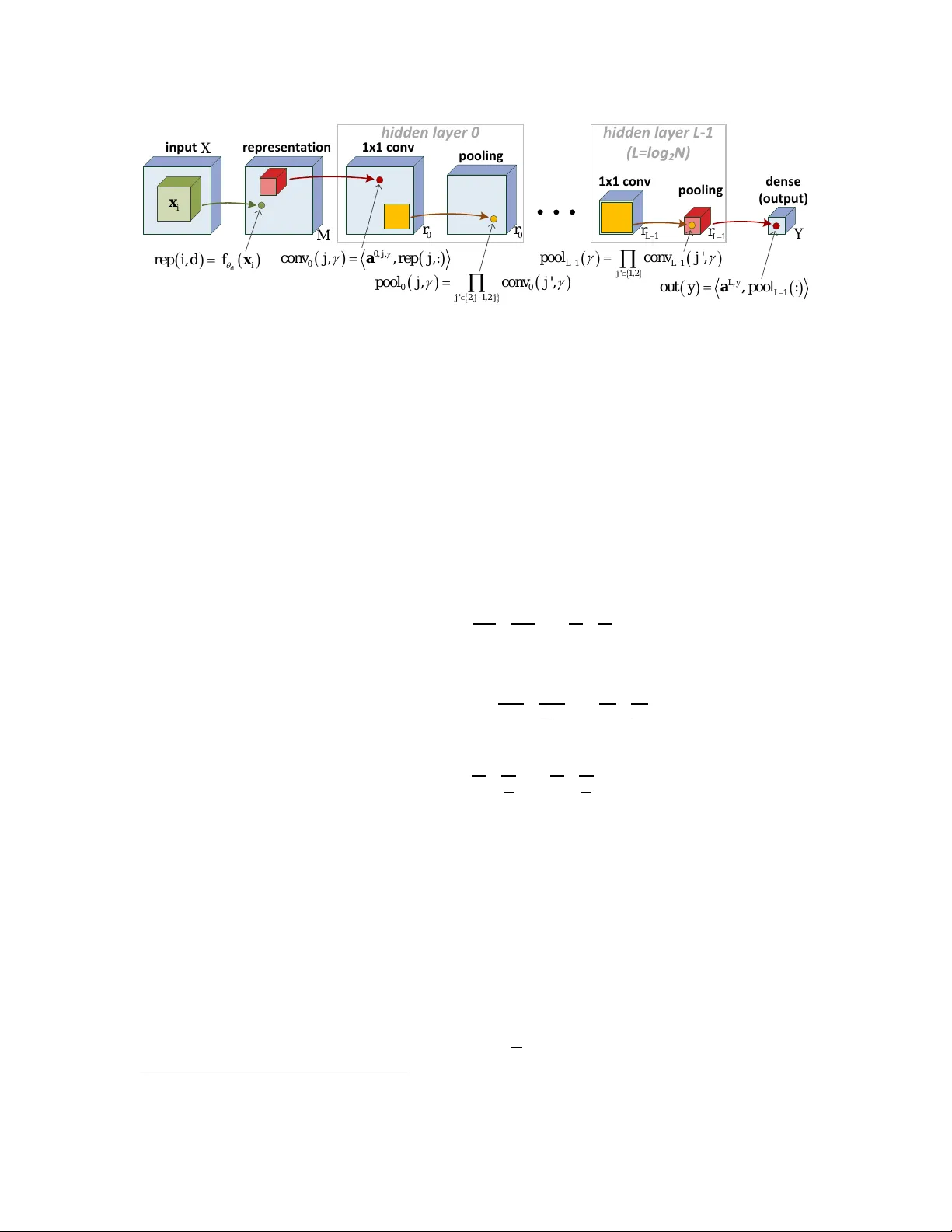

**2. 컨볼루션 산술 회로(Convolutional Arithmetic Circuit) 설계**

- **노드 종류**: sum node(가중합)와 product node(곱) 두 종류만 사용.

- **지역성·공유 구현**: sum node는 동일한 가중치를 여러 위치에 적용해 1×1 컨볼루션 형태를 만든다(지역성+공유).

- **풀링 구현**: product node는 인접 영역의 출력을 곱해 풀링을 수행한다(곱 풀링).

- **표현 함수**: 입력 \(\mathbf{x}_i\in\mathbb{R}^s\)에 대해 \(M\)개의 파라미터화된 함수 \(f_{\theta_d}(\mathbf{x}_i)\)를 계산하고, 이를 텐서 곱 형태 \(\bigotimes_{i=1}^N f_{\theta_{d_i}}(\mathbf{x}_i)\) 로 결합한다.

**3. 텐서 관점에서의 모델 해석**

스코어 함수는

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기