클라우드 환경에서 하둡을 활용한 빅데이터 분석 프레임워크

초록

본 논문은 빅데이터의 4V(Volume, Value, Variety, Velocity)를 기준으로 데이터를 분류하고, 각 특성에 맞는 하둡 기반 처리 노드에 라우팅한 뒤, 최종적으로 결과를 통합하는 클라우드 기반 분석 시스템을 제안한다. 데이터 파티셔닝과 병렬 처리를 위해 하둡을 활용했으며, 노드별 처리 흐름과 결합 메커니즘을 설명한다.

상세 분석

이 논문은 빅데이터 관리의 난점을 ‘4V’ 특성에 따라 데이터 흐름을 설계함으로써 해결하고자 한다는 점에서 흥미로운 접근을 시도한다. 먼저, Volume(데이터 규모)에 대해서는 하둡 HDFS를 이용한 분산 저장과 MapReduce 기반의 대용량 처리 파이프라인을 구축한다는 점이 전형적인 빅데이터 처리 패턴과 일치한다. Velocity(데이터 속도)와 관련해서는 실시간 혹은 근실시간 스트리밍 데이터를 별도의 노드에서 처리한다는 언급이 있지만, 구체적인 스트리밍 프레임워크(예: Apache Storm, Spark Streaming)와의 연동 방법이 제시되지 않아 구현 가능성이 모호하다. Variety(다양성)는 구조화된 로그, 반구조화된 JSON, 비정형 텍스트 등 서로 다른 포맷을 하나의 파이프라인에 통합하려는 시도로 보이지만, 데이터 스키마 정규화 혹은 변환 로직에 대한 상세 설명이 부족하다. Value(가치) 측면에서는 데이터 분석 결과를 비즈니스 인사이트로 전환하는 단계가 ‘노드별 처리 후 결과 결합’이라는 형태로 단순화되어 있다. 여기서는 결과 결합 시 데이터 정합성, 중복 제거, 가중치 부여 등의 정책이 명시되지 않아 실제 가치 창출에 한계가 있을 것으로 판단된다.

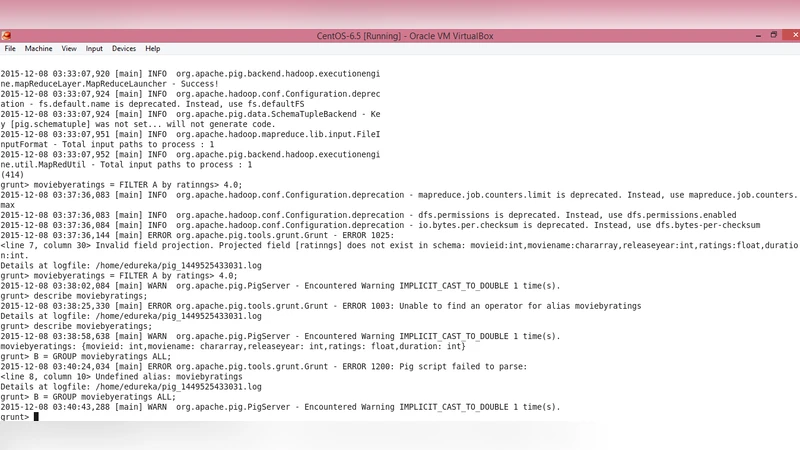

시스템 아키텍처는 “입력 데이터를 분류 → 해당 특성 노드에 라우팅 → 각 노드에서 하둡 기반 처리 → 최종 결과 통합”이라는 흐름으로 제시된다. 이 구조는 모듈화와 확장성을 제공하지만, 노드 간 데이터 이동 비용, 네트워크 대역폭, 작업 스케줄링 정책 등에 대한 정량적 평가가 결여되어 있다. 또한, 하둡 자체가 배치 처리에 최적화돼 있기 때문에 Velocity와 같은 고속 데이터 처리 요구를 만족시키려면 별도의 인메모리 컴퓨팅 레이어가 필요함에도 불구하고 논문에서는 이를 무시하고 있다.

실험 부분에서는 ‘데이터를 4개의 노드에 분산시켜 처리 후 결합한다’는 간단한 시나리오만 제시되며, 처리 시간, 스루풋, 비용 효율성 등에 대한 비교 분석이 부족하다. 따라서 제안된 프레임워크가 기존 하둡 기반 솔루션 대비 실제 성능 향상을 입증하기 어렵다.

전반적으로 논문은 빅데이터 4V를 기준으로 노드 분류를 시도했지만, 각 특성에 맞는 구체적인 기술 스택, 알고리즘, 성능 평가가 미비하다. 향후 연구에서는 스트리밍 처리와 배치 처리를 혼합한 하이브리드 아키텍처, 데이터 정제 및 스키마 관리 전략, 그리고 정량적 벤치마크를 포함시켜 실용성을 강화할 필요가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기