Tsallis 엔트로피 기반 의사결정트리 분할 기준 통합

본 논문은 의사결정트리의 대표적인 분할 기준인 Shannon 엔트로피(ID3), Gain Ratio(C4.5), Gini 지수(CART)를 하나의 파라미터화된 프레임워크인 Tsallis 엔트로피로 통합한다. q 파라미터를 조정함으로써 기존 기준을 특수 경우로 복원하고, 데이터셋별 최적 q 값을 교차 검증으로 찾으면 정확도와 트리 복잡도 측면에서 기존 방법들을 통계적으로 우수하게 만든다.

저자: Yisen Wang, Chaobing Song, Shu-Tao Xia

본 논문은 의사결정트리(Decision Tree) 학습에서 사용되는 대표적인 분할 기준인 Shannon 엔트로피(ID3), Gain Ratio(C4.5), Gini 지수(CART)를 하나의 파라미터화된 정보 이론인 Tsallis 엔트로피로 통합하는 새로운 프레임워크를 제안한다. 먼저, Tsallis 엔트로피 S_q(X)=\frac{1}{1-q}\left(\sum_i p_i^q-1\right)의 정의와 q에 따른 특성을 소개한다. q → 1일 때는 Shannon 엔트로피 H(X)와 동일하고, q = 2일 때는 Gini 지수 G(X)=1-\sum_i p_i^2와 정확히 일치한다는 수학적 관계를 증명한다. 또한, C4.5에서 사용되는 Gain Ratio는 Shannon 엔트로피 기반 정보 이득을 분할 정보로 정규화한 형태이므로, Tsallis 엔트로피를 H에 대입하면 q = 1인 경우에 Gain Ratio를 그대로 복원한다. 따라서 q 하나만 조정하면 세 가지 기존 기준을 모두 포괄할 수 있다.

제안된 Tsallis Entropy Criterion(TEC) 알고리즘은 기존 트리 성장 절차와 동일하게 작동한다. 각 노드에서 모든 속성‑컷포인트 쌍을 평가하고, 불순도 감소량 I(C_j)=T(D)-\frac{|D_0|}{|D|}T(D_0)-\frac{|D_{00}|}{|D|}T(D_{00})를 최대화하는 쌍을 선택한다. 여기서 T(D)는 Tsallis 엔트로피 혹은 정규화된 Tsallis 엔트로피(Tsallis Gain Ratio)로 정의된다. 알고리즘은 파라미터 q를 사전에 교차 검증(10‑fold CV)으로 최적화하고, 최소 리프 크기 5를 설정해 과적합을 방지한다. 트리 구축 후에는 후처리(pruning)를 수행하지 않으며, 테스트 단계에서는 다수결 투표 방식으로 클래스를 예측한다.

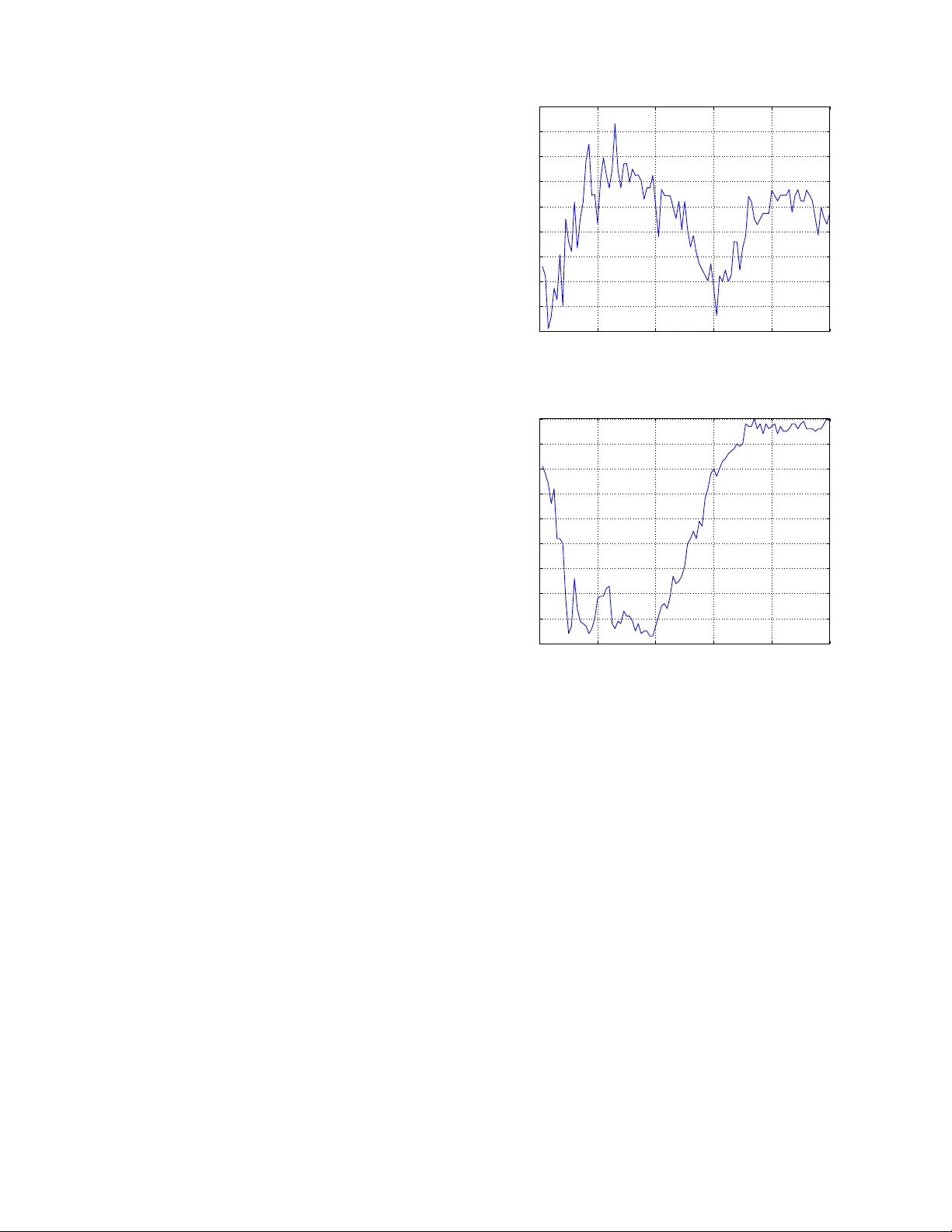

실험은 UCI 레포지터리의 11개 데이터셋(숫자형, 범주형, 혼합형, 이진 및 다중 클래스)을 대상으로 수행되었다. 각 데이터셋을 70% 훈련, 30% 테스트로 랜덤 분할하고, 훈련 데이터 내에서 그리드 서치를 통해 최적 q 값을 찾았다. 평가 지표는 정확도와 트리 노드 수(복잡도)이며, 실험을 10번 반복해 평균값을 보고한다. 결과는 다음과 같다. 대부분의 데이터셋에서 q ≈ 2가 최고 정확도를 제공했으며, q = 3 근처에서는 트리 복잡도가 최소화되는 경향을 보였다. TEC(특히 Tsallis Entropy 기반) 모델은 ID3, CART, C4.5에 비해 평균 정확도가 1~3%p 상승했고, 복잡도 면에서도 동등하거나 더 작은 트리를 생성했다. Tsallis Gain Ratio 버전은 정확도는 약간 낮지만 트리 깊이와 노드 수가 더 작아 모델 해석성이 향상되는 특성을 보였다. Wilcoxon 부호 순위 검정으로 TEC와 기존 기준 간 차이가 통계적으로 유의함(p < 0.05)임을 확인하였다.

논문의 주요 기여는 세 가지로 요약된다. 첫째, Tsallis 엔트로피를 이용해 Shannon 엔트로피, Gini 지수, Gain Ratio를 하나의 수식적 프레임워크로 통합함으로써 이론적 일관성을 제공한다. 둘째, q 파라미터를 데이터에 맞게 튜닝함으로써 ‘적응형’ 분할 기준을 구현하고, 이는 데이터의 분포 특성(클래스 불균형, 다중 모드 등)에 따라 성능을 최적화한다. 셋째, 광범위한 실험을 통해 TEC가 정확도와 모델 복잡도 모두에서 기존 방법을 능가한다는 실증적 증거를 제시한다. 향후 연구 방향으로는 q 값을 자동으로 추정하는 베이지안 최적화, 연속형 특성에 대한 최적 구간 탐색, 그리고 랜덤 포레스트·Gradient Boosting 등 앙상블 기법과의 결합을 통한 성능 향상이 제시될 수 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기