신경망‑n그램 하이브리드 언어모델 NN‑grams

NN‑grams는 단어 히스토리와 n‑gram 카운트를 동시에 입력으로 받아, n‑gram의 기억력과 신경망의 일반화 능력을 결합한 하이브리드 언어모델이다. 출력 소프트맥스 없이 Noise Contrastive Estimation(NCE)으로 학습하며, 260억 단어 규모 데이터에서 6‑gram 대비 음성 인식 오류율을 감소시킨다.

저자: Babak Damav, i, Shankar Kumar

본 논문은 음성 인식 시스템에서 널리 사용되는 n‑gram 언어모델과 최근 각광받는 신경망 기반 언어모델의 장점을 결합한 새로운 하이브리드 모델, NN‑grams를 제안한다. 전통적인 n‑gram 모델은 대규모 코퍼스에 대해 빠른 추론과 메모리 효율성을 제공하지만, 희소한 n‑gram에 대한 스무딩 한계와 장거리 컨텍스트를 반영하기 어렵다. 반면, 피드포워드·RNN·LSTM 등 신경망 기반 모델은 분산 표현을 통해 희소성을 완화하고 장거리 의존성을 학습할 수 있으나, 어휘가 수백만 단어에 달할 경우 출력 소프트맥스 연산이 계산·메모리 비용을 크게 증가시켜 실시간 음성 인식에 적용하기 어렵다.

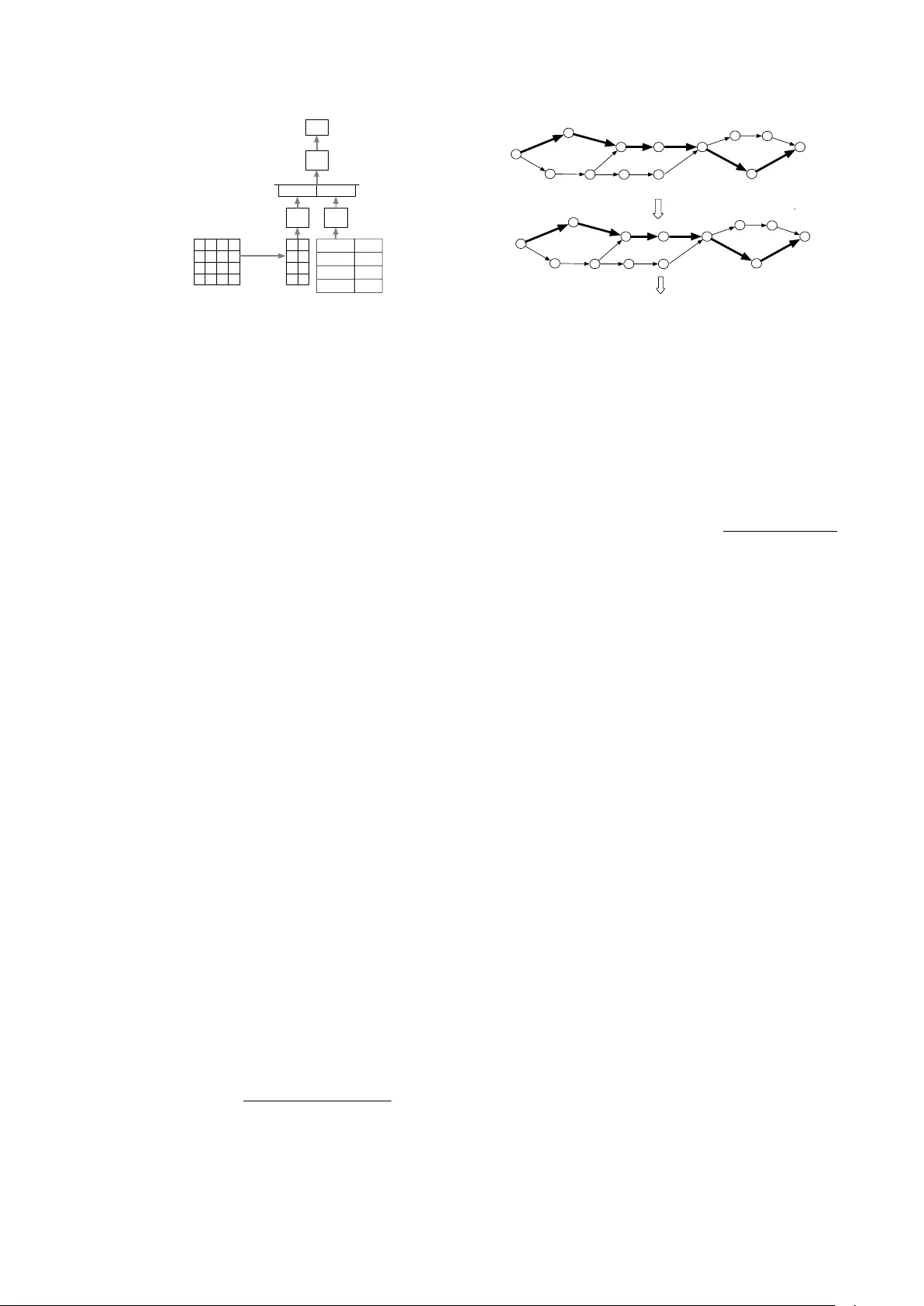

NN‑grams는 이러한 딜레마를 해소하고자, 현재 단어와 K개의 이전 단어를 원‑핫 인코딩 형태로 입력하고, 동시에 N‑gram( N≤K ) 카운트 벡터를 제공한다. 입력된 원‑핫은 임베딩 레이어를 거쳐 256 차원의 밀집 벡터로 변환되고, 카운트는 로그 스케일링 후 별도의 ReLU 레이어를 통과한다. 두 흐름은 concat된 뒤 최종 ReLU 레이어를 거쳐 Noise Contrastive Estimation(NCE) 레이어에 전달된다. NCE는 모델이 데이터 샘플과 잡음 샘플을 구분하도록 학습시키는 방법으로, 출력에 소프트맥스를 두지 않아도 정규화되지 않은 로그 확률을 추정할 수 있다.

잡음 분포는 두 가지를 실험하였다. 첫 번째는 현재 히스토리 기반 n‑gram 확률에서 샘플링하는 텍스트 잡음이며, 두 번째는 음성 인식 라티스에서 1‑best 경로와 정렬된 대안들을 추출해 얻는 스피치 잡음이다. 스피치 잡음은 라티스 핀칭(lattice pinching) 과정을 통해 얻으며, 실제 음성 오류 패턴을 반영한다. 각 단어마다 f개의 잡음 샘플을 생성하고, 본 연구에서는 f를 1, 5, 10, 100으로 변형해 성능을 평가하였다.

학습은 260억 단어 규모의 이탈리아어 코퍼스를 사용했으며, AdaGrad 옵티마이저(learning rate 0.01)와 배치 200으로 수렴할 때까지 진행하였다. 모델 파라미터는 약 517 M으로, 동일 코퍼스로 훈련된 6‑gram LM(9.6 B 파라미터)보다 훨씬 적다. 그러나 런타임에 6‑gram 카운트를 조회해야 하는 비용이 추가된다.

실험은 두 가지 태스크, 음성 검색(VS)과 받아쓰기(DTN)에서 수행되었다. 기본 5‑gram LM은 VS에서 17.9 % WER, DTN에서 11.8 % WER를 기록했다. 6‑gram LM과 NN‑grams를 각각 0.5 가중치로 5‑gram과 보간했을 때, 6‑gram LM은 VS 14.9 % / DTN 8.8 %를 달성했고, NN‑grams는 VS 14.8 % / DTN 8.2 %로 비슷하거나 약간 우수한 결과를 보였다. 특히 DTN에서 NN‑grams가 0.6 %p 개선된 점은 장거리 문맥을 활용한 일반화 능력이 반영된 것으로 해석된다.

구성 요소 별 ablation 실험에서는 (1) 단어 임베딩만 사용, (2) n‑gram 카운트만 사용, (3) 두 가지 모두 사용한 경우를 비교했다. 결과는 n‑gram 카운트가 임베딩보다 큰 영향을 미치며, 특히 짧은 문장(평균 3.7~6.5단어)에서는 카운트만으로도 충분히 성능을 끌어올린다. DTN처럼 문장이 길어질수록 임베딩이 추가적인 이득을 제공한다.

잡음 샘플 수에 대한 실험에서는 1개에서 100개까지 늘릴수록 WER이 감소했으며, 100개일 때 최적 성능을 기록했다. 텍스트 잡음은 DTN에서 약간 더 좋은 결과를 보였고, VS에서는 두 잡음이 동등한 성능을 보였다. 이는 텍스트 잡음이 장거리 언어적 의존성을 더 잘 반영하고, 스피치 잡음은 발음 혼동에 초점을 맞추기 때문으로 추정된다.

마지막으로, 학습된 단어 임베딩을 시각화한 결과 “Roma”와 “telefono”와 같은 단어가 의미적으로 유사한 이탈리아어 단어와 가까운 거리를 갖는 것을 확인했다. 이는 NN‑grams가 n‑gram 카운트와 별도로 의미적 정보를 학습함을 의미한다.

결론적으로, NN‑grams는 소프트맥스 연산을 회피하면서도 대규모 n‑gram 카운트를 활용해 실시간 음성 인식에 적합한 효율적인 하이브리드 언어모델을 제공한다. 향후 연구에서는 카운트 조회 비용 최소화, 잡음 분포 자동 최적화, 그리고 정규화된 확률 출력 방법을 탐색함으로써 더욱 넓은 적용 범위를 기대한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기