딥러닝 기반 이미지 분할과 완전 연결 CRF의 결합

초록

본 논문은 VGG‑16 기반의 딥 컨볼루션 신경망을 8배 밀도로 출력하도록 ‘아트라스(구멍) 알고리즘’으로 변형하고, 최종 레이어의 클래스 점수를 완전 연결 조건부 랜덤 필드(CRF)와 결합해 픽셀 수준의 정확한 경계 복원을 실현한다. 이 시스템(DeepLab)은 PASCAL VOC‑2012에서 71.6% IoU를 달성하며, 8 fps의 실시간 추론 속도와 구현의 단순성을 동시에 제공한다.

상세 분석

이 논문은 딥 컨볼루션 신경망(DCNN)이 고수준 시각 과제에서는 뛰어난 불변성(invariance)을 제공하지만, 픽셀 단위의 정밀한 위치 정보를 요구하는 의미론적 이미지 분할에서는 공간 해상도가 크게 감소한다는 근본적인 한계를 짚는다. 저자들은 두 가지 주요 문제, 즉 (1) 풀링과 스트라이드에 의한 신호 다운샘플링, (2) 네트워크의 큰 수용 영역(receptive field)으로 인한 위치 민감도 저하를 해결하기 위해 ‘아트라스(atrous) 알고리즘’을 도입한다. 이 기법은 필터에 구멍을 삽입해 효과적인 스트라이드 확대 없이도 높은 해상도의 특성 맵을 생성하도록 하며, VGG‑16의 마지막 두 풀링 레이어를 건너뛰고 필터 크기를 2×·4× 확대함으로써 출력 스트라이드를 8픽셀로 맞춘다. 결과적으로 네트워크는 원본 이미지와 거의 동일한 해상도로 클래스 점수를 제공한다.

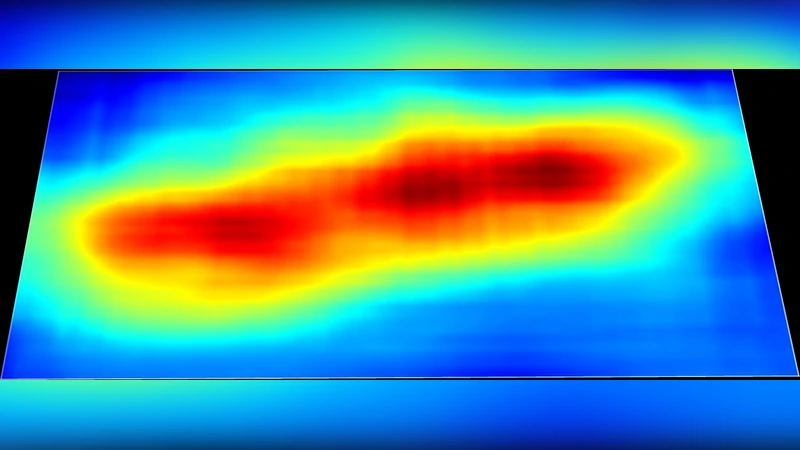

다음 단계에서는 완전 연결 CRF를 사용해 DCNN의 ‘유니어리’ 점수를 정교하게 다듬는다. Krähnbühl & Koltun(2011)의 고속 평균장(mean‑field) 근사 알고리즘을 채택해, 모든 픽셀을 노드로 하는 완전 연결 그래프에서 장거리 상호작용을 효율적으로 계산한다. 이 CRF는 색상·위치·그라디언트 기반의 유사도 커널을 이용해 픽셀 간 유사성을 모델링하고, DCNN이 제공하는 부드러운 점수 맵을 경계에 민감한 고해상도 라벨 맵으로 변환한다. 평균장 반복 횟수는 10회 정도가 충분하며, 전체 추론 시간은 0.5 초 이하로 유지된다.

학습 단계에서는 ImageNet으로 사전 학습된 VGG‑16을 21클래스(PASCAL VOC)용으로 미세조정한다. 손실 함수는 각 공간 위치에 대한 교차 엔트로피의 합이며, 모든 픽셀에 동일 가중치를 부여한다. 학습은 표준 SGD로 진행되며, 전체 파인튜닝 시간은 약 10시간으로 기존 방법보다 크게 단축된다.

성능 평가에서는 PASCAL VOC‑2012 테스트 셋에서 71.6% IoU를 기록, 기존 최고 기록(약 64%)보다 7% 이상 향상시킨다. 특히 경계 정확도에서 눈에 띄는 개선을 보이며, 시각적으로도 객체 경계가 매우 정밀하게 복원된다. 속도 측면에서는 306×306 입력에 대해 8 fps의 실시간 처리 속도를 달성, GPU 기반 실용 시스템으로서 충분히 활용 가능하다.

이 논문은 (i) ‘아트라스’ 기반의 고해상도 DCNN, (ii) 완전 연결 CRF의 효율적 평균장 추론, (iii) 두 모듈을 순차적으로 결합한 단순한 파이프라인이라는 세 가지 핵심 기여를 통해, 복잡한 다단계 파이프라인 없이도 고성능 의미론적 분할을 구현한다는 점에서 의미가 크다. 또한 이후 연구에서 CRF를 신경망 내부에 포함시켜 end‑to‑end 학습을 시도한 후속 작업(예: Zheng et al., 2015)에도 중요한 기반을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기