데이터 독립적 훈련 오류 보장, 모든 미분 가능한 지역 최소점은 전역 최소점

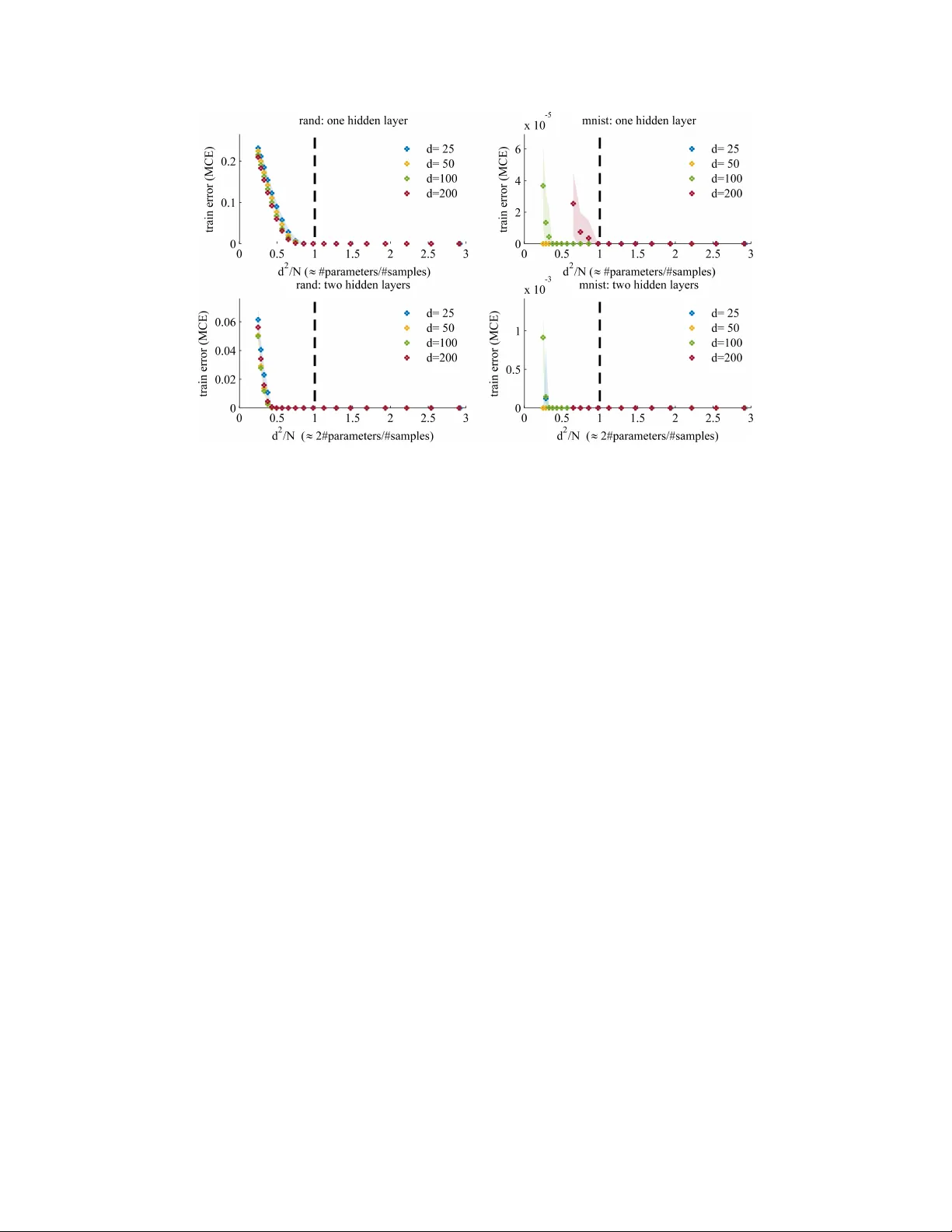

본 논문은 과잉 매개변수화된 단일 출력 다층 신경망(MLP)에서, 입력 데이터와 드롭아웃 잡음이 거의 모든 경우에 대해, 미분 가능한 지역 최소점(DLM)에서 훈련 오차가 반드시 0이 됨을 증명한다. 1‑숨김층 네트워크에서는 첫 번째 층의 파라미터 수가 샘플 수 N보다 크면( N ≤ d₀d₁) 모든 DLM이 전역 최소점이며, 다층 네트워크에서는 마지막 두 층만을 학습 대상으로 할 때 N ≤ d_{L‑2}d_{L‑1}이면 동일한 결과가 성립한다.…

저자: Daniel Soudry, Yair Carmon

본 논문은 다층 신경망(MNN)의 훈련 손실이 비볼록함에도 불구하고, 실제로는 지역 최소점이 거의 전역 최소점과 구분되지 않는 현상을 이론적으로 설명한다. 연구는 두 가지 주요 가정을 둔다. 첫째, 활성화 함수가 구간별 선형인 leaky ReLU와 같은 함수이며, 각 뉴런의 기울기를 나타내는 행렬 E^{(l)} 를 도입해 드롭아웃 잡음과 동일시한다. 둘째, 네트워크가 과잉 매개변수화(over‑parameterized)되어, 특정 층의 파라미터 수가 훈련 샘플 수 N보다 충분히 크다(N ≤ d_{l‑1}d_l).

**1. 모델 및 손실 정의**

입력 X∈ℝ^{d₀×N}, 목표 y∈ℝ^{1×N}에 대해 L층 MNN을 정의한다. 각 층 l의 전처리 u^{(l)} = W^{(l)}v^{(l‑1)}이며, 활성화 v^{(l)} = diag(a^{(l)})u^{(l)} 로 표현한다. 여기서 a^{(l)}(u) 는 leaky ReLU 형태이며, ϵ^{(l)}∈ℝ^{d_l×N} 로 표시되는 드롭아웃 잡음이 곱해져 a^{(l)} = ϵ^{(l)}·s(u) 로 정의된다. 손실은 평균 제곱 오차(MSE) L = ½E

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기