프라이버시 보존 반복 가중 최소제곱

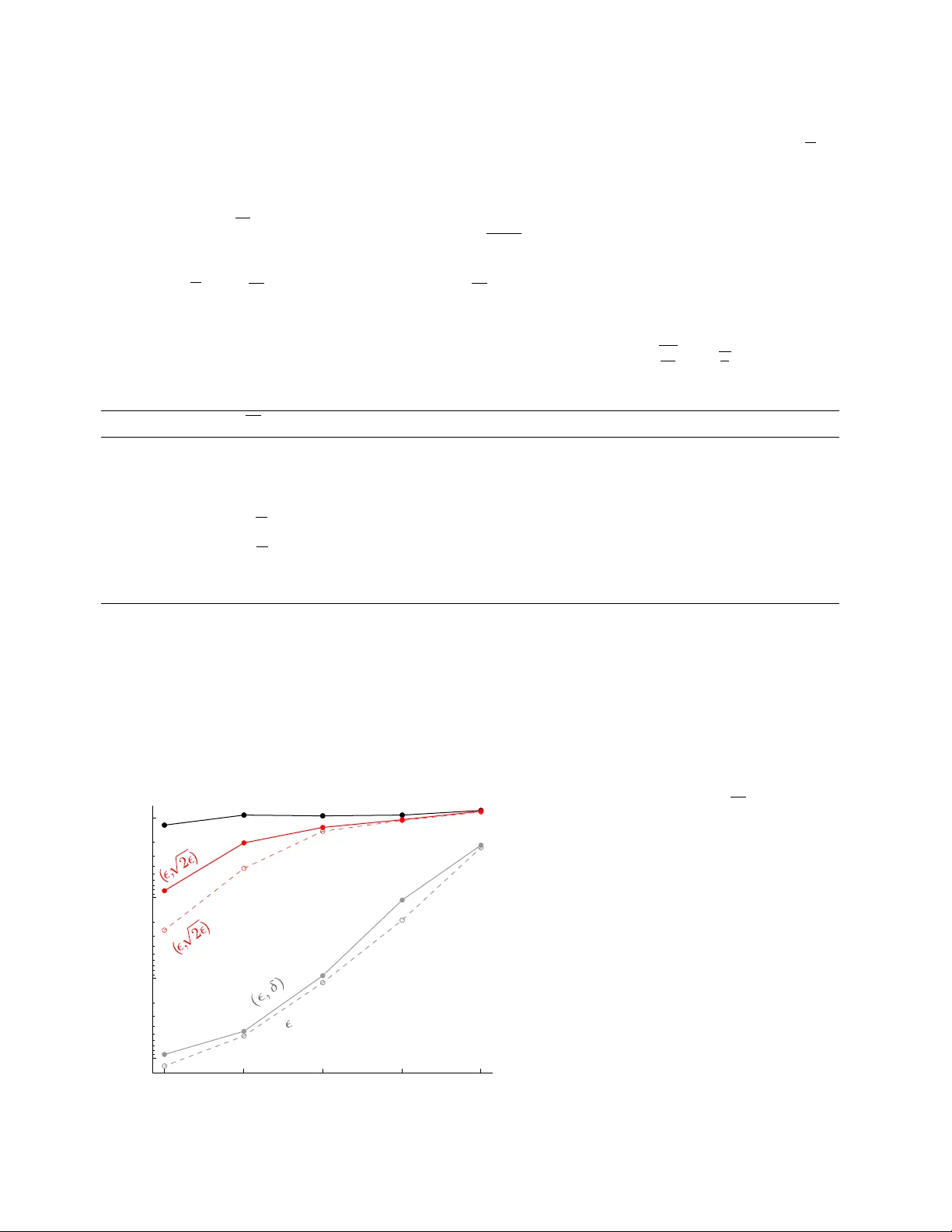

본 논문은 차등 프라이버시를 만족하면서 L1 정규화된 선형 모델을 풀기 위한 반복 가중 최소제곱(IRLS) 알고리즘을 설계한다. 두 번째 모멘트 행렬의 역연산에 따른 민감도 분석을 별도로 수행하고, 각 모멘트를 개별적으로 라플라스·가우시안·위시트 노이즈로 보호한다. 또한 집중 차등 프라이버시(CDP)를 활용해 반복 횟수에 따른 누적 프라이버시 손실을 크게 줄인다. 실험 결과, 기존 DP 기반 IRLS에 비해 동일 프라이버시 예산 하에서 훨씬 적…

저자: Mijung Park, Max Welling

본 논문은 차등 프라이버시(DP)를 만족하면서 L1 정규화된 선형 모델을 풀기 위한 반복 가중 최소제곱(Iteratively Reweighted Least Squares, IRLS) 알고리즘을 설계하고 분석한다. IRLS는 매 반복마다 가중된 첫 번째 모멘트 벡터 A와 가중된 두 번째 모멘트 행렬 B를 계산하고, θ̂ₜ = B⁻¹A 로 파라미터를 업데이트한다. 기존 DP 접근법은 B의 역연산이 포함되면 민감도 분석이 복잡해지고, 데이터 특성에 대한 강한 가정(예: 각 피처가 독립 정규분포) 없이는 현실적이지 않다. 또한 IRLS는 반복적인 특성 때문에 누적 프라이버시 손실이 크게 발생한다.

저자는 이러한 두 가지 문제를 해결하기 위해 다음과 같은 전략을 제시한다. 첫째, A와 B를 각각 별도의 민감도로 분석한다. 입력 데이터는 ‖xᵢ‖₂ ≤ 1, 출력 |yᵢ| ≤ 1 로 정규화하고, 가중치 sᵢ = max(1/δ, |yᵢ - xᵢᵀθ̂ₜ₋₁|) 로 정의한다. 이때 A의 ℓ₁-민감도는 Δ_A ≤ 2δ√d / N 으로 도출되며, 라플라스 메커니즘을 사용해 각 차원에 Lap(2δ√d/(Nε₀)) 노이즈를 추가한다. ℓ₂-민감도는 Δ₂A = 2δ / N 로, 가우시안 메커니즘을 적용하면 표준편차 σ ≥ c·Δ₂A/ε₀ (c² ≥ 2·log(1.25/δ')) 가 된다.

둘째, B는 양정 행렬이므로 위시트(Wishart) 노이즈를 사용한다. 구체적으로 d+1개의 d차원 가우시안 벡터 z_i ~ N(0, (δ²/(ε₀N))I_d) 를 샘플링하고, Z =

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기