계층적 메모리 네트워크

본 논문은 대규모 외부 메모리를 효율적으로 활용하기 위해 메모리를 계층 구조로 조직하고, 최대 내적 탐색(MIPS)을 이용해 하드와 소프트 어텐션의 장점을 결합한 새로운 메모리 접근 방식을 제안한다. 정확한 MIPS와 근사 MIPS를 모두 실험하여 학습 속도와 성능 사이의 트레이드오프를 분석하고, 대규모 사실 기반 질문응답 데이터셋인 SimpleQuestions에서 우수한 결과를 보였다.

저자: Sarath Ch, ar, Sungjin Ahn

논문은 메모리 네트워크가 외부 지식베이스와 같은 대규모 메모리를 활용할 때 직면하는 두 가지 주요 문제를 제시한다. 첫 번째는 소프트 어텐션(softmax 기반) 방식이 메모리 크기에 비례해 연산 비용이 급증한다는 점이다. 메모리 셀 수가 수백만 개에 달하면 전체 내적을 계산하고 정규화하는 과정이 GPU 메모리와 시간 측면에서 비현실적이다. 두 번째는 하드 어텐션(강화학습 기반) 방식이 이산적인 선택을 필요로 하며, REINFORCE와 같은 정책 그래디언트는 높은 분산과 불안정성으로 학습이 어려워 실제 적용 사례가 드물다.

이를 해결하기 위해 저자들은 “Maximum Inner Product Search”(MIPS)를 메모리 접근의 핵심 연산으로 채택한다. MIPS는 주어진 쿼리 벡터와 메모리 벡터들 사이의 내적을 최대화하는 상위 K개의 후보를 찾는 문제이며, 기존 연구에서 해시, 트리, 클러스터링 기반의 근사 알고리즘이 제안되었다. 논문은 이러한 근사 방법들을 활용해 메모리를 계층적으로 조직한다. 가장 낮은 레벨은 실제 사실을 표현하는 벡터 셀이며, 이 셀들은 클러스터링 혹은 해시를 통해 상위 레벨의 그룹으로 묶인다. 각 그룹은 대표 중심(centroid) 혹은 해시 코드로 요약되어, 쿼리와의 내적 계산을 먼저 상위 레벨에서 수행한다. 이렇게 하면 전체 메모리와의 직접적인 내적 연산을 피하고, 상위 레벨에서 후보 그룹을 빠르게 좁힌 뒤, 선택된 그룹 내부에서 정확한 내적을 수행한다. 결과적으로 검색 복잡도는 선형에서 로그 혹은 sub‑linear 수준으로 감소한다.

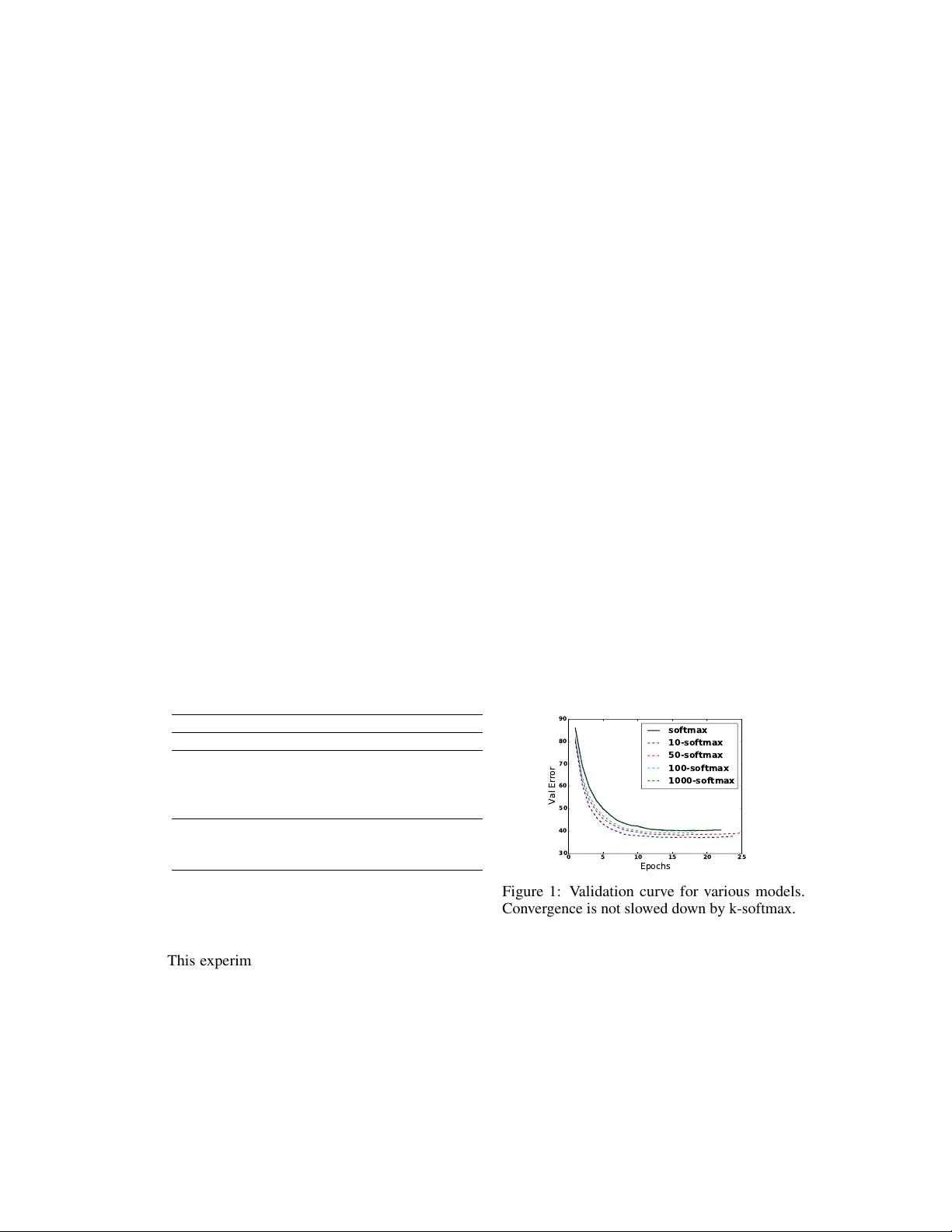

학습 단계에서는 기존의 softmax를 변형한 “softmax(K)”를 도입한다. 일반적인 softmax는 전체 메모리 행렬 M에 대해 q·M를 계산하고 정규화하지만, softmax(K)는 먼저 K‑MIPS를 통해 상위 K개의 인덱스 C를 추출하고, 그 서브매트릭스 M

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기