방어적 증류로 적대적 교란에 맞서는 딥러닝

** 본 논문은 적대적 샘플에 취약한 딥 뉴럴 네트워크(DNN)를 방어하기 위해 ‘방어적 증류(defensive distillation)’라는 학습 기법을 제안한다. 기존 모델을 높은 온도(temperature) 소프트맥스 출력으로 재학습함으로써 모델의 기울기를 크게 완화하고, 입력 변화에 대한 민감도를 낮춘다. 실험 결과, MNIST와 CIFAR‑10 데이터셋에서 적대적 샘플 성공률을 95 % 이상에서 0.5 % 이하로 감소시켰으며, 최소…

저자: Nicolas Papernot, Patrick McDaniel, Xi Wu

**

본 논문은 딥 러닝 모델이 적대적 샘플에 취약하다는 문제를 제기하고, 이를 해결하기 위한 새로운 방어 메커니즘인 ‘방어적 증류(defensive distillation)’를 제안한다. 기존의 증류 기법은 큰 모델이 학습한 지식을 작은 모델에 전달해 연산량을 줄이고 일반화 성능을 유지하는 데 사용되었지만, 저자들은 이 아이디어를 동일 모델 내부에서 재학습하는 형태로 변형한다. 구체적으로, 먼저 원본 모델을 높은 온도 T (예: 20~100)로 소프트맥스 함수를 적용해 부드러운 확률 분포를 얻는다. 이 확률 벡터는 각 클래스에 대한 ‘연관성 정보’를 담고 있어, 원-핫 라벨보다 풍부한 신호를 제공한다. 이후 동일한 네트워크 구조를 사용해 이 부드러운 라벨을 목표로 다시 학습한다.

이 과정에서 두 가지 핵심 효과가 발생한다. 첫째, 손실 함수가 다중 클래스 간의 관계를 반영함에 따라 역전파 시 발생하는 그래디언트가 크게 감소한다. 논문에서는 그래디언트 크기가 10³⁰ 배 정도 억제된다는 실험적 수치를 제시한다. 둘째, 모델의 입력 공간에 대한 스무딩이 이루어져, 작은 입력 변동에 대한 출력 변화가 완만해진다. 수학적으로는 ∥∂F/∂X∥이 온도 T 에 반비례함을 증명하고, 이는 적대적 교란을 만들기 위해 필요한 변형량을 크게 늘린다.

논문은 먼저 적대적 샘플의 개념과 기존 공격 방법을 정리한다. 공격자는 두 단계(‘방향 민감도 추정’과 ‘교란 선택’)를 반복해 입력 X에 작은 교란 δX를 더해 목표 라벨 Y*를 강제한다. 이때 교란은 인간이 인식하기 어려울 정도로 작아야 하며, 모델의 그래디언트가 클수록 적은 교란으로도 성공한다는 점을 강조한다.

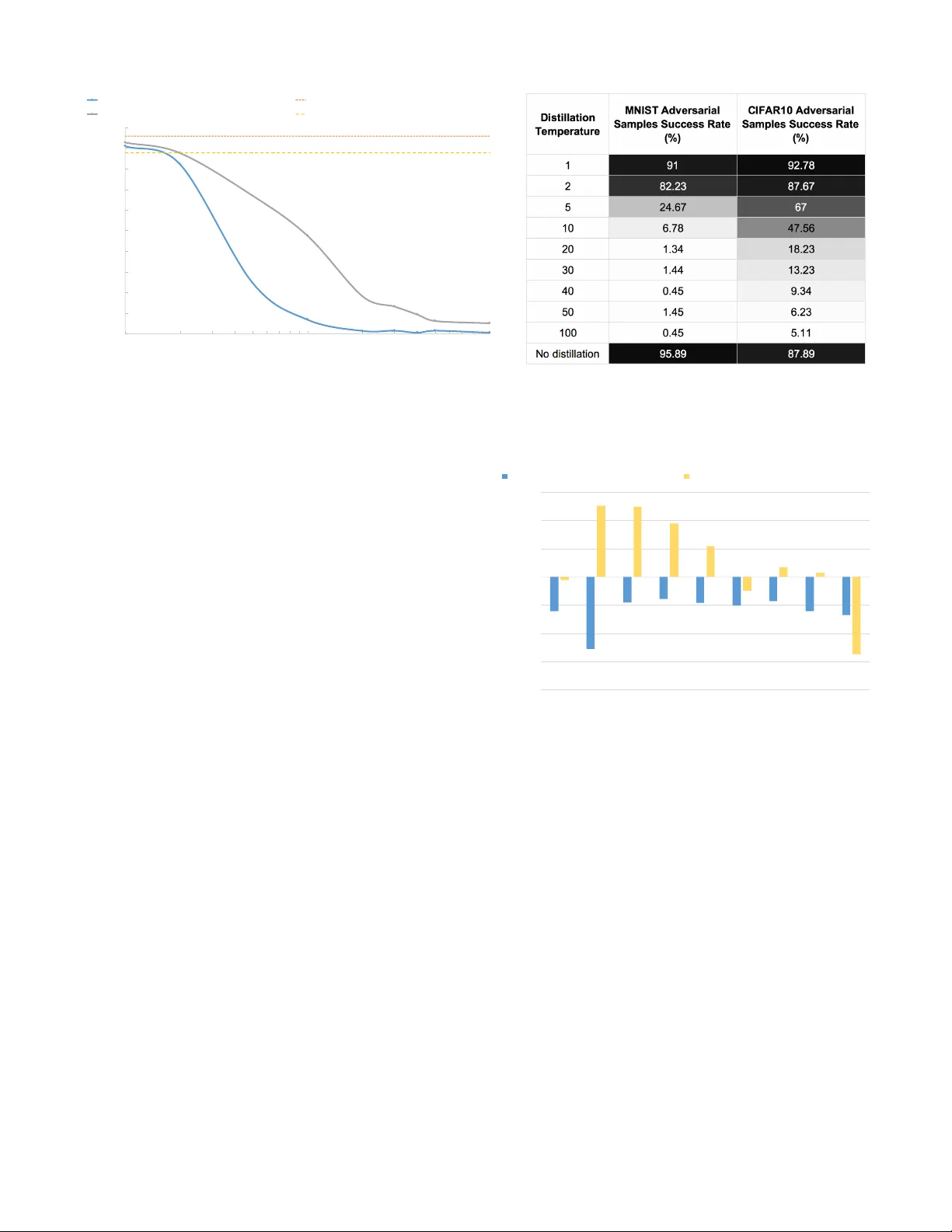

실험은 두 개의 대표적인 이미지 분류 네트워크에 대해 수행된다. 첫 번째는 MNIST 데이터셋을 사용한 9층 CNN, 두 번째는 CIFAR‑10 데이터셋을 사용한 12층 CNN이다. 각각에 대해 표준 적대적 공격(Fast Gradient Sign Method, Jacobian‑based Saliency Map Attack)을 적용했을 때, 방어적 증류를 적용하지 않은 모델은 95 % 이상의 성공률을 보였다. 반면, 방어적 증류를 적용한 모델은 성공률이 각각 0.45 %와 5.11 %로 급격히 감소하였다. 또한, 최소 교란 픽셀 수가 평균 790 %와 556 % 증가해, 공격자가 목표 라벨을 달성하기 위해 훨씬 더 많은 변형을 가해야 함을 확인했다.

논문은 방어적 증류가 모델 정확도(정확도 저하 <1 %)를 유지하면서도 적대적 샘플에 대한 내성을 크게 향상시킨다는 점을 강조한다. 그러나 방어가 완전하지 않으며, 온도 T 값 선택이 중요하고, 높은 T 는 학습 수렴을 어렵게 할 수 있다. 또한, 공격자는 방어된 모델의 온도 정보를 추정하거나, 온도‑특화 적대적 샘플을 설계함으로써 방어를 우회할 가능성이 있다. 저자들은 향후 연구로 이러한 고급 공격에 대한 대응, 다른 네트워크 구조(예: RNN, Transformer) 적용, 그리고 증류와 다른 방어 기법(예: 입력 정규화, 랜덤화)과의 조합을 제시한다.

결론적으로, 방어적 증류는 적대적 교란에 대한 효과적인 방어 수단으로, 기존 딥러닝 파이프라인에 큰 구조적 변화를 요구하지 않으며, 비교적 낮은 비용으로 보안성을 크게 강화할 수 있음을 입증한다.

**

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기