빠른 이중언어 단어 임베딩 모델 BilBOWA

BilBOWA는 대규모 단일언어 텍스트와 소규모 문장 정렬 병렬 코퍼스를 이용해, 단어 정렬 없이 이중언어 단어 임베딩을 효율적으로 학습하는 방법이다. 단어‑단어 정렬 대신 샘플링된 bag‑of‑words 교차 손실을 도입해 연산량을 크게 줄였으며, 기존 방법보다 빠른 학습 속도와 높은 번역·문서 분류 성능을 보인다.

저자: Stephan Gouws, Yoshua Bengio, Greg Corrado

**1. 서론**

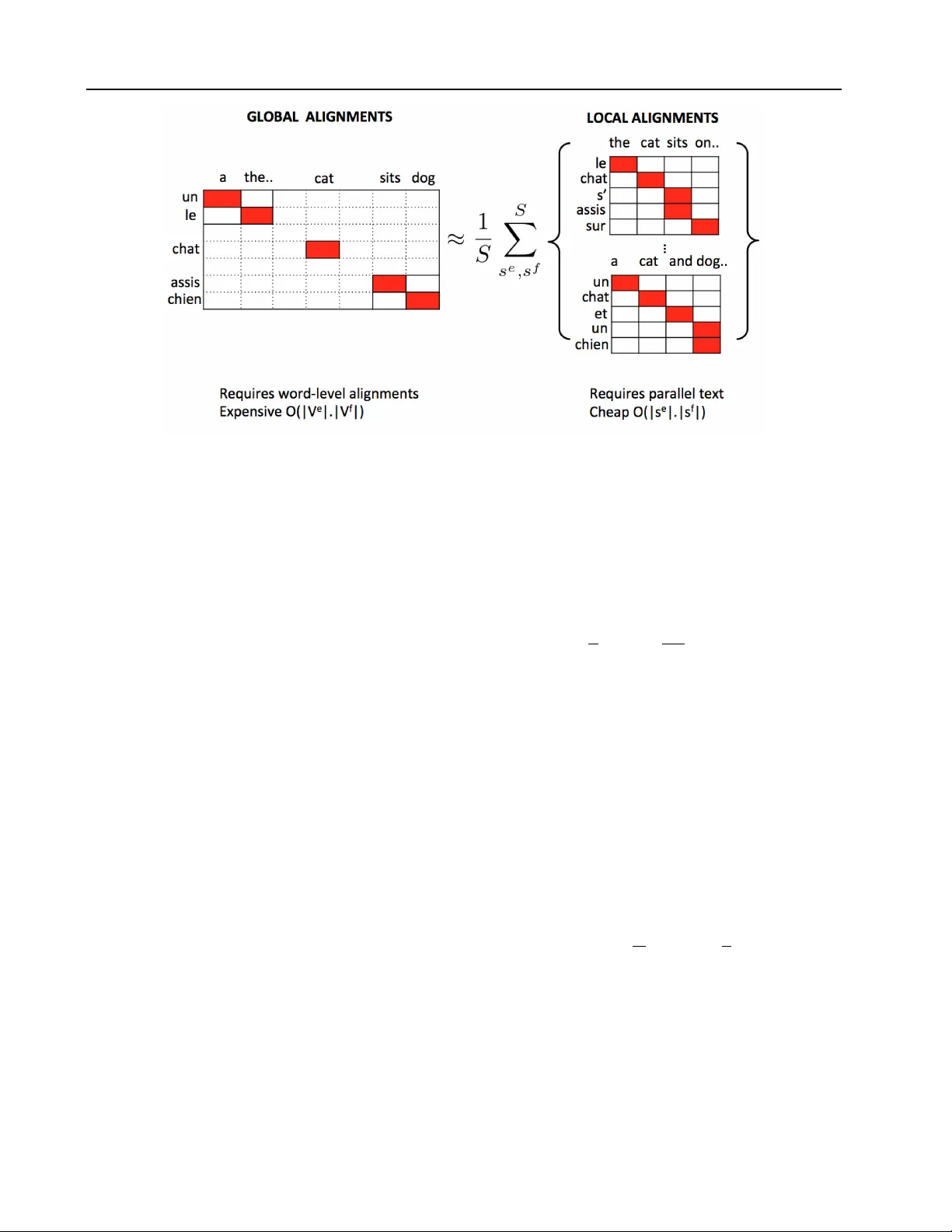

자연어 처리에서 라벨이 풍부한 영어와 달리 다국어 환경에서는 라벨이 부족한 경우가 많다. 이를 극복하기 위해 단어 수준의 분산 표현을 무감독으로 학습하고, 서로 다른 언어 간에 의미적 정렬을 시도하는 연구가 활발히 진행돼 왔다. 기존 방법은 (i) 각각의 언어에 대해 독립적으로 임베딩을 학습한 뒤 사전 기반 정렬을 수행하거나, (ii) 병렬 문장만을 이용해 공동 학습하거나, (iii) 두 목표를 동시에 최적화하지만 정규화 비용이 어휘 크기의 곱에 비례해 비효율적이다. 특히, 병렬 데이터는 양이 제한적이며 도메인 편향을 초래한다.

**2. 관련 연구**

Mikolov et al. (2013a)의 선형 변환 기반 정렬, Faruqui & Dyer (2014)의 CCA, BiCVM (Hermann & Blunsom, 2013) 및 Bilingual Auto‑Encoder (Chandar et al., 2014) 등 다양한 접근법이 제안되었다. 그러나 이들 방법은 (a) 대규모 단일언어 데이터 활용이 어려워 성능 한계가 존재하거나, (b) 정렬 단계에서 추가적인 어휘 정렬 툴이 필요해 구현 복잡도가 높다.

**3. BilBOWA 모델 설계**

- **Monolingual 손실 L**: 기존 skip‑gram 모델에 negative sampling을 적용해 단어‑컨텍스트 쌍을 효율적으로 학습한다. 이는 어휘 크기에 독립적인 O(k) 연산을 보장한다(k는 샘플링된 노이즈 단어 수).

- **Cross‑lingual 손실 Ω (BilBOWA‑loss)**: 문장‑정렬된 병렬 코퍼스에서 각 문장의 bag‑of‑words 평균 임베딩을 구하고, 두 언어의 평균 벡터 차이를 L2‑norm으로 최소화한다. 수식적으로는

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기