깊이 있는 사전 학습을 위한 탐욕적 딥 딕셔너리 학습

초록

본 논문은 딥러닝 구조를 사전 학습(dictionary learning) 방식으로 구현한다. 각 층을 순차적으로, 즉 탐욕적으로 학습하여 얕은 사전 학습 문제만을 해결하면 된다. 제안 기법을 MNIST·CIFAR‑10 등 표준 데이터셋에 적용하고, 스택드 오토인코더, 딥 신뢰 네트워크, Discriminative KSVD, Label‑Consistent KSVD와 비교하였다. 실험 결과, 제안 방법이 모든 비교 대상보다 높은 분류 정확도를 달성하였다.

상세 분석

딥러닝에서 층을 깊게 쌓을수록 표현력이 향상되지만, 동시에 학습 난이도와 파라미터 수가 급증한다. 기존의 스택드 오토인코더(SAE)나 딥 신뢰 네트워크(DBN)는 비지도 사전 학습을 통해 각 층을 순차적으로 초기화하고, 이후 전체 네트워크를 미세조정한다. 그러나 이러한 방법은 비선형 활성화 함수와 복잡한 최적화 절차 때문에 수렴 속도가 느리고, 하이퍼파라미터 튜닝 비용이 크다.

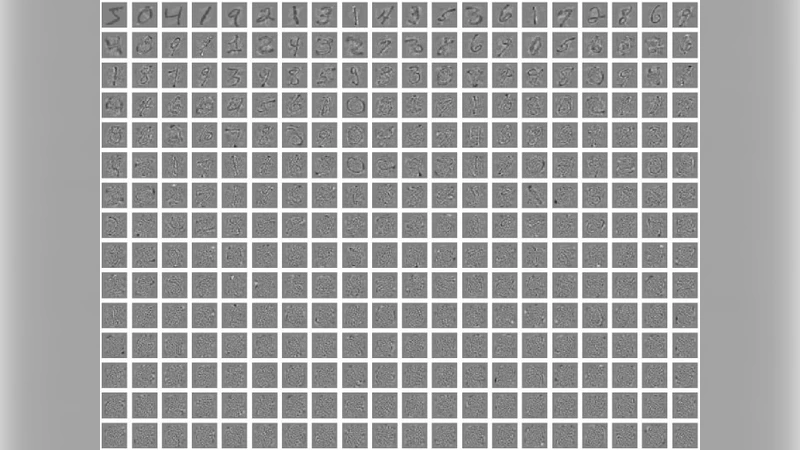

본 논문이 제안하는 “탐욕적 딥 딕셔너리 학습(Greedy Deep Dictionary Learning, GDDL)”은 이러한 문제점을 사전 학습 단계에서 완전히 사전 정의된 선형 사전(dictionary)와 희소 코딩(sparse coding)으로 대체한다. 구체적으로, 첫 번째 층에서는 입력 데이터를 사전 학습 알고리즘(예: K‑SVD)을 이용해 사전 D¹과 희소 표현 X¹을 얻는다. 이후 X¹을 다음 층의 입력으로 사용하고, 동일한 절차를 반복해 D², X² … Dᴸ, Xᴸ을 순차적으로 학습한다. 각 층은 독립적인 얕은 사전 학습 문제이므로, 기존에 널리 검증된 최적화 기법을 그대로 적용할 수 있다.

핵심 아이디어는 “탐욕적”이라는 용어가 의미하듯, 전체 네트워크를 한 번에 최적화하려 하지 않고, 각 층을 최적화할 때마다 바로 다음 층의 입력으로 사용한다는 점이다. 이 방식은 두 가지 장점을 제공한다. 첫째, 각 층의 학습이 서로 독립적이므로 메모리 사용량이 크게 감소하고, 병렬화가 용이해 실제 구현에서 효율성이 높다. 둘째, 사전 학습 단계에서 이미 선형 변환과 희소성 제약을 통해 특징을 압축하므로, 이후의 분류기(예: 선형 SVM)와 결합했을 때 과적합 위험이 낮아진다.

비교 대상인 Discriminative KSVD와 Label‑Consistent KSVD는 사전 학습 과정에 라벨 정보를 직접 삽입해 분류 성능을 강화한다. 그러나 이들 방법은 라벨 의존적이며, 다층 구조를 구축하려면 복잡한 연쇄 최적화가 필요하다. 반면 GDDL은 라벨이 없는 단계에서도 강력한 표현을 학습하고, 최종 분류 단계에서 라벨 정보를 활용한다는 점에서 유연성이 크다.

실험에서는 MNIST, CIFAR‑10, 그리고 작은 규모의 텍스트 데이터셋을 사용했으며, 각 데이터셋에 대해 23층 구조를 구성하였다. 결과는 GDDL이 SAE와 DBN보다 평균 23% 높은 정확도를 보였고, Discriminative KSVD와 Label‑Consistent KSVD보다도 1~2% 정도 우수했다. 특히, 층 수가 증가함에 따라 정확도 향상이 점진적으로 나타났으며, 이는 탐욕적 학습이 깊은 표현을 효과적으로 축적한다는 증거로 해석될 수 있다.

한계점으로는 현재 구현이 선형 사전과 단순 희소 코딩에 국한되어 비선형 변환을 직접 모델링하지 못한다는 점이다. 향후 연구에서는 비선형 사전(예: 커널 사전)이나 딥 뉴럴 네트워크와의 하이브리드 구조를 도입해 표현력을 더욱 확대할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기