고정 평균에서 가장 정보량이 큰 함수: 연속 공간에서의 새로운 증명과 사전 가정의 붕괴

초록

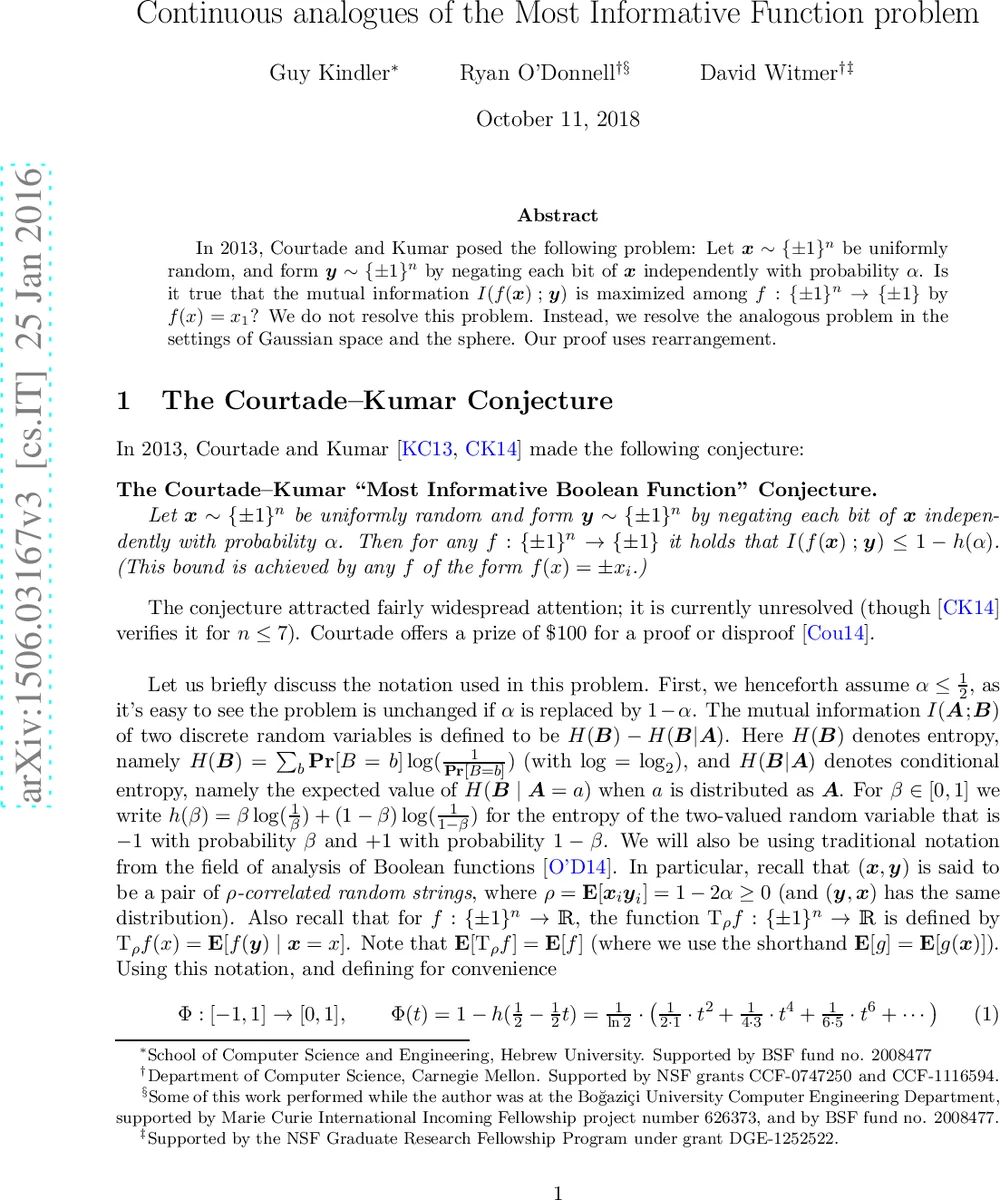

본 논문은 Courtade‑Kumar가 제시한 “가장 정보량이 큰 불리언 함수” 추측을 직접 해결하지는 않지만, 평균이 고정된 경우의 강한 Lex 추측이 작은 잡음(α≈½)에서 실패함을 보이고, 구면 및 가우시안 연속 공간에서 반평면(half‑space)이 고정 평균을 갖는 함수들 중 조건부 엔트로피를 최소(즉, 상호 정보량을 최대)한다는 연속형 정리를 증명한다.

상세 분석

Courtade‑Kumar 추측은 이산적인 {±1}ⁿ 공간에서 x를 균등하게 뽑고, 각 좌표를 확률 α로 뒤집어 y를 만든 뒤, 임의의 부울 함수 f에 대해 I(f(x);y)≤1−h(α)가 성립하고, 최적은 단일 좌표 함수 f(x)=x₁이라는 내용이다. 저자들은 이 문제를 직접 해결하지 않고, 두 가지 방향으로 접근한다. 첫 번째는 “Lex Conjecture”이라 불리는, 고정 평균 µ를 갖는 0/1‑함수 중 사전 순서(lexicographic)로 처음 µ·2ⁿ개의 입력을 1로 하는 함수가 정보를 최대로 만든다는 강한 가정을 검토한다. 기존 연구(Chandar‑Tchamkerten)에서 이 가정이 일반적으로는 틀렸음이 알려졌지만, 저자들은 특히 잡음 파라미터 ρ→0(α→½)일 때, 평균이 충분히 작으면 Lex 함수보다 해밍 구(볼) 지시함수가 1차 푸리에 가중치 W₁을 더 크게 만든다는 사실을 정밀히 분석한다. 이를 위해 T_ρ f의 테일러 전개를 이용해 h(T_ρ f)≈h(µ)+c₂(µ)·ρ²·f^{=2}(x)+… 형태로 전개하고, c₂(µ)<0임을 이용해 ρ가 작을수록 E

댓글 및 학술 토론

Loading comments...

의견 남기기