비선형성의 함정 탈피: 텐서 기반 신경망 학습의 새로운 보장

본 논문은 2층 신경망(하나의 은닉층)을 텐서 분해와 모멘트 방법을 이용해 학습하는 NN‑LIFT 알고리즘을 제안한다. 입력 분포의 점수 함수(score function)를 활용해 출력과 입력의 고차 교차 모멘트를 구성하고, 이를 3차 텐서 CP 분해로부터 은닉층 가중치를 복원한다. 이후 Fourier 기반 편향 추정과 선형 회귀로 출력층을 학습한다. 저자는 비선형 활성화와 일반 연속 입력 분포를 허용하면서, 샘플 복잡도와 계산 복잡도가 다항식…

저자: Majid Janzamin, Hanie Sedghi, Anima An

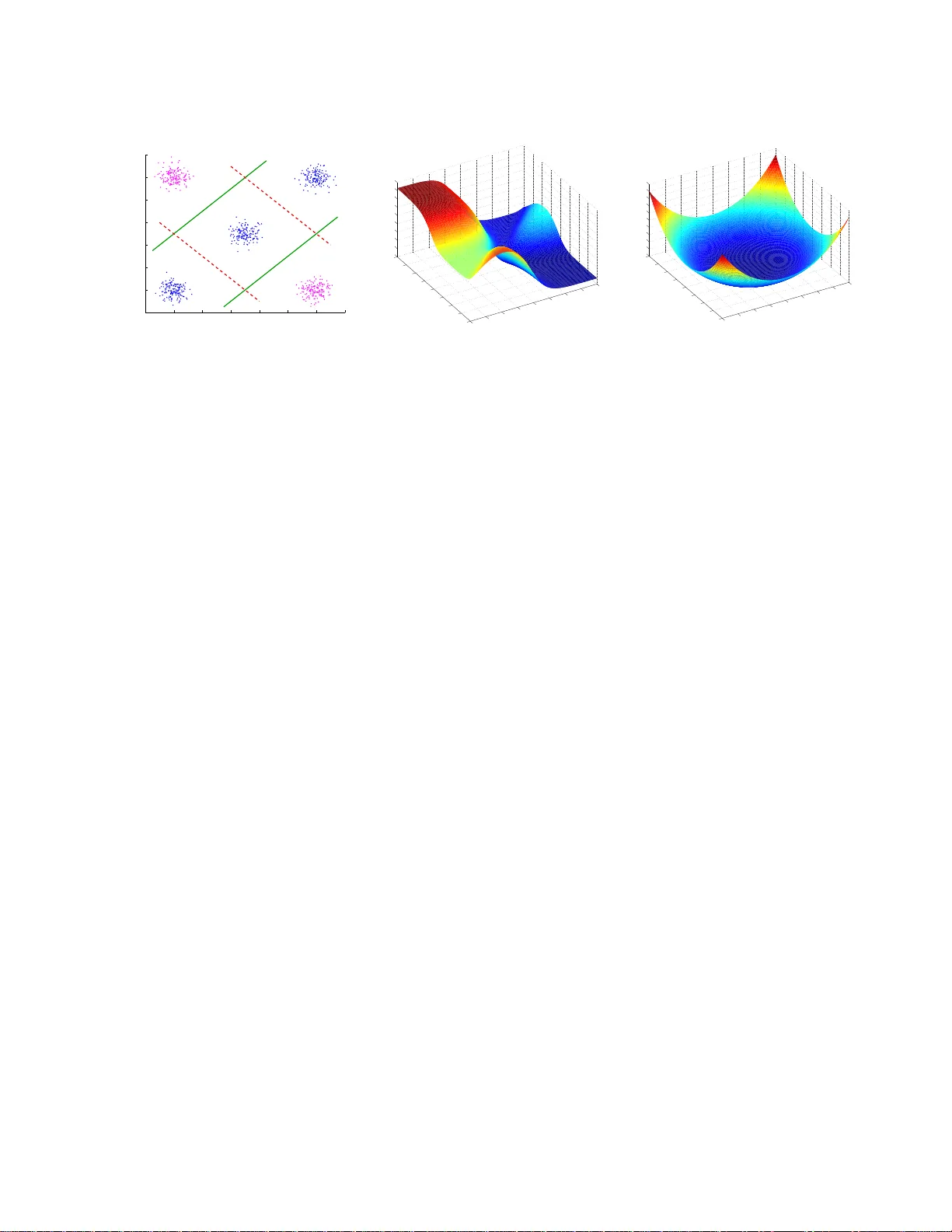

본 논문은 2층 피드포워드 신경망(입력‑은닉‑출력 구조) 학습을 텐서 분해와 모멘트 방법을 결합한 새로운 알고리즘 NN‑LIFT(Neural Network‑Learning using Feature Tensors)으로 해결한다. 기존의 역전파 기반 최적화는 손실 함수의 비선형성으로 인해 다수의 스펙트럼 포인트와 지역 최적점에 갇히는 문제가 있었으며, 특히 고차원에서는 이러한 현상이 지수적으로 악화된다. 저자들은 이러한 비선형 최적화 문제를 “입력 분포의 점수 함수(score function)”와 “출력과의 교차 고차 모멘트”라는 새로운 관점으로 재구성한다.

**핵심 아이디어**

1. **점수 함수와 고차 텐서**: 연속적인 입력 확률밀도 p(x)의 로그 미분 ∇log p(x)와 그 고차 미분(두 번째는 행렬, 세 번째는 3‑차 텐서)을 점수 함수 S₁, S₂, S₃라 정의한다. 이들은 입력의 통계적 구조를 압축한 형태이며, 입력이 가우시안이든 일반적인 연속 분포이든 계산 가능하도록 설계되었다.

2. **교차 모멘트 텐서 구성**: 출력 y와 3차 점수 텐서 S₃(x)의 교차 모멘트 T = E

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기