활성 샘플러 대규모 데이터 분석 가속기

활성 샘플러는 SGD 학습 시 데이터 샘플링을 손실 기울기 크기에 비례하도록 가중화함으로써 샘플링 편향을 도입하고, 이를 역가중치로 보정해 기존 목표함수를 유지한다. 이론적으로 정보 이득을 최대로 하고 분산을 최소화함을 증명했으며, 벡터화된 경량 구현을 통해 SVM, 특성 선택, 딥러닝 등 다양한 모델에 적용해 1.6‑2.2배의 학습 속도 향상을 달성했다.

저자: Jinyang Gao, H.V.Jagadish, Beng Chin Ooi

본 논문은 “빅 모델”을 학습하기 위해 대량의 데이터를 효율적으로 활용하는 방법을 탐구한다. 대부분의 대규모 머신러닝 알고리즘은 경험적 위험 최소화(ERM) 프레임워크 아래, 손실 함수와 정규화 항을 합한 목표 함수를 최소화하는 형태로 정의된다. 전통적인 배치 경사 하강법은 전체 데이터에 대해 그라디언트를 계산하므로 연산 비용이 prohibitive 하다. 이를 해결하기 위해 확률적 경사 하강법(SGD)이 도입되었지만, 무작위 단일 샘플에 기반한 그라디언트는 높은 분산을 가지며, 이는 수렴 속도를 저하시킨다.

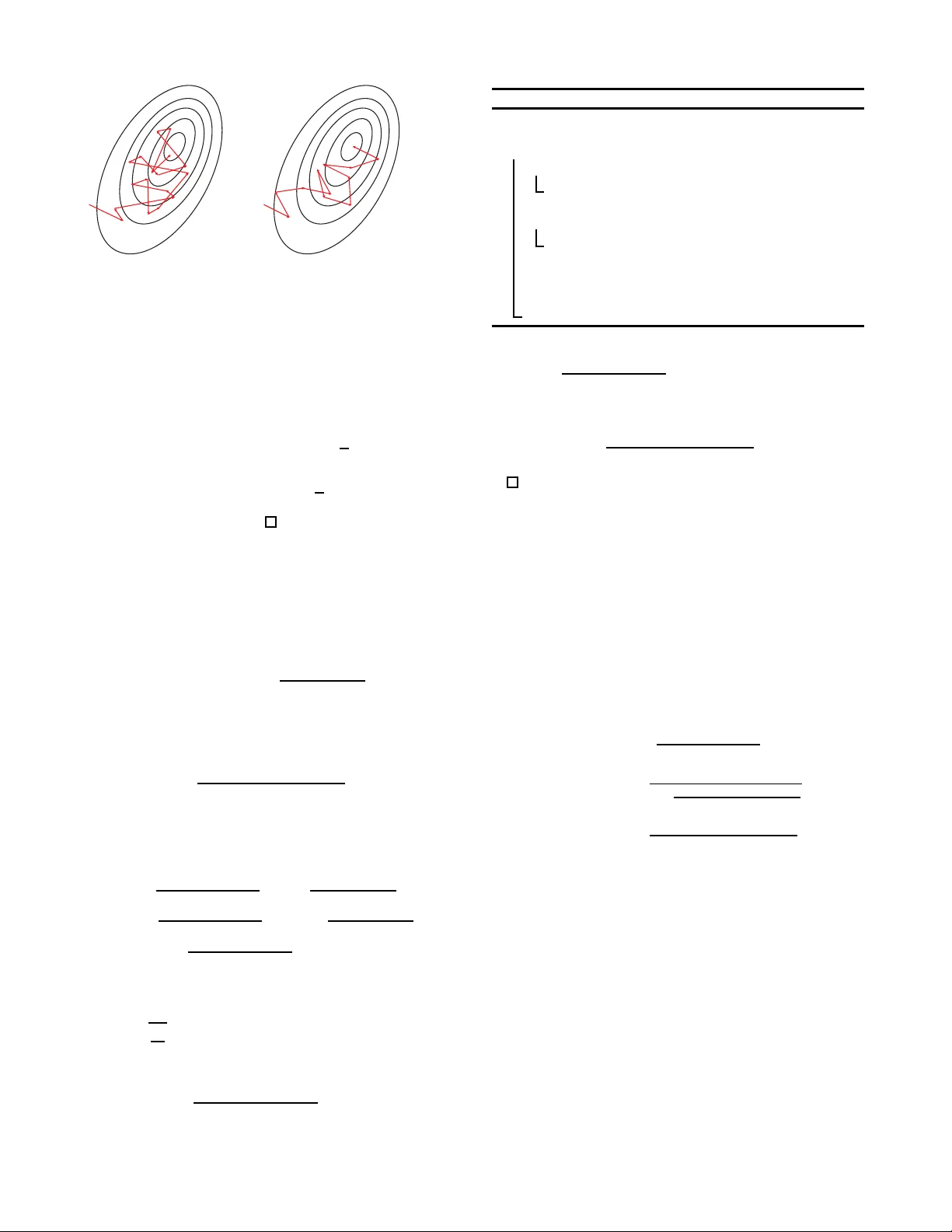

논문은 이러한 문제를 ‘샘플링 단계에서 정보 이득을 극대화한다’는 관점으로 재구성한다. 활성 학습(active learning)에서처럼, 현재 모델이 가장 불확실하거나 손실이 큰 데이터 포인트가 학습에 더 큰 영향을 미친다. 따라서 각 샘플 i에 대해 현재 파라미터 w에서의 기울기 크기 ‖∇L_i(w)‖ 를 추정하고, 이를 샘플링 확률 p_i에 비례하도록 설정한다. 즉, p_i = ‖∇L_i(w)‖ / Σ_j ‖∇L_j(w)‖ 로 정의한다.

편향된 샘플링을 사용하면 기대값이 변할 우려가 있지만, 논문은 역가중치 1/p_i 를 곱한 스토캐스틱 그라디언트 g_i(w)=∇L_i(w)/p_i 가 여전히 무편향임을 수학적으로 증명한다( E

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기