머신러닝에서 간접 차별을 측정하는 방법론 종합 조사

본 논문은 역사적 데이터에 내재된 편향으로 인해 발생할 수 있는 간접 차별을 탐지하고 방지하기 위한 다양한 측정 지표들을 체계적으로 정리한다. 통계적 검정, 절대·조건부·구조적 지표들을 분류하고, 핵심 지표들의 수학적·계산적 특성을 비교 분석한다. 또한 실무 적용을 위한 측정 절차와 연구·실무자를 위한 권고사항을 제시한다.

저자: Indre Zliobaite

논문은 현대 사회에서 예측 모델이 의사결정에 광범위하게 활용되는 현황을 배경으로, 이러한 모델이 역사적 데이터에 내재된 편향을 그대로 학습함으로써 간접 차별을 초래할 위험성을 강조한다. 먼저 법적·사회적 맥락에서 차별의 정의와 직접·간접 차별의 구분을 제시하고, 특히 간접 차별이 머신러닝 모델에 어떻게 적용되는지를 설명한다. 이어서 차별 인식·방지를 위한 두 주요 연구 흐름인 차별 발견(Discrimination Discovery)과 차별 예방(Discrimination Prevention)을 소개한다. 차별 발견은 데이터에서 차별적 패턴을 탐지하는 과정이며, 전통적인 통계 회귀 분석이나 연관 규칙 마이닝을 활용한다. 차별 예방은 학습 단계에서 데이터 전처리, 모델 후처리, 정규화 기법 등을 적용해 결과 모델이 차별 제약을 만족하도록 설계한다.

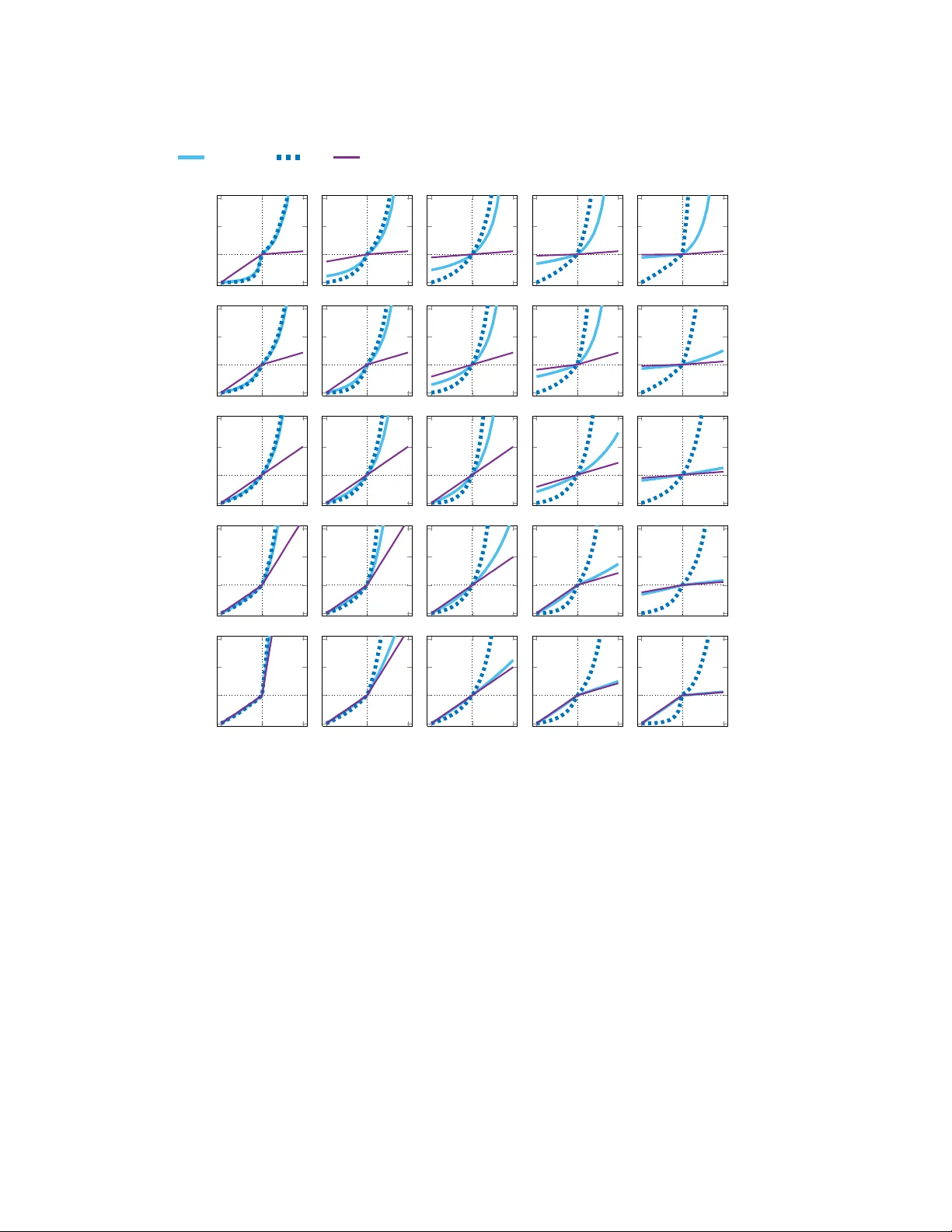

핵심 부분에서는 차별 측정 지표들을 체계적으로 분류한다. 통계적 검정(Regression slope test, Difference of means, Difference in proportions 등)은 가설 검정 형태로 차별 여부를 판단한다. 절대적 지표는 Mean Difference, Normalized Difference, AUC, Impact Ratio, e‑lift, Odds Ratio, Mutual Information, Balanced Residuals 등을 포함하며, 두 그룹 간 결과 차이를 직접 수치화한다. 조건부 지표는 Unexplained Difference, Propensity measure, Belift ratio 등 보호 속성과 비보호 속성 사이의 상관관계를 보정하여 보다 공정한 차별 평가를 가능하게 한다. 구조적 지표는 Situation testing과 Consistency를 통해 모델이 동일한 비보호 특성을 가진 개인에게 일관된 예측을 제공하는지를 검증한다.

논문은 선택된 핵심 지표들에 대해 수학적 정의, 계산 복잡도, 민감도, 데이터 불균형에 대한 견고성 등을 비교 분석한다. 예를 들어, 평균 차이는 직관적이지만 클래스 불균형에 민감하고, 정규화 차이는 비율 기반으로 불균형에 더 강인하지만 해석이 복잡할 수 있다. Odds Ratio와 e‑lift는 비율 기반이지만 작은 샘플에서 변동성이 크다. 조건부 지표는 보호 속성의 분포 차이를 보정하지만, 정확한 propensity 모델링이 필요하다. 구조적 지표는 실제 적용 시 시뮬레이션 비용이 높아 실무 적용에 제약이 있다.

마지막으로 측정 절차와 실무 적용을 위한 권고사항을 제시한다. 데이터 수집 단계에서 보호 속성을 명시하고, 사전 탐색적 분석을 통해 데이터 편향을 파악한다. 측정 시에는 교차 검증을 통한 안정성 검증과, 다중 보호 속성(Intersectionality)을 고려한 다그룹 분석을 권장한다. 또한 정책 입안자와 실무자는 측정 목표(차별 발견 vs. 차별 억제), 법적 기준, 비즈니스 요구사항을 종합적으로 고려해 적절한 지표와 임계값을 선택해야 한다. 연구자는 향후 연구 방향으로 지표 간 통합 프레임워크 구축, 실시간 차별 모니터링 시스템 개발, 그리고 다양한 도메인(금융, 고용, 형사 사법 등)에서의 적용 사례 연구를 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기