강화학습으로 STL 사양의 강인성 최적화

초록

본 논문은 확률적이고 미지의 동적 시스템을 신호시간논리(STL) 사양에 맞게 제어하기 위해, 상태를 τ-길이 히스토리로 구성한 τ‑MDP 모델을 도입하고, Q‑러닝 기반 두 가지 강화학습 알고리즘을 제시한다. 하나는 사양 만족 확률을 최대화하고, 다른 하나는 기대 강인성(robustness) 값을 최대화한다. 시뮬레이션 로봇 내비게이션 사례를 통해 강인성 최적화 정책이 만족 확률과 평균 강인성 모두에서 확률 최적화 정책을 능가함을 실증한다.

상세 분석

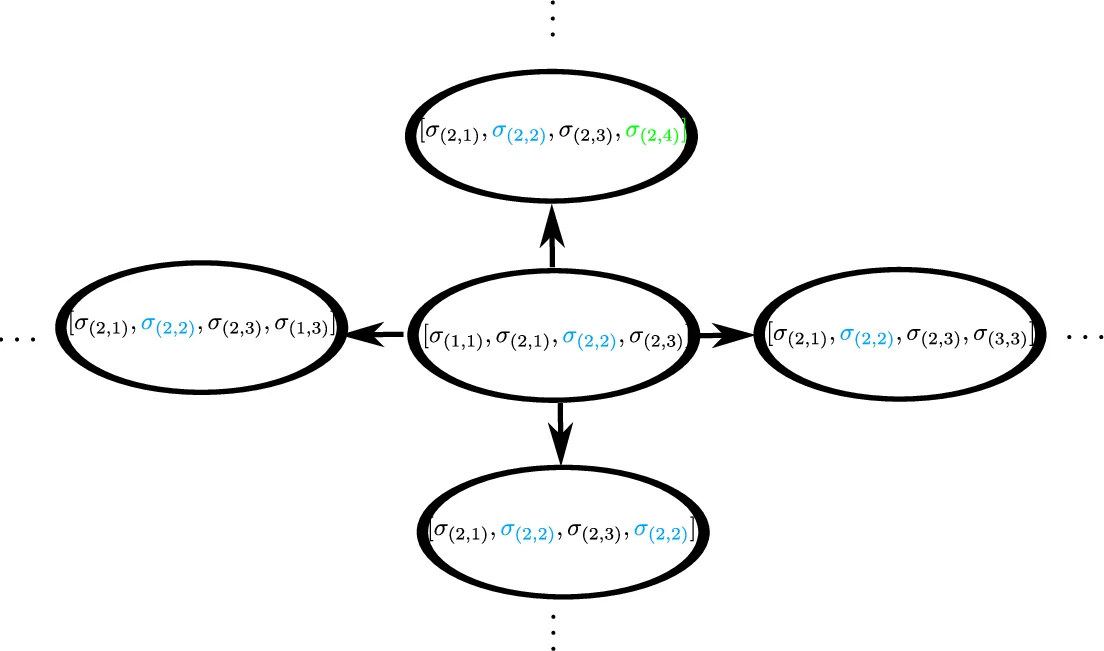

이 연구는 기존의 LTL 기반 강화학습이 갖는 시간‑추상적 한계를 넘어, 시간‑구속 의미를 갖는 STL을 직접 다루는 새로운 프레임워크를 제시한다. 핵심 아이디어는 STL 공식의 horizon τ를 이용해 시스템의 최근 τ 단계 상태를 하나의 복합 상태로 묶어 τ‑MDP를 구성함으로써, 시간‑의존적인 논리 검증을 마코프 결정 과정으로 변환하는 것이다. 이렇게 하면 기존의 DRA와 같은 자동화 변환이 필요 없으며, 상태‑공간을 유한히 분할한 뒤 각 파티션을 정점으로 하는 그래프 G를 정의하고, 인접 파티션 간 전이만 허용하도록 가정함으로써 전이 확률을 마코프성으로 보장한다.

두 가지 최적화 목표는 각각 (5)와 (6) 식에 명시된다. 첫 번째는 만족 확률을 직접 최대화하는 전통적 접근법으로, Q‑learning을 통해 만족 여부를 0/1 보상으로 사용한다. 두 번째는 STL의 정량적 의미인 robustness r(s, φ)를 보상으로 삼아, 기대 강인성을 최대화한다. 강인성 보상은 연속적인 실수값을 제공하므로, 학습 과정에서 더 풍부한 신호를 전달해 정책 탐색을 가속화한다. 논문은 강인성 최적화 정책이 특정 클래스(예: 만족 가능성이 0이 아닌 경우)에서는 확률 최적화 정책과 동일한 만족 확률을 보장하고, 만족이 불가능한 경우에도 가능한 한 사양에 근접하도록 행동한다는 이론적 정리를 제시한다.

알고리즘 수렴성은 Q‑learning의 표준 가정(학습률 감소, 충분한 탐험) 하에 보장되며, 실험에서는 에피소드 수가 제한된 상황에서도 강인성 기반 정책이 빠르게 높은 만족 확률에 도달함을 확인한다. 특히, 로봇이 목표 영역을 ‘강하게’ 통과하도록 유도함으로써, 작은 외란이나 모델링 오류에도 사양 위반 위험을 감소시킨다.

이 연구는 STL의 정량적 해석을 강화학습에 자연스럽게 통합함으로써, 복잡한 시간‑구속 임무를 수행해야 하는 로봇·드론·자동차 등 실제 시스템에 적용 가능한 실용적인 방법론을 제공한다. 또한, τ‑MDP라는 메모리 기반 마코프 모델링이 STL의 히스토리 의존성을 효율적으로 캡처한다는 점에서, 향후 더 일반적인 STL fragment나 연속‑시간 시스템에도 확장 가능성을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기