온라인 텐서 기반 잠재 변수 모델 학습: 커뮤니티 탐지와 토픽 모델링

본 논문은 확률적 경사 하강법을 이용해 순간 텐서를 직접 형성하지 않고 온라인으로 분해함으로써, 대규모 소셜 네트워크의 커뮤니티 탐지와 뉴스 기사 토픽 모델링을 고속·고정밀하게 수행하는 방법을 제안한다.

저자: Furong Huang, U. N. Niranjan, Mohammad Umar Hakeem

본 논문은 잠재 변수 모델을 학습하기 위한 새로운 온라인 텐서 분해 방법을 제안한다. 기존의 텐서 기반 학습은 순간 텐서를 직접 구성해야 하는데, 이는 메모리와 계산량이 O(n³)으로 급격히 증가해 대규모 데이터에 적용하기 어렵다. 저자들은 이러한 문제를 해결하기 위해 순간 텐서의 다중선형 연산을 확률적 경사 하강법(SGD) 형태로 변환하고, 텐서를 명시적으로 형성하지 않는 “암묵적 텐서” 접근법을 도입한다.

먼저, 1차와 2차 순간 M₁, M₂를 이용해 데이터를 whitening하고 차원을 k(잠재 토픽/커뮤니티 수)로 축소한다. 이 과정에서 선형 대수 연산은 GPU에서는 cuBLAS와 맞춤형 CUDA 커널, CPU에서는 CSR 기반 희소 행렬 연산으로 최적화된다. 이후 3차 순간 M₃에 대해 SGD 업데이트를 수행한다. 업데이트는 각 샘플(그래프의 3‑star 서브그래프 혹은 문서의 단어 삼중항)에서 얻은 부분 텐서와 현재 추정값의 내적을 이용해 gradient를 계산하고, 학습률 스케줄링과 미니배치를 적용해 수렴을 가속한다.

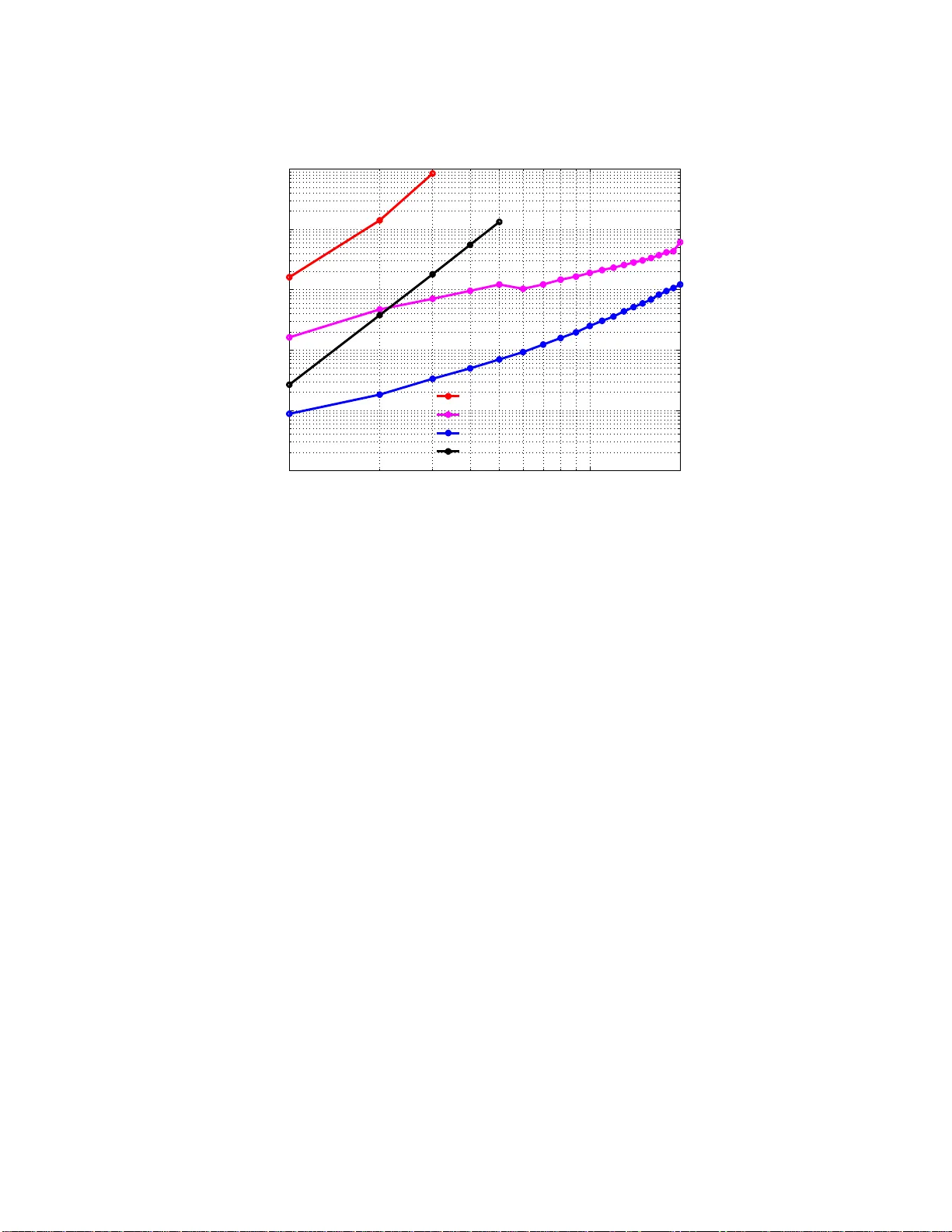

두 가지 주요 응용 분야가 제시된다. 첫 번째는 혼합 멤버십 블록 모델(MMSB) 기반의 커뮤니티 탐지이다. 그래프의 인접 행렬을 이용해 3‑star 카운트를 순간 텐서로 해석하고, 위의 온라인 텐서 분해 과정을 통해 각 노드의 커뮤니티 멤버십 벡터 Π와 커뮤니티 간 연결 행렬 P를 복원한다. 실험에서는 Facebook, Yelp, DBLP 데이터셋을 사용했으며, 특히 DBLP(노드 1백만, 엣지 1.6천만, 커뮤니티 250개)에서 2분 내에 10% 오류율을 달성했다. 기존 stochastic variational inference 대비 수천 배 빠른 실행 속도와, p‑값 기반 오류 측정 및 false discovery rate를 활용한 새로운 평가 지표를 제시해 모델 선택의 객관성을 높였다.

두 번째는 LDA 기반 토픽 모델링이다. 문서-단어 행렬에서 단어 삼중항 공분산을 순간 텐서로 보고, 동일한 온라인 텐서 분해 파이프라인을 적용한다. 뉴욕 타임스 데이터(단어 10⁵, 문서 3·10⁵)에서 약 2분 만에 의미 있는 토픽을 추출했으며, “bridging” 단어를 통해 토픽 간 연결 구조를 시각화하였다.

구현 측면에서 저자들은 GPU와 CPU 두 플랫폼을 모두 지원한다. GPU 구현은 SIMD 아키텍처의 병렬성을 최대한 활용해 메모리 전송을 최소화하고, 행렬‑벡터 연산을 고속화한다. CPU 구현은 대규모 희소 그래프를 다루기 위해 CSR 포맷과 멀티스레드 BLAS를 사용한다. 두 구현 모두 텐서를 명시적으로 저장하지 않으며, 대신 이웃 벡터를 직접 조작해 필요한 순간 텐서 연산을 수행한다.

관련 연구와 비교했을 때, 기존 방법은 EM이나 변분 베이즈와 같이 텐서 형성을 전제로 하거나, 순차적인 파워 반복을 사용해 확장성이 제한적이었다. 반면 본 논문은 (1) stochastic gradient 기반으로 샘플링 비율을 조절해 정확도와 속도 사이의 trade‑off를 제공하고, (2) 차원 축소와 whitening을 통해 수백 차원의 텐서를 효율적으로 다루며, (3) GPU·CPU 이중 구현으로 메모리 한계를 극복한다는 점에서 차별화된다.

한계점으로는 SGD의 수렴 이론이 텐서 분해 특성에 맞춰 완전히 증명되지 않았으며, 학습률·배치 크기·정규화 파라미터 등 하이퍼파라미터 튜닝이 성능에 큰 영향을 미친다. 또한, 매우 높은 차원(수천 이상)에서는 whitening 단계 자체가 병목이 될 수 있다. 향후 연구에서는 이론적 수렴 보장 강화와 자동 하이퍼파라미터 선택 메커니즘을 도입하고, 분산 클러스터 환경에서의 확장성을 검증할 필요가 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기