변분 정보 최대화로 구현하는 내재 동기 강화 학습

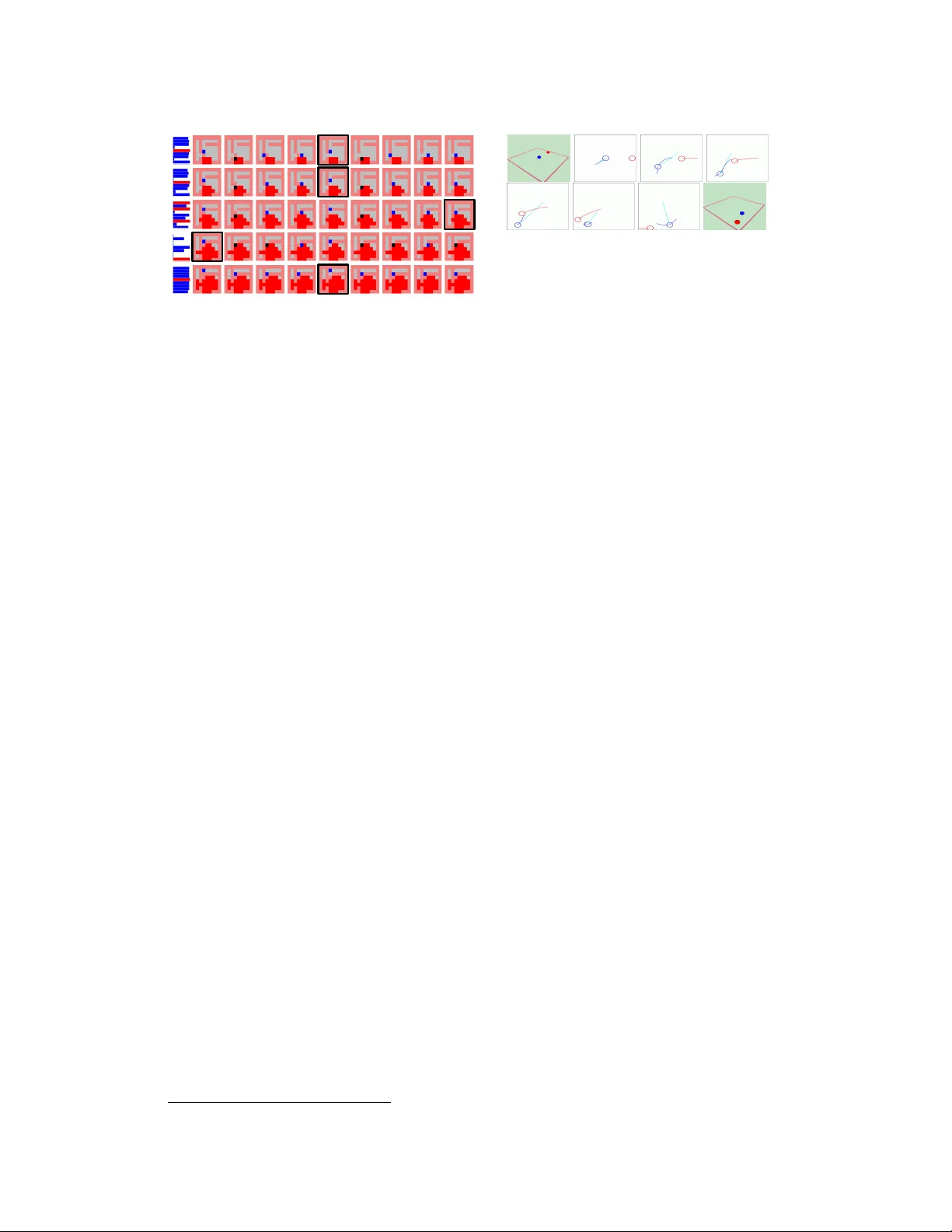

본 논문은 변분 추론과 심층 신경망을 결합해 상호 정보량을 효율적으로 추정·최대화하는 알고리즘을 제안한다. 특히, 상태‑행동 시퀀스의 상호 정보를 내재 보상인 ‘임파워먼트’로 정의하고, 픽셀 입력에서 직접 행동을 선택하도록 학습한다. 제안 방법은 기존의 지수적 복잡도를 갖는 Blahut‑Arimoto 방식보다 훨씬 확장성이 크며, 연속·이산 환경 모두에 적용 가능하다. 실험을 통해 정확한 계산과 거의 동일한 행동 패턴을 얻으며, 고차원 시각 입…

저자: Shakir Mohamed, Danilo Jimenez Rezende

본 논문은 상호 정보량(Mutual Information, MI)이 다양한 머신러닝 분야에서 핵심 역할을 수행하지만, 기존의 MI 최적화 방법인 Blahut‑Arimoto 알고리즘은 지수적 복잡도로 인해 실용적인 대규모 문제에 적용하기 어렵다는 점을 출발점으로 한다. 저자들은 변분 추론과 딥러닝을 결합해 MI를 효율적으로 추정·최대화하는 새로운 프레임워크를 제시한다.

1. **문제 설정 및 배경**

- MI는 두 확률 변수 x와 y 사이의 의존성을 측정하는 기본량이며, 강화학습(RL)에서는 현재 상태 s와 미래 상태 s′ 사이의 행동 시퀀스 a에 대한 의존성을 측정하는 데 사용된다.

- 내재 동기 강화학습에서는 외부 보상이 희박하거나 존재하지 않을 때, 에이전트가 스스로 탐색 동기를 갖도록 하는 ‘임파워먼트(empowerment)’라는 개념이 도입된다. 임파워먼트는 상태 s에서 K‑step 행동 시퀀스 a가 최종 상태 s′에 전달하는 정보량, 즉 채널 용량을 최대화하는 문제로 정의된다.

2. **변분 정보 하한 도출**

- MI를 H(a|s) – H(a|s′,s) 형태로 표현하고, 조건부 엔트로피 H(a|s′,s)를 변분 분포 q(a|s′,s)와의 KL 발산을 이용해 상한을 만든다.

- 이 과정에서 실제 전이 확률 p(s′|a,s)는 기대값 안에 선형으로 들어가므로, 샘플링을 통해 직접 추정 가능하고, p 자체를 명시적으로 계산할 필요가 없어진다.

3. **변분 정보 최대화 알고리즘**

- 목표는 변분 하한 I_{ω,q}(s) 를 ω(a|s)와 q(a|s′,s) 두 파라미터에 대해 교대로 최적화하는 것이다.

- q는 디코더 역할을 하며, (s, s′) → a 를 학습하는 자동 회귀 모델로 구현한다. 각 단계의 행동은 카테고리컬 분포이며, 파라미터는 두 층의 ReLU 네트워크로 정의한다.

- ω는 소스(탐색) 분포이며, 엔트로피 제약 H(a|s) ≤ ε 를 포함한 라그랑주 최적화 결과, ω∗(a|s) ∝ exp(β · E_{p}

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기