깊이의 힘: 얕은 네트워크를 넘어서는 표현력

초록

이 논문은 입력 구간을 교대로 라벨링한 2^k개의 점 집합을 대상으로, 깊이 2k인 얇은(ReLU) 네트워크는 정확히 0 오류를 달성하지만, 층당 노드 수가 제한된 얕은 네트워크는 최소 1/6 이상의 오류를 피할 수 없음을 보인다. 또한 2개의 노드와 2개의 층을 가진 기본 블록을 k번 반복하는 순환 네트워크도 동일한 성능을 가진다.

상세 분석

핵심 결과는 두 정리에 있다. 정리 1.1은 “n‑ap”(n‑alternating‑point) 문제를 정의하고, 깊이 2k, 각 층에 2개의 노드만 있는 네트워크 N(σ_r; 2, 2k)가 모든 라벨을 정확히 맞출 수 있음을 보인다. 반면, 층당 노드 수 m이 ≤ 2(k‑3)/l‑1 로 제한된 일반적인 얕은 네트워크 N(σ_r; m, l)는 최소 오류 1/6을 넘을 수 없다는 하한을 제시한다. 여기서 σ_r은 ReLU이며, “sawtooth” 함수 개념을 도입해 복합 함수의 구간 분할 수가 어떻게 증가하는지를 정량화한다. Lemma 2.1·2.3을 통해, t‑sawtooth 비선형을 사용한 경우 l 층을 거치면 (tm)^l‑sawtooth 함수가 되며, 이러한 함수는 1/2을 넘는 교차점이 제한적이므로 교대로 라벨링된 점들을 충분히 구분하지 못한다는 것이 하한 증명의 핵심이다.

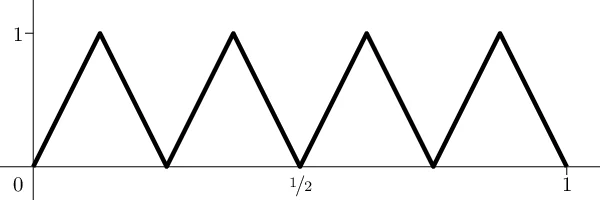

상한 부분에서는 “mirror map” f_m(x)=2x (0≤x≤½) 혹은 2(1‑x) (½<x≤1) 를 두 노드와 두 층만으로 구현한다. 이 함수를 k번 합성하면 f_m^{∘k}가 n‑ap의 각 점을 정확히 원하는 라벨로 매핑한다. 시각적으로는 그래프를 ½ 축을 기준으로 뒤집고 스케일링하는 연산이 반복되어, 결국 2^k개의 진동을 만들며 깊이의 효율성을 보여준다. 또한 같은 구조를 순환 네트워크 R(σ_r; 2, 2; k) 로 표현하면, 파라미터 수는 O(k) 수준에 머무른다.

정리 1.2는 σ가 t‑sawtooth일 때 일반적인 얕은 네트워크의 오류 하한을 (n‑4(t m)^l)/(3n) 로 구체화한다. 이는 결정 스텀(t=2)이나 작은 깊이의 트리와 같은 실제 모델에도 적용 가능함을 의미한다. 논문은 이러한 결과를 기존 문헌—Cybenko의 보편 근사 정리, Håstad의 깊이 제한 하드웨어 복잡도, Kolmogorov의 3‑층 표현 정리—과 비교하며, 깊이가 곧 표현력의 지수적 향상을 제공한다는 점을 강조한다. 마지막으로 VC 차원과 Rademacher 복잡도 관점에서, 깊은 네트워크가 동일 파라미터 수에서 더 작은 일반화 오류 상한을 가질 수 있음을 시사한다. 전체적으로, 이 논문은 매우 단순한 구성(두 노드, 두 층)만으로도 깊이가 얼마나 강력한지를 수학적으로 명확히 증명한다.

댓글 및 학술 토론

Loading comments...

의견 남기기