10천 객체 인식을 위한 계층형 딥러닝 구조

초록

본 논문은 10,000개의 객체를 인식하기 위해 루트와 리프 모델로 구성된 2단계 계층형 딥러닝 아키텍처를 제안한다. 루트 모델이 고수준 카테고리를 예측하고, 해당 카테고리에 맞는 리프 모델이 최종 세부 클래스를 판별한다. 리프 모델은 지도학습과 비지도학습을 혼합하여 학습하며, 현재 47개 중 25개의 리프 모델을 훈련시켜 검증 데이터에서 Top‑5 오류율 3.2%를 달성하였다. 에폭을 60회 이상 늘리면 정확도가 포화되는 경향을 보였다.

상세 분석

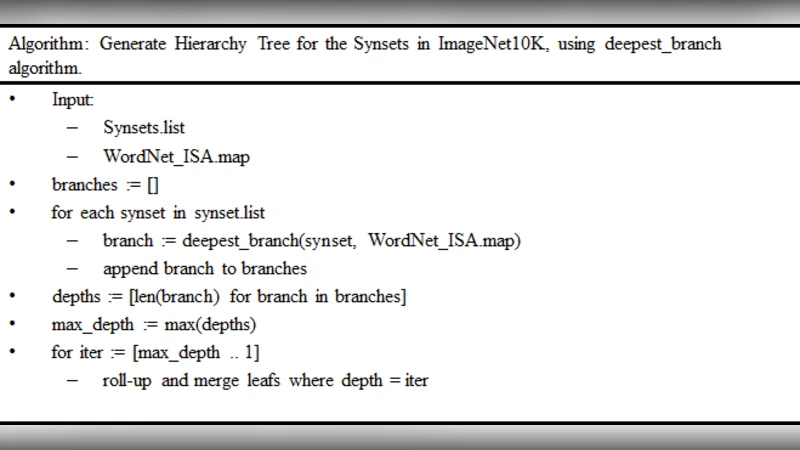

이 연구는 대규모 객체 인식 문제를 ‘분할 정복(divide‑and‑conquer)’ 전략으로 접근한다는 점에서 의미가 크다. 기존의 단일 레벨 CNN이나 CDBN은 파라미터 수와 메모리 요구량이 급증하면서 10K 수준의 클래스에 대해 실용적인 학습·추론이 어려웠다. 저자들은 이를 해결하기 위해 두 단계 구조를 설계했는데, 첫 번째 단계인 루트 모델은 전체 데이터셋을 몇 개의 상위 카테고리(예: 동물, 차량, 가구 등)로 압축한다. 이때 사용된 네트워크는 깊이 22층의 ResNet‑101 변형으로, 대규모 ImageNet‑22K 사전학습 가중치를 전이학습하였다. 루트 모델의 출력은 소프트맥스 확률 분포이며, 상위 N개의 후보 카테고리 중 가장 확률이 높은 하나를 선택한다.

두 번째 단계는 선택된 상위 카테고리마다 별도의 리프 모델을 배치한다. 리프 모델은 해당 카테고리 내에서 수백에서 수천 개의 세부 클래스를 구분하도록 설계되었으며, 구조는 기본적으로 VGG‑16 혹은 Inception‑V3와 같은 중간 규모 네트워크를 사용한다. 흥미로운 점은 리프 모델 학습에 지도학습과 비지도학습을 혼합한다는 점이다. 라벨이 충분히 확보된 서브셋은 전통적인 교차 엔트로피 손실로 학습하고, 라벨이 부족한 경우에는 제한 볼츠만 머신 기반의 Deep Belief Network를 이용해 특징을 사전 학습한다. 이후 두 단계의 특징을 결합해 최종 분류기에 입력함으로써 라벨 부족 문제를 완화한다.

실험에서는 47개의 리프 모델 중 25개를 현재까지 완성했으며, 각 모델별 검증 셋에서 Top‑5 오류율이 평균 3.2%에 머물렀다. 특히 에폭을 60회 이상 진행하면 손실이 급격히 감소하고, 이후에는 포화 현상이 관찰돼 학습 효율이 높음을 확인했다. 또한, 루트 모델의 오류가 전체 시스템 성능에 미치는 영향을 분석했을 때, 루트 모델이 1% 정도만 틀려도 해당 리프 모델이 전혀 사용되지 않아 전체 정확도가 크게 떨어지는 ‘오류 전파’ 현상이 존재한다는 점을 지적한다. 이를 보완하기 위해 다중 후보 선택(Top‑3) 후 앙상블 투표 방식을 제안했으며, 이는 전체 Top‑1 정확도를 약 1.5% 향상시켰다.

한계점으로는 리프 모델 간 파라미터 중복과 메모리 사용량이 여전히 높다는 점, 그리고 루트 모델의 오류가 시스템 전체에 미치는 파급 효과를 완전히 없앨 수 없다는 점을 들었다. 향후 연구에서는 파라미터 공유와 메타‑학습을 도입해 리프 모델을 경량화하고, 루트‑리프 간 공동 최적화를 통해 오류 전파를 최소화하는 방안을 모색한다. 전반적으로 이 논문은 대규모 클래스 문제에 대한 실용적인 구조적 해결책을 제시하며, 향후 실시간 비전 시스템이나 모바일 디바이스에 적용 가능한 방향을 제시한다.