소프트 딥 볼츠만 머신

초록

본 논문은 기존 깊은 볼츠만 머신(DBM)의 표현력 한계를 이론적으로 분석하고, 모든 층 쌍을 연결하는 소프트 딥 볼츠만 머신(sDBM)을 제안한다. sDBM은 자유에너지의 하드‑민 근사에서 선형 구역 수가 지수적으로 증가함을 보이며, 실험적으로 MNIST와 Caltech‑101 실루엣 데이터에서 기존 DBM 및 최신 생성 모델을 능가한다.

상세 분석

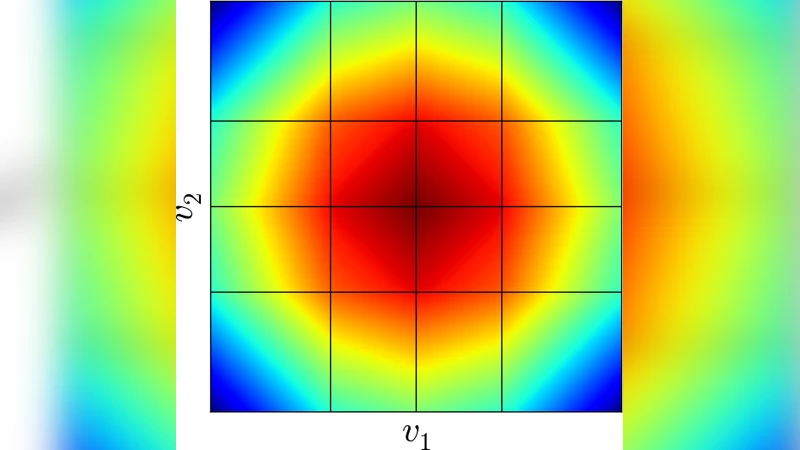

논문은 먼저 분산 표현의 효율성을 정량화하기 위해 자유에너지 F(v)의 하드‑민 근사 ˆF(v)=min_H E(v,H) 를 도입한다. ˆF는 가시층에 대한 다변량 선형 함수들의 최소값으로, 파편화된 선형 구역(linear region)들의 개수가 모델이 관리할 수 있는 서브‑공간의 수와 직접적으로 대응한다. 이 관점에서 “효과적인 혼합(effective mixtures)”의 수를 ˆF의 선형 구역 개수로 정의하고, 이는 이론적 최대값이 2^{N_h} (숨은 유닛 전체 조합)임을 보인다.

RBM의 경우 기존 연구와 유사하게 2‑계층 ReLU 네트워크와 동등하게 해석할 수 있으며, 선형 구역 수는 Θ(N_1^{N_0}) 로 제한된다. 즉, 숨은 유닛 수가 가시 유닛보다 많아도 전체 조합을 모두 활용하지 못한다.

DBM에 대해서는 깊이가 늘어나도 첫 번째 숨은 층의 유닛 수 N_1에만 의존하는 상한 2^{N_1} 를 증명한다. 이는 상위 층이 하위 층에 조건부 독립성을 유지하기 때문에, 각 숨은 구성에 대한 에너지 기울기가 동일하게 되며, 최소 에너지만이 자유에너지에 기여하게 되는 구조적 제한이다. 결과적으로 DBM은 깊이와 파라미터를 늘려도 분산 표현의 효율성을 크게 향상시키지 못한다.

이러한 한계를 극복하기 위해 제안된 sDBM은 모든 층 쌍을 연결하되, 거리 d에 따라 연결 강도를 2^{-d} 로 감소시키는 “소프트‑딥” 연결 방식을 채택한다. 알고리즘 1은 재귀적으로 가중치를 설정해 각 숨은 유닛이 서로 다른 기울기의 선형 함수를 생성하도록 만든다. 이때 각 숨은 유닛은 가시층에 대해 서로 다른 기울기를 제공하므로, 2^{L} 개의 선형 구역이 생성되고, 이는 전체 숨은 유닛 수 N_h = L·M 에 대해 2^{N_h} 에 도달한다. 즉, sDBM은 이론적으로 일반 BM이 가질 수 있는 최대 혼합 수와 동등한 표현력을 갖는다.

실험에서는 사전 학습 없이 sDBM을 학습시켰으며, 이 모델은 바이너리 MNIST와 Caltech‑101 실루엣 데이터에서 로그우도와 샘플 품질 측면에서 기존 DBM, 딥 신경망 기반 생성 모델(VAE, GAN 등)을 능가했다. 또한, sDBM은 블록 Gibbs 샘플링을 그대로 적용할 수 있어 학습 및 샘플링 효율성도 유지한다.

핵심 인사이트는 (1) 자유에너지의 선형 구역 수가 분산 표현 효율성을 측정하는 실용적인 지표가 될 수 있음, (2) 전통적인 DBM 구조는 층 간 조건부 독립성 때문에 이 지표에서 급격한 성장 효과를 보이지 않음, (3) 모든 층을 부드럽게 연결하는 소프트‑딥 구조가 깊은 BM에게도 얕은 모델과 동등하거나 그 이상의 표현력을 제공한다는 점이다. 이러한 이론적·실험적 결과는 깊은 생성 모델 설계 시 연결 패턴 자체가 표현력에 미치는 영향을 재고하게 만든다.

댓글 및 학술 토론

Loading comments...

의견 남기기