정책 경사와 일관된 위험 측정의 통합 접근법

본 논문은 재무·운영 연구에서 널리 쓰이는 일관된(coherent) 위험 측정 전체에 대해 정책 경사(policy gradient) 방법을 확장한다. 정적 위험과 시간 일관성을 갖는 동적 위험 두 경우에 대해 샘플링 기반 추정과 convex programming, 그리고 actor‑critic 구조를 이용한 알고리즘을 제시하며, 기존의 분산·CVaR 등 특수 위험에 대한 결과를 일반화한다.

저자: Aviv Tamar, Yinlam Chow, Mohammad Ghavamzadeh

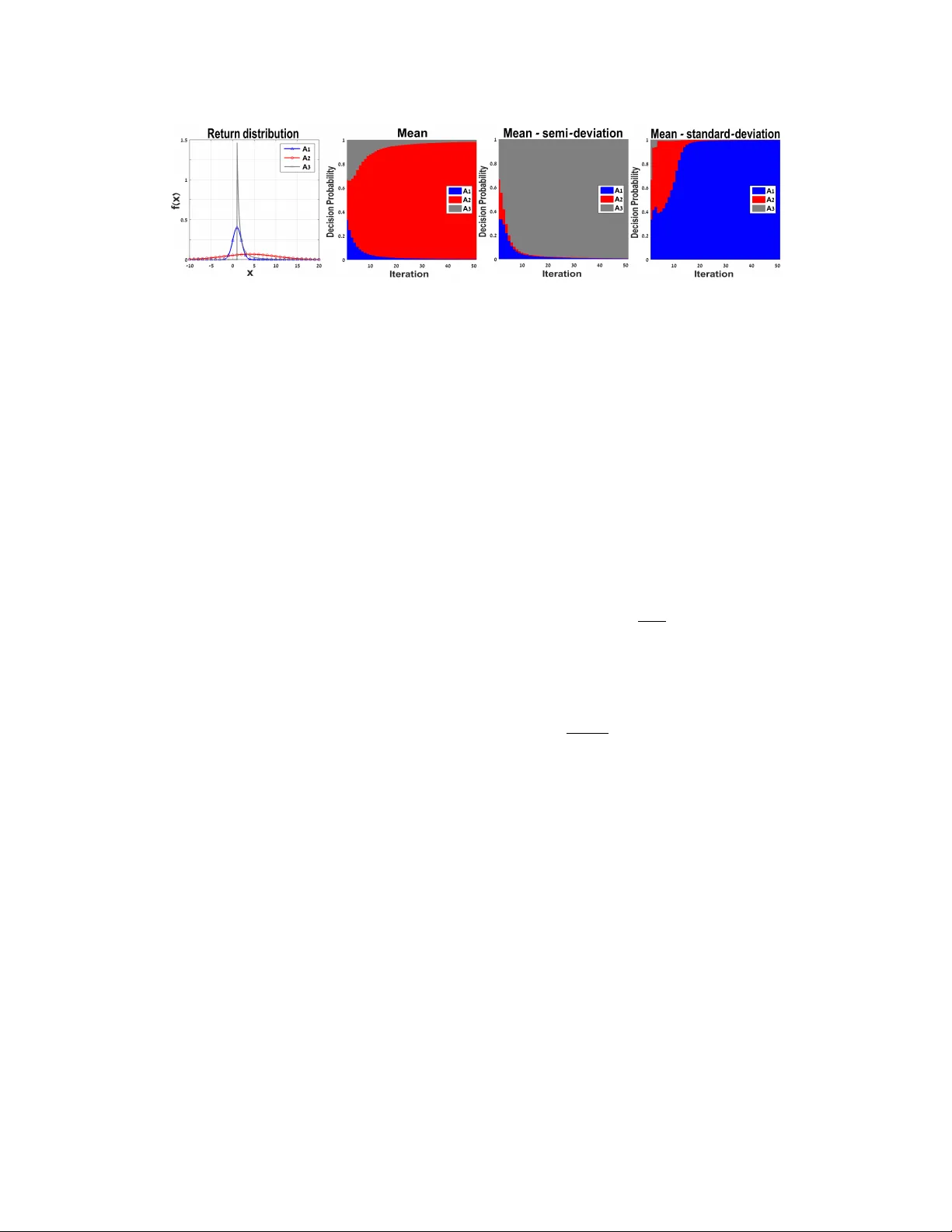

본 논문은 강화학습(RL)에서 위험 민감 최적화를 위해 정책 경사(policy gradient) 방법을 일관된(coherent) 위험 측정 전체에 적용하는 통합 프레임워크를 제시한다. 일관된 위험은 재무·운영 연구에서 널리 쓰이며, 볼록성, 단조성, 평행이동, 양의 동질성이라는 네 가지 공리를 만족한다. 이러한 위험은 위험 포락(envelope)이라 불리는 확률밀도 집합 U에 대한 최악‑사례 기대값으로 표현될 수 있다는 정리(2.1)를 기반으로 한다.

논문은 두 종류의 위험 최적화 문제를 다룬다. 첫 번째는 정적 위험 문제(SRP)로, 정책 파라미터 θ에 의해 결정되는 누적 비용 Z에 대해 ρ(Z)를 최소화한다. 여기서 위험 포락 U는 θ에 따라 변하므로, 위험 ρ(Z)는 θ에 대한 convex 최적화 문제의 최적값이 된다. 저자들은 라그랑주 승수와 likelihood‑ratio 기법을 결합해 정리 4.2에서 ∇θρ(Z)의 명시적 식을 도출한다. 이 식은 ξ∗θ(ω)·∇θlog Pθ(ω)·(Z(ω)−λ∗) 의 기대값과 제약식의 파라미터 의존성을 보정하는 항들로 구성된다. 이를 통해 CVaR, 평균‑반편차 등 기존 위험에 대한 특수 결과를 일반화한다. 특히 CVaR에 대해서는 이산·연속 분포 모두에 적용 가능한 간단한 형태 E

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기