PCA로 상태공간 효율적 압축과 학습 가속

초록

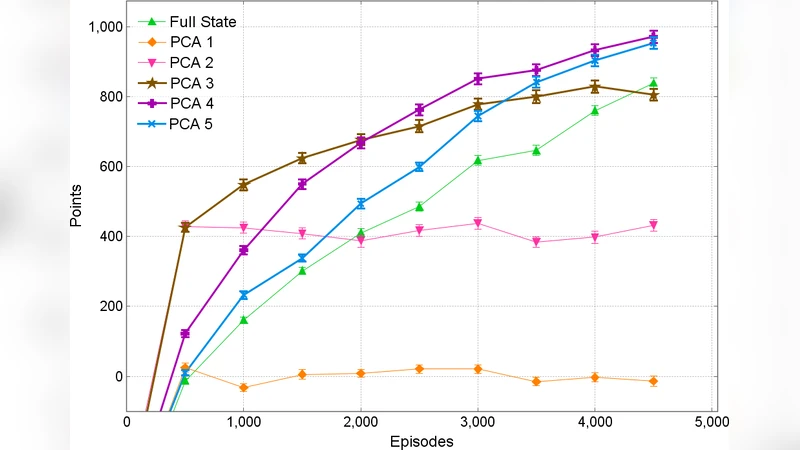

본 논문은 강화학습에서 고차원 상태공간을 주성분 분석(PCA)으로 저차원 매니폴드에 투사하여 학습 속도를 크게 향상시키는 방법을 제안한다. 마리오 벤치마크 환경에서 9차원 원본 상태를 4차원으로 축소했을 때, 수렴 속도는 크게 빨라지지만 최종 정책 성능은 약간 감소한다는 수렴‑성능 트레이드오프를 실험적으로 확인하였다.

상세 분석

이 연구는 강화학습(RL)에서 흔히 마주치는 ‘차원의 저주’를 완화하기 위한 실용적인 차원 축소 전략을 제시한다. 핵심 아이디어는 사전에 수집한 시연 데이터(데모 트래젝터리)를 이용해 상태공간의 공분산 행렬을 계산하고, 그 고유벡터를 정렬해 가장 큰 고유값에 대응하는 몇 개의 주성분만 선택하는 것이다. 이렇게 얻은 변환 행렬 Wₖ는 매 학습 단계마다 현재 상태 x를 Wₖᵀ x = xₖ 로 투사해 저차원 표현을 만든다. 저차원 공간에서 Q(λ)‑학습을 수행하고, 행동을 실행한 뒤 시뮬레이터가 반환한 새로운 원시 상태를 다시 동일 변환으로 투사한다. 이 과정은 단순한 행렬 곱셈이므로 연산 오버헤드가 거의 없으며, 기존의 탭ular Q‑learning과 동일한 업데이트 규칙을 적용할 수 있다.

실험에서는 마리오 AI 벤치마크를 사용했는데, 원본 상태는 점프 가능 여부, 지면 접촉, 화염 발사 가능, 8방향 이동, 근거리·중거리 적 위치, 전방 장애물, 21×21 격자 내 가장 가까운 적 좌표 등 총 9개의 변수(각 변수는 여러 비트로 인코딩)로 구성된다. 이론적으로 가능한 상태 조합은 3.24×10¹⁰개에 달하지만 실제 방문 빈도는 극히 제한적이다. PCA 분석 결과, 첫 번째·두 번째 주성분은 ‘점프’, ‘지면’, ‘현재 방향’ 등 빈번히 변하는 기본 행동을 강하게 반영하고, 후속 주성분은 적의 근접 여부와 같은 드물게 등장하는 상황을 포착한다. 따라서 저차원 매니폴드에 기본 행동을 보존하고, 복잡한 상황은 고차원에서만 표현되는 구조적 특성을 확인할 수 있다.

차원 수를 달리하면서 실험한 결과, 2차원 이하에서는 정책이 거의 무작위에 가까워 수렴이 매우 느리거나 실패한다. 반면 4차원 이상에서는 초기 학습 속도가 급격히 증가해 5000 에피소드 이내에 완전 학습보다 높은 평균 점수를 달성한다. 다만, 무한히 학습을 지속하면 9차원 전체 공간에서 학습한 경우가 최종 성능에서 약간 우위에 있다. 이는 저차원 투사 과정에서 낮은 분산을 가진 정보가 손실되어 최적 정책에 도달하지 못한다는 전형적인 수렴‑성능 트레이드오프를 보여준다.

논문은 또한 현재 접근법의 한계점을 짚는다. 모든 상태가 학습에 동일하게 중요하다고 가정하지만, 실제로는 고분산이지만 학습에 크게 기여하지 않는 상태가 존재할 수 있다. 또한 저차원에서 수렴한 뒤 학습을 중단하기 때문에, 장기적으로는 고차원으로 전이했을 때 얻을 수 있는 미세 조정 기회를 놓친다. 이를 보완하기 위해 향후 연구에서는 단계적 차원 증가(예: 4→5→…→9)와 혼합 해상도 함수 근사 기법을 결합한 ‘점진적 차원 확장’ 전략을 제안한다. 이러한 방법은 초기 빠른 수렴을 유지하면서도 최종 정책의 품질을 고차원 수준으로 끌어올릴 수 있을 것으로 기대된다.

전반적으로 이 논문은 PCA 기반 차원 축소가 강화학습의 초기 수렴을 크게 가속화한다는 실증적 증거를 제공하며, 저차원 매니폴드 선택 시 어떤 상태 변수들이 핵심적인지에 대한 직관적인 해석을 가능하게 한다. 이는 로봇 제어, 게임 AI 등 고차원 센서 데이터를 다루는 다양한 분야에 적용 가능성이 높다.

댓글 및 학술 토론

Loading comments...

의견 남기기