확률 시뮬레이션의 에너지 한계와 정보 복잡도

초록

이 논문은 물리 시스템을 확률적 계산으로 시뮬레이션할 때 필요한 최소 에너지 비용을 정보 이론적으로 정량화한다. 통계적 복잡도 Cµ와 예측 정보 E의 차이가 바로 정보 소거량이며, 이는 Landauer 원리에 의해 에너지 손실로 연결된다. 저자들은 ε‑기계(ε‑machine)를 이용해 이 차이를 수식적으로 도출하고, Szilard 엔진의 사고 실험을 통해 물리적 구현을 제시한다. 결과적으로 시뮬레이션 비용은 Cµ − E 만큼의 열역학적 비용이 최소가 됨을 보인다.

상세 분석

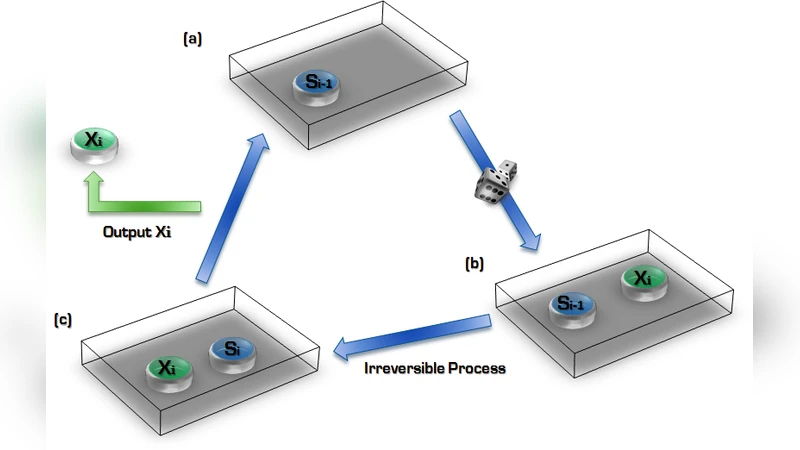

논문은 먼저 확률 과정의 최적 표현으로 ε‑기계(ε‑machine)를 도입한다. ε‑기계는 과거 관측열을 원인 상태(causal state) S 로 압축하고, 이 상태를 통해 미래 심볼 X 를 확률적으로 생성한다. 통계적 복잡도 Cµ는 상태 분포의 Shannon 엔트로피 H(S) 로 정의되며, 이는 미래를 예측하기 위해 저장해야 하는 최소 비트 수를 의미한다. 반면 예측 정보 E는 과거와 미래 사이의 상호 정보 I( past ; future ) 로, 실제로 미래에 전달되는 정보량을 나타낸다. 두 양은 일반적으로 Cµ ≥ E 로, 차이는 Cµ − E = H(S_{i‑1} | X_i S_i) 로 표현된다. 이 조건식은 현재 상태와 출력 심볼만으로 이전 상태를 복원할 수 없는 경우, 즉 논리적으로 비가역적인 연산이 발생함을 의미한다.

Landauer 원리에 따르면 비가역적인 연산, 즉 정보 소거는 최소 kT ln 2·(소거된 비트 수) 만큼의 열을 발생시킨다. 저자들은 h_erase = H(S_{i‑1} | X_i S_i) 를 한 연산 단계당 소거되는 평균 비트 수로 정의하고, 이를 ε‑기계의 엔트로피 흐름과 연결한다. 구체적으로 한 사이클에서 (1) 상태 S_{i‑1} → S_i 로 전이하면서 엔트로피 h = H(X_i | S_{i‑1}) 가 시스템 내부에 증가하고, (2) 이전 상태 정보가 소거되면서 h_erase 만큼 감소하며, (3) 출력 심볼이 외부로 방출되어 h_R = H(X_i | S_i) 만큼 추가 감소한다. 엔트로피 보존식 h − h_erase − h_R = 0 가 성립하고, 이를 무한 문자열 한계(N→∞)에 적용하면 H_erase + E − Cµ = 0, 즉 Cµ − E = H_erase 가 도출된다.

이론적 결과를 물리적으로 구현하기 위해 저자들은 Szilard 엔진을 확장한 사고 실험을 제시한다. 엔진은 온도 T_H 의 열원에 연결된 메모리와, 온도 T_C 로 리셋되는 과정으로 구성된다. 예측 정보를 E 비트만큼 얻기 위해서는 최소 Cµ 비트의 메모리를 사용해야 하며, 메모리 리셋 과정에서 Cµ·kT_C ln 2 만큼의 에너지가 소모된다. 반면 얻은 정보 E 로부터 kT_H ln 2·E 만큼의 작업을 추출할 수 있다. 따라서 전체 효율은 η = 1 − (T_C/T_H)·(Cµ/E) 로, 정보‑이론적 효율 ι = E/Cµ 와 열역학적 효율 η 를 곱한 형태가 된다.

핵심 통찰은 두 가지이다. 첫째, ε‑기계가 제공하는 Cµ와 실제 전달되는 E 사이의 차이는 반드시 정보 소거에 해당하며, 이는 물리적으로 최소 열 손실을 초래한다는 점이다. 둘째, 이 차이를 최소화하는 최적 시뮬레이터는 논리적으로 가역적인 ε‑기계이며, 양자 시뮬레이터가 클래식 ε‑기계보다 더 적은 Cµ 를 가질 경우 에너지 비용을 더욱 낮출 수 있음을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기