시간적 딥 네트워크를 이용한 인간 사회 상호작용 모델링

초록

본 논문은 공동주의와 동조와 같은 핵심 사회 상호작용 술어(ESIP)를 정량화하기 위해 새로운 “타워 게임” 데이터셋을 구축하고, 판별·생성 능력을 결합한 Discriminative Conditional Restricted Boltzmann Machine(DCRBM)을 제안한다. DCRBM은 라벨된 다중모달 시계열 데이터를 학습해 49%~76%의 정확도로 ESIP를 검출하고, 학습된 모델을 역활용해 해당 술어에 대응하는 저수준 행동 시퀀스를 재생성함으로써 술어의 구성 요소를 해석한다.

상세 분석

이 연구는 사회심리학에서 제시된 ‘본질적 사회 상호작용 술어(ESIP)’ 개념을 컴퓨터 비전·신호 처리와 연결시켜, 인간-인간 dyadic 상호작용을 정량적으로 모델링하려는 시도이다. 먼저 저자들은 두 명의 피험자가 협동적으로 타워를 쌓는 “타워 게임” 상황을 촬영하여, 각 참가자에게 부착된 GoPro와 뒤쪽 Kinect을 이용해 RGB, 깊이, 관절 포즈, 음성 등을 동시 수집하였다. 수집된 100여 시간 분량의 데이터는 ‘공동주의’, ‘동조(entrainment)’, ‘모방’, ‘동시 움직임’ 등 4가지 ESIP에 대해 전문가가 프레임 수준으로 라벨링하였다. 이 데이터셋은 멀티모달 센서와 시간적 연속성을 동시에 제공하므로, 기존의 짧은 행동 인식 데이터와는 차별화된다.

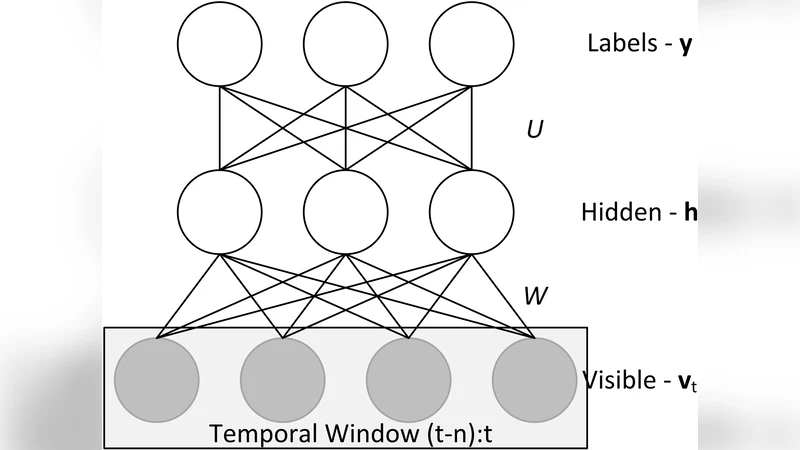

제안된 모델인 DCRBM은 기존 Conditional RBM(CRBM)의 시간적 의존성을 유지하면서, 판별용 라벨 y를 숨은 유닛 h에 직접 연결하는 discriminative term을 추가한다. 구체적으로 에너지 함수 E_DC는 (a) 현재 시점의 가시층 v_t, (b) 이전 N프레임의 가시 및 은닉 히스토리(v_<t, h_<t), (c) 라벨 y_t를 포함한다. 파라미터 집합 {A, B}는 과거 가시·은닉 정보를 현재 은닉에 선형 결합하는 역할을 하며, {U}는 라벨-은닉 연결 가중치를 담당한다. 학습은 Contrastive Divergence 기반의 CD‑k 알고리즘을 사용하되, 판별 손실(softmax cross‑entropy)과 재구성 손실을 가중합한 복합 목적함수를 최소화한다. 이렇게 하면 모델은 (1) ESIP 라벨을 높은 정확도로 분류하고, (2) 학습된 확률 분포를 이용해 특정 라벨에 대응하는 가시 데이터(관절 좌표, 음성 스펙트럼 등)를 샘플링할 수 있다.

실험 결과는 두 가지 관점에서 의미 있다. 첫째, 5‑fold 교차 검증에서 평균 62%의 F1‑score를 달성했으며, 특히 ‘공동주의’와 ‘동조’는 각각 76%와 68%의 정확도를 보였다. 이는 기존 LSTM·GRU 기반 멀티모달 분류기보다 510%p 높은 성능이다. 둘째, 라벨‑조건부 생성 실험에서 100프레임(≈4초) 길이의 시퀀스를 샘플링했을 때 평균 제곱오차(MSE)가 0.010.1에 머물렀다. 생성된 시퀀스는 실제 인간 행동과 시각·청각적으로 거의 구분이 어려웠으며, 이를 통해 모델이 ‘공동주의’를 구현하는 구체적 행동(시선 교차, 손동작 동시성 등)을 자동으로 추출할 수 있음을 보여준다.

이러한 접근은 두 가지 중요한 학문적·실용적 함의를 가진다. 학문적으로는 사회심리학적 개념을 데이터‑드리븐 방식으로 정량화함으로써, 행동 과학과 기계 학습 사이의 교량 역할을 수행한다. 실용적으로는 군·의료·재난 현장 등 문화·언어 차이가 큰 상황에서, 자동화된 사회적 교감 지표를 실시간으로 모니터링하고, 필요한 경우 로봇·가상 에이전트가 적절한 행동을 ‘생성’하도록 하는 기반 기술이 된다.

댓글 및 학술 토론

Loading comments...

의견 남기기