GPU 기반 대규모 병렬 레플리카 교환 시뮬레이션으로 폴리머 전이 탐색

초록

본 논문은 GPU 멀티스레딩을 활용해 비격자(bead‑spring) 폴리머 모델의 레플리카 교환(Parallel Tempering) 몬테카를로 시뮬레이션을 구현하고, CPU 대비 수십 배 이상의 속도 향상을 입증한다.

상세 분석

이 연구는 현대 그래픽 카드에 내장된 수천 개 코어를 이용해 레플리카 교환 몬테카를로(Replica‑Exchange Monte Carlo, REMC) 알고리즘을 GPU로 이식함으로써, 대규모 폴리머 시뮬레이션의 효율성을 크게 높였다. 먼저 저자는 GPU 아키텍처와 CUDA 프로그래밍 모델을 상세히 소개하고, 스트리밍 멀티프로세서(SM), 워프(warp), 전역·공유·상수 메모리의 특성을 분석한다. 특히 전역 메모리의 높은 레이턴시를 최소화하기 위해 복제된 폴리머 데이터를 각 스레드 블록의 공유 메모리로 복사한 뒤, 에너지 계산을 병렬화한다.

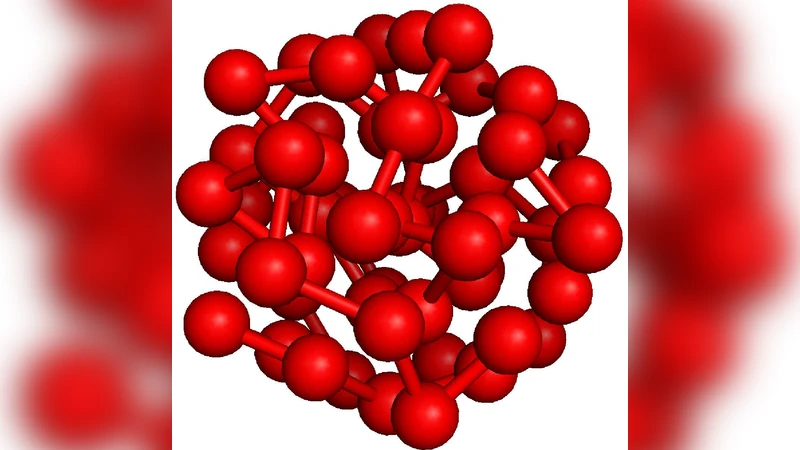

폴리머 모델은 Lennard‑Jones(LJ) 포텐셜과 FENE(유한 신장 비탄성) 포텐셜을 결합한 비격자(bead‑spring) 체인으로, 총 에너지는 모든 비근접 쌍에 대한 LJ 상호작용과 인접 단위에 대한 FENE 상호작용으로 구성된다. 메트로폴리스 업데이트는 무작위 단일 모노머 이동을 제안하고, Metropolis 기준으로 수락한다. 레플리카 교환 단계는 인접 온도 레플리카 간에 에너지와 온도 차이를 이용해 교환 확률을 계산한다.

CUDA 구현에서는 각 레플리카를 하나의 스레드 블록에 매핑하고, 블록 내 스레드 수는 폴리머 사슬 길이(N)와 직접 연관된다. 에너지 계산은 두 부분으로 나뉘는데, FENE는 인접 모노머 쌍을 담당하는 스레드가 직접 계산하고, LJ는 N/2 반복문을 통해 상반된 인덱스 쌍을 할당한다. 이때 조건문을 이용해 인덱스를 동적으로 결정하고, 거리 r이 절단 반경(rc) 이하인 경우에만 포텐셜을 평가한다. 모든 계산은 단정도(float) 연산으로 수행해 메모리 대역폭과 연산 속도를 최적화하였다.

난수 생성은 현재 CPU에서 미리 생성한 난수 배열을 전역 메모리로 복사하고, 각 블록이 이를 공유 메모리로 옮겨 사용한다. 저자는 향후 각 블록이 자체적인 난수 생성기를 갖추면 전역‑공유 메모리 전송 오버헤드를 더욱 감소시킬 수 있음을 언급한다.

성능 평가에서는 동일한 시뮬레이션을 CPU와 GPU에서 실행해 속도비를 측정했으며, 특히 레플리카 수와 사슬 길이가 증가할수록 GPU의 스케일링 효율이 크게 향상됨을 보였다. 이는 워프 수준에서의 동시 실행과 메모리 은닉 기술이 효과적으로 작동했기 때문이다. 또한, 특정 온도 구간(Θ‑점 및 저온 동결 전이)에서의 특이적인 열용량 피크와 구조 지표(Rg, End‑to‑End 거리)의 정확한 추정이 가능함을 실험적으로 확인했다.

결론적으로, 복잡한 폴리머 전이 현상을 탐구하기 위한 대규모 샘플링이 GPU 기반 병렬 레플리카 교환 시뮬레이션을 통해 실현 가능하며, 기존 CPU 전용 구현에 비해 개발 난이도는 크게 증가하지 않으면서도 수십 배의 가속을 얻을 수 있음을 입증한다. 향후 double‑precision 지원이 강화된 GPU와 보다 효율적인 난수 생성 로직을 도입하면, 더욱 정밀한 열역학적 분석이 가능할 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기